Escolar Documentos

Profissional Documentos

Cultura Documentos

Estadística Aplicada

Enviado por

elderchisoTítulo original

Direitos autorais

Formatos disponíveis

Compartilhar este documento

Compartilhar ou incorporar documento

Você considera este documento útil?

Este conteúdo é inapropriado?

Denunciar este documentoDireitos autorais:

Formatos disponíveis

Estadística Aplicada

Enviado por

elderchisoDireitos autorais:

Formatos disponíveis

Estadstica Aplicada

2013

1

Mg. Miguel Angel Macetas Hernndez

I. ESTIMACIN DE PARMETROS

1.1. Estimacin puntual

Para estimar los parmetros de una poblacin, es necesario disponer de algunos datos que

provengan de dicha poblacin. Cualquier muestra de observaciones proporciona cierto conocimiento

acerca de la poblacin de la cual proviene. Para medir el error muestral es necesario que dicha

muestra sea ALEATORIA.

Desde el punto de vista algebraico, el estimador de un parmetro es una funcin de las

observaciones muestrales t x x x

n

( , ,........ )

1 2

, que puede ser lineal, cuadrtica, etc.

Ejemplos:

( )

2 2

2

2

nes observacio las de cuadratica funcion

1

nes observacio las de lineal funcion

1

o

= =

= =

S X x

n

S

X x

n

X

i

i

El resultado numrico que se obtiene es la estimacin del parmetro, en tanto que la expresin

matemtica (o algebraica) es el estimador del parmetro. Puede haber varios estimadores del

mismo parmetro, de los cuales se pretende elegir el mejor, en base a las caractersticas o

propiedades que se requiera del mismo.

1.2. Propiedades de los estimadores

a) Insesgado o no viciado:

Un estimador se dice Insesgado si su esperanza es igual al parmetro. Es decir:

u u u = )

E insesgado es

Por el contrario, el estimador se dice viciado si su esperanza es distinta al parmetro.

viciado es E u u u

)

( =

b) Consistente:

Un estimador se dice consistente si converge al parmetro, es decir, si su distribucin se

concentra alrededor del parmetro a medida que aumenta el tamao de la muestra, de forma tal

que el error de muestreo tiende a desaparecer. Es decir:

{ } pequeo mente arbitraria n para P

si de e consistent estimador un es

+

9 e < c c u u

u u

, , 1

Si un estimador es insesgado (o asintticamente insesgado), ser consistente si su variancia

tiende a cero. Es decir:

e consistent es V E u u u u

0 )

( )

( . =

o bien : e consistent es V E u u u u

0 )

( )

( .

c) Eficiente:

Decimos que un estimador no viciado es eficiente si es de mnima variancia. O sea, el

estimador se dice eficiente si su variancia es menor que la de cualquier otro estimador del mismo

parmetro. Es decir:

Si u

es un estimador no viciado de u , entonces u

es eficiente si

*

u :

1

)

(

)

(

, , )

( )

(

*

*

< <

u

u

u u

V

V

sea o V V

Estadstica Aplicada

2013

2

Mg. Miguel Angel Macetas Hernndez

Eficiencia relativa:

Dados dos estimadores no viciados del mismo parmetro, se dice que es ms eficiente aqul

que tiene menor variancia. Es decir:

Sean

u u

1 2

y dos estimadores de u , decimos que

; (

) (

)

(

)

(

)

u u u u

u

u

1 2 1 2

1

2

1 es mas eficiente que si V V

V

V

< <

d) Suficiente:

Un estimador se dice suficiente si contiene (o absorbe) toda la informacin proporcionada por la

muestra, en lo que respecta al parmetro.

e) Invariancia:

Un estimador se dice invariante cuando una funcin del mismo es un buen estimador de la

funcin del parmetro. Es decir:

u es invariante ( ) = g g (

)

u u

II. Mtodos de estimacin puntual

1.-Mtodo de los momentos: Consiste en estimar los momentos poblacionales a travs de los

momentos muestrales.

2.-Mtodo de los Mnimos Cuadrados: Consiste en encontrar estimadores de los parmetros de forma tal

que minimicen la suma de los cuadrados de los desvos. Con este mtodo se obtienen estimadores

no viciados y consistentes, pues el mismo garantiza mnima variancia y suma de desvos igual a

cero.

3.-Mtodo de Mxima Verosimilitud: Consiste en encontrar estimadores de los parmetros de forma tal

que maximicen la funcin de probabilidad de la muestra. Para ello, es imprescindible conocer la

distribucin de la variable en la poblacin. Este mtodo proporciona los mejores estimadores, que

gozan excelentes propiedades: Insesgado (o bien, asintticamente insesgado), Consistente,

Eficiente, Suficiente, Invariantes y de distribucin asintticamente Normal.

Pasos a seguir para obtener los estimadores de mxima verosimilitud

Primero se obtiene la funcin de probabilidad de la muestra ( ) ( )

[

=

=

n

i

i n

x f x x x f

1

2 1

,..... , , tambin

llamada funcin de verosimilitud y su expresin est dada en trminos de los parmetros y de las

observaciones. Comnmente se la simboliza con ( ) u , X L , donde X es el vector aleatorio que

representa a la muestra (o valores observados) y u es el parmetro que se quiere estimar.

Luego se pretende hallar el valor de u que maximice a ( ) u , X L valor que tambin maximiza al

logaritmo de la funcin : ln ( ) u , X L , (ya que el logaritmo es una funcin montona creciente). Por lo

tanto, el segundo paso es aplicarle logaritmo a la funcin de probabilidad de la muestra ( o de

verosimilitud) con el fin de simplificar la derivada.

Se sabe que una funcin continua y derivable alcanza su valor mximo en un punto para el cual se

anula su derivada. Si la funcin de probabilidad de la muestra satisface este requisito, entonces el tercer

paso es derivar la funcin obtenida ln ( ) u , X L respecto del parmetro u , y luego hallar el valor de u

(o la expresin de u ) para el cual se satisface:

( )

0

,

=

cu

u c X L

.

Estadstica Aplicada

2013

3

Mg. Miguel Angel Macetas Hernndez

Inconvenientes:

- El mtodo de mxima verosimilitud asegura que los estimadores obtenidos son los de mnima

variancia, pero no indica cual sea esta variancia.

- El mtodo de mxima verosimilitud asegura que los estimadores obtenidos son los que asignan

mxima probabilidad a la muestra, pero obviamente se admite que dicha muestra sea posible de

obtener an con diferentes valores del parmetro.

Estas son razones por las cuales la estimacin puntual se torna impracticable (sin inters prctico), y se

prefiere la estimacin por intervalos, ya que provee de ms informacin.

III. Estimacin por Intervalos

Consiste en encontrar un conjunto de nmeros reales que conforman posibles valores del

parmetro.

La estimacin por intervalo se realiza utilizando un nivel de confianza, que simbolizamos con 1- o y

que representa la probabilidad de que dicho intervalo contenga al verdadero valor del parmetro u .

La construccin del intervalo de confianza consiste en hallar los lmites inferior y superior en funcin

de la muestra obtenida. Para su obtencin es necesario conocer la distribucin del estimador del

parmetro

u (distribucin que obviamente depender del parmetrou .). Generalmente se

construye una nueva variable en la cual intervienen el estimador

u y el parmetrou , dicha variable

recibe el nombre de estadstica de prueba y la simbolizamos g(

u ,u ) .

Su ventaja reside en que la distribucin de la estadstica de prueba ya no depende del parmetro u

siendo una distribucin standard con los valores de probabilidad tabulados correspondiente a un

gran nmero de valores posibles de la variable.

Construccin de los intervalos de confianza

3.1.1. Intervalo de Confianza para la media en poblaciones normales

Sea (X1, X

2

,..., X

n

) una muestra aleatoria extrada de una poblacin normal, luego,

i = 1... n : X ~ N( , o ) .

Por lo tanto tenemos que:

X

1

, X

2

, ... , X

n

iid N( , o ). X

n

X

i

N

n

=

1

~ ( , )

o

y ( )

X

n

N

o

~ , 0 1

a) Si o

2

es conocido, entonces el intervalo para se obtiene

o

o

o o

=

|

|

|

.

|

\

|

<

< 1

2 2

z

n

X

z P

siendo z

o/2

: el valor de la variable normal standarizada que est superado con una probabilidad o/2.

De dicha expresin se obtiene que:

Estadstica Aplicada

2013

4

Mg. Miguel Angel Macetas Hernndez

confianza de el con

n

z X

n

z X )% 1 (

2 2

o

o

+ < <

o

o o

b) Si o

2

es desconocido, se utiliza su estimador S

2

y la distribucin :

X

s

n

t

n

~

1

Entonces el intervalo para se obtiene de :

o =

|

|

|

.

|

\

|

<

< o

1

2

, 1

2

, 1 n n

t

n

s

X

t P

siendo t

n-1,o/2

el valor de la variable t-student con n grados de libertad, superado con probabilidad o/2

De dicha expresin se obtiene que :

confianza de el con

n

s

t X

n

s

t X

n n

)% 1 ( . .

2

, 1

2

, 1

o + < <

o

Intervalo de Confianza para la proporcin

Sean X

1

, X

2

, ... , X

n

iid B

i

( p ) . X = E X

i

~ B ( n , p ) .

Para n suficientemente grande, la variable binomial se distribuye aproximadamente normal ,

aproximadamente : X ~ ( ) npq np N , y

|

|

.

|

\

|

=

n

pq

p N X

n

h

i

, ~

1

donde

h

n

pq

o = es un valor desconocido puesto que no se conoce el valor del parmetro p, por lo

tanto se utiliza el estimador del desvo s

h h

n

h h

= =

( )

o

1

, obteniendo la siguiente distribucin, que es

aproximadamente normal: ( )

h p

h h

n

N

( )

~ ,

1

0 1

Dicha aproximacin es buena para muestras de tamao suficientemente grandes, y el mnimo tamao de

muestra depende del valor de h. W.G. Cochran da una regla prctica para ser utilizada en la bsqueda de

intervalos de confianza del 95%, correspondientes a la proporcin poblacional p.

Proporcin emprica h Tamao mnimo de muestra n

0.5 30

0.4 o 0.6 50

0.3 o 0.7 80

0.2 0 0.8 200

0.1 o 0.9 600

0.05 o 0.95 1400

Para estos valores de n se obtiene una buena aproximacin Normal vlida para la construccin de

intervalos del 95% de confianza.

n

h h

z h p

n

h h

z h

) 1 ( ) 1 (

2 2

+ < <

o o

con el (1-o).100% de confianza

Estadstica Aplicada

2013

5

Mg. Miguel Angel Macetas Hernndez

Intervalo de Confianza para la diferencia de medias de dos poblaciones normales independientes

Sean ( X

1

, X

2

, ... , X

n

) y ( Y

1

, Y

2

, ... , Y

m

) dos muestras aleatorias extradas de poblaciones

normales , luego :

i = 1 .. n : X

i

~ N(

x

, o

x

) .

j = 1 .. m : Y

j

~ N(

y

, o

y

).

Por lo tanto tenemos que X

1

, X

2

, ... , X

n

iid N(

x

, o

x

)

Y

1

, Y

2

, ... , Y

m

iid N(

y

, o

y

) con X

i

independiente de Y

j

ntes independie Y e X con

m

N Y

m

Y

n

N X

n

X

y

y i

x

x i

) , ( ~

1

) , ( ~

1

o

=

o

=

Entonces

( )

( ) X Y N

n m

X Y

n m

N

x y

x

y x y

x

y

+

|

\

|

.

|

|

|

+

~ ; ~ ,

o

o

o

o

2

2

2

2

0 1

a) Si o o

x

y

y

2 2

son conocidos, el intervalo de confianza para

y x

se obtiene de la siguiente

manera:

m n

z Y X

m n

z Y X

y

x

y x

y

x

2

2

2

2

2

2

o

+

o

+ < <

o

+

o

o o

con el (1-o).100% de confianza

b) Si o o

x

y

y

2 2

son desconocidos pero iguales

2 2 2

o = o = o

y x

, entonces el estimador de ambos es

( ) ( )

( )

(

+ =

+

+

= =

m n

S y

m n

S m S n

S

A y x

y x

A

1 1

2

1 1

2 2

2 2

2 2

o o

Luego, como :

( )

2

2

~

1 1

+

(

+

m n

A

y x

t

m n

S

Y X

el intervalo de confianza para

x y

se obtiene de la siguiente manera :

m n

S t Y X

m n

S t Y X

A g y x A g

1 1

.

1 1

.

, 2 , 2

+ + < < +

o o

con el (1-o).100% de confianza , siendo g = n+m-2

Nota:

Para n y m suficientemente grandes, ( ) 1 , 0

2

N t

D

m n

+

Distribucin de la diferencia de proporciones muestrales de dos poblaciones independientes

Estadstica Aplicada

2013

6

Mg. Miguel Angel Macetas Hernndez

X

1

, X

2

, ... , X

n

iid B

i

(p

1

)

Y

1

, Y

2

, ... , Y

m

iid B

i

(p

2

) con X

i

independiente de Y

j

i , j

Sean h

n

X y h

m

Y

i j 1 2

1 1

= =

Luego, h

1

y h

2

son independientes y se distribuyen aproximadamente normal :

|

|

.

|

\

|

+

|

|

.

|

\

|

|

|

.

|

\

|

m

q p

n

q p

p p N h h

ntes independie

n

q p

p N h y

n

q p

p N h

2 2 1 1

2 1 2 1

2 2

2 2

1 1

1 1

; ~

, ~ , ~

donde

( )

p q

n

p q

m

h h

1 1 2 2

1 2

+ =

o es desconocido, ya que no se conocen los parmetros p

1

y p

2

. Luego se

utiliza el estimador de este desvo:

m

h h

n

h h

S

h h h h

) 1 ( ) 1 (

2 2 1 1

) (

2 1 2 1

+

= =

o

obteniendo la siguiente distribucin aproximadamente normal

h h p p

h h

n

h h

m

N

1 2 1 2

1 1 2 2

1 1

0 1

+

( )

( ) ( )

~ ( , )

vlida para muestras suficientemente grandes.

Los intervalos de confianza para p p

1 2

sern de la forma

:

( ) ( )

h h z S p p h h z S

h h h h

1 2

2

1 2 1 2

2 1 2 1 2

< < +

o o

con el (1-o).100% de confianza

Intervalo de Confianza para la variancia en poblaciones normales

Sean X

1

, X

2

, ... , X

n

iid N( , o ). Entonces

X

N i n

i

=

o

~ ( , ) ,.... 01 1

|

\

|

.

|

=

X

i

i

n

n

o

_

1

2

2

~ y

X X

i

i

n

n

|

\

|

.

|

=

o

_

1

2

1

2

~

Como

( )

( ) X X

n S

i

i

n

x

|

\

|

.

| =

=

o

o 1

2 2

2

1

tenemos que:

( ).

~

( )

n S

x

n

1

2

2

1

2

o

_

Basado en esta informacin, sabemos que:

o =

(

(

_ <

o

< _

o o

1

). 1 (

2

2 ; 1

2

2

) (

2

2 1 ; 1 n

x

n

S n

P

de donde se obtiene el intervalo de confianza para o

2

Estadstica Aplicada

2013

7

Mg. Miguel Angel Macetas Hernndez

2

2 1 ; 1

2

) (

2

2

2 ; 1

2

) (

2

2 1 ; 1

2

) (

2

2

2 ; 1

). 1 ( ). 1 (

1

). 1 (

1

o o

o o

_

< o <

_

_

<

o

<

_

n

x

n

x

n x n

S n S n

S n

con el (1-o).100% de confianza .

Distribucin del cociente de variancias muestrales de poblaciones normales independientes

X

1

, X

2

, ... , X

n

iid N(

x

, o

x

); Y

1

, Y

2

, ... , Y

m

iid N(

y

, o

y

) con X

i

independiente de Y

j

i , j

Luego se deduce que:

|

\

|

.

|

|

=

|

\

|

.

|

|

=

=

=

x x

n S

y

y y n S

i

x

i

n

x

x

n

j

y

j

m

y

y

m

o o

_

o o

_

1

2

2

2

1

2

1

2

2

2

1

2

1

1

( ).

~

( ).

~

( )

( )

Por ser independientes resulta que :

( )

( )

( )

( )

( )

. ~

( )

,

n S

n

m S

y

m

S

S

y

x

F

x

x

y

x

y

n m

=

1

1

1

1

2

2

2

2

2

2

2

2 1 1

o

o

o

o

y anlogamente se deduce que:

( )

S

y

S

y

F

x

x

m n

( )

. ~

,

2

2

2

2

1 1

o

o

Basado en esta informacin, sabemos que:

( )

P F

S

y

S

y

F

m n

x

x

m n

< <

(

(

(

=

1 1 1 2

2

2

2

2 1 1 2

1

, ; , ;

( )

.

o o

o

o

o

que equivale a:

( )

P

F

S

y

S

y

F

m n x

x

m n

1

1

1 1 2

2

2

2

2 1 1 2

< <

(

(

(

=

, ;

, ;

( )

.

o

o

o

o

o

de donde se obtienen los intervalos de confianza para los cocientes de las variancias

o

o

o

o

x

x

y

y

y

2

2

2

2

( ) ( )

S

x

S F

y

S

x

S

F

y

m n

x

y

m n

( )

.

( )

.

, ;

, ;

2

2

1 1 2

2

2

2

2 1 1 2

1

< <

o

o

o

o

con el (1-o).100% de confianza

( ) ( )

S

y

S F

x

S

y

S

F

x m n

y

x

m n

( )

.

( )

.

, ;

, ;

2

2

1 1 2

2

2

2

2 1 1 2

1

< <

o

o

o

o

con el (1-o).100% de confianza

Estadstica Aplicada

2013

8

Mg. Miguel Angel Macetas Hernndez

Aplicaciones del Teorema Central del Lmite

Intervalo de confianza para la media en poblaciones de distribucin desconocida

Si la distribucin de X no se conoce, pero se trata de una muestra suficientemente grande, se aplica el

Teorema Central del Lmite y as se obtienen los intervalos para

a)

( ) ( )

( )

( )

( )

( )

finitas s poblacione en

1

y infinitas s poblacione en

)% 1 ( . .

2 2

2

= =

+ < <

N

n N

n n

con

confianza de el con z X z X conoce se si

x

x

x

x

x x

o

o

o

o

o o o o

o o

b)

( ) ( )

( ) ( )

( )

( )

( )

finitas s poblacione en

1

y infinitas s poblacione en

)% 1 ( . .

2 2

2

= = =

+ < <

N

n N

n

S

S

n

S

S con

confianza de el con S z X S z X conoce se no si

x

x

x

x x

x x

o

o o

o o

Intervalo de confianza para la diferencia de medias en poblaciones de distribucin desconocida

Si las distribuciones de X y de Y no se conocen, pero se trata de muestras suficientemente grandes, se

aplica el Teorema Central del Lmite y as se obtienen los intervalos para la diferencia entre las medias

poblacionales usando la distribucin Normal:

a) si se conocen las variancias poblacionales

X Y z

n m

X Y z

n m

x

y

x y

x

y

+ < < + +

o o

o

o

o

o

2

2

2

2

2

2

. . con el (1-o).100% de confianza

b) si no se conocen las variancias poblacionales, pero se las supone iguales, entonces

X Y z S

n m

X Y z S

n m

A x y A

+ < < + +

o o

2 2

1 1 1 1

. . con el (1-o).100% de confianza

c) si no se conocen las variancias poblacionales, y tampoco puede suponrselas iguales, entonces

X Y z

S

n

S

m

X Y z

S

n

S

m

x

y

x y

x

y

+ < < + +

o o

2

2

2

2

2

2

. . con el (1-o).100% de confianza

Estadstica Aplicada

2013

9

Mg. Miguel Angel Macetas Hernndez

PRUEBAS DE HIPTESIS

Definicin:

Hiptesis estadstica es un supuesto acerca de la distribucin de una variable aleatoria. Podemos

especificar una hiptesis dando el tipo de distribucin y el valor del parmetro (o valores de los

parmetros) que la definen.

Ejemplos:

1. X est normalmente distribuida con o = = 100 10 y .

2. Y es una variable binomial con p = 0.25

Frecuentemente (en la prctica), la distribucin poblacional est implcita, y la hiptesis estadstica slo

especifica el valor del parmetro.

Ejemplos :

3. La tasa media salarial es = $185..

4. La proporcin de productos defectuosos en cierto proceso es inferior a 0.05, o sea p < 0.05.

Una hiptesis estadstica puede considerarse como un conjunto de hiptesis elementales. Al respecto, una

hiptesis estadstica puede ser simple o compuesta .

Una hiptesis simple es una especificacin del valor de un parmetro, como en el ejemplo (3).

En cambio, una hiptesis compuesta contiene ms de un valor del parmetro, como en el ejemplo (4), y se

la considera constituida por el conjunto de todas las hiptesis simples compatibles con ella.

Con el objeto de probar la validez de tales hiptesis, se lleva a cabo un experimento, y la hiptesis

formulada es desechada si los resultados obtenidos del experimento son improbables bajo dicha hiptesis.

Si los resultados no son improbables, la hiptesis no es desechada por falta de evidencia.

Una hiptesis compuesta es considerada verdadera (lo cual significa que no ser rechazada o desechada)

cuando alguna de las hiptesis simples que la componen pueda considerarse verdadera.

Ejemplo :

Supongamos que queremos probar la hiptesis de que la probabilidad de obtener un as al arrojar un

dado, es de 1/6 , y con tal fin arrojamos un dado 600 veces .

Si se obtienen 600 ases , este resultado es improbable bajo la hiptesis supuesta, lo cual nos lleva a

rechazarla pues la evidencia indica que ella es falsa .

Si se obtienen 100 ases , este resultado no sera improbable bajo la hiptesis supuesta, y sin duda la

hiptesis no ser rechazada , por falta de evidencia.

Obteniendo resultados como stos, la intuicin y el sentido comn son suficientes para tomar una

decisin. Sin embargo, en la prctica los experimentos no conducen a conclusiones tan obvias, de donde

surge la necesidad de un mtodo para probar la hiptesis, y esto implica establecer reglas de decisin .

El hecho de rechazar una hiptesis no significa que sta sea falsa, como tampoco el no rechazarla

significa que sea verdadera. La decisin tomada no esta libre de error. A este respecto, consideraremos

dos tipos de error que pueden ser cometidos, y que los denominaremos error de tipo I y error de tipo II, y

que consisten en:

Error I :Rechazar una hiptesis que es verdadera .

Error II : No rechazar una hiptesis que es falsa .

La forma de medir estos errores es mediante la probabilidad. Simbolizaremos con o a la probabilidad de

rechazar una hiptesis verdadera, y con | a la probabilidad de no rechazar una hiptesis falsa; por lo

tanto o = P( rechazar H / H es verdadera ) y | = P( no rechazar H / H es falsa )

Es deseable que estas dos probabilidades de error sean pequeas. Una forma cmoda de especificar lo que

se requiere de un procedimiento de prueba es concentrar la atencin en dos conjuntos posibles de valores

del parmetro, es decir, en dos hiptesis estadsticas, a las cuales llamaremos hiptesis nula designada

por H

0

e hiptesis alternativa designada por H

1

.

La prueba de hiptesis es un procedimiento de toma de decisiones , relacionada principalmente con la

eleccin de una accin entre dos posibles . Por lo tanto, cada hiptesis (nula y alternativa) la asociaremos

con una de las acciones. Esta designacin, en principio, es arbitraria, pero tpicamente la hiptesis nula

corresponde a la ausencia de una modificacin en la variable investigada, pudiendo considerar que

Estadstica Aplicada

2013

10

Mg. Miguel Angel Macetas Hernndez

nulifica el efecto de un tratamiento , y por lo tanto se especifica de una forma exacta : H

0

: u = u

0

; en

tanto que la hiptesis alternativa generalmente indica una variacin de valores que prevalecera si la

variable sufre alguna modificacin, pudiendo pensar que el tratamiento fue efectivo , por lo cual esta

hiptesis (alternativa) se especifica de manera ms general :

H

1

: u = u

0

H

1

: u > u

0

H

1

: u < u

0

.

Observemos que en general la hiptesis alternativa es compuesta. Raramente la hiptesis alternativa es

una hiptesis simple, como por ejemplo: H

1

: u = u

1

, sino que, normalmente sta es el complemento de

la hiptesis nula .

ERRORES Y RIESGOS DE LA PRUEBA

La prctica de probar la hiptesis nula contra una alternativa, sobre la base de la informacin de la

muestra, conduce a dos tipos posibles de error, debido a fluctuaciones al azar en el muestreo. Es posible

que la hiptesis nula sea verdadera pero rechazada debido a que los datos obtenidos en la muestra sean

incompatibles con ella ; como puede ocurrir que la hiptesis nula sea falsa pero no se la rechace debido a

que la muestra obtenida no fuese incompatible con ella .

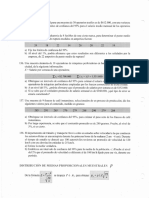

Cuadro de decisiones y errores

Estado Naturaleza H

o

es verdadera H

o

es falsa

Decisin

Rechazar H

o

error I incorrecto Correcto

No Rechazar H

o

Correcto error II - incorrecto

Las probabilidades de cometer errores de tipo I y II se consideran los "riesgos" de decisiones

incorrectas. As, la probabilidad de cometer un error de tipo I se llama nivel de significacin de la prueba

y se simboliza con o. .

o. = P( error I ) = P( rechazar H

o

/ H

0

es verdadera )

y la probabilidad de cometer un error de tipo II se designa por |. Entonces :

| = P( error II ) = P( no rechazar H

o

/ H

o

es falsa )

Prueba de hiptesis simple contra alternativa nica

Consideremos el caso de una hiptesis nula simple contra una hiptesis alternativa tambin simple.

H

0

: u = u

0

; H

1

: u = u

1

Sea la variable aleatoria X con distribucin conocida : X ~ f(x , u) , y sea ) , ,...., , (

2 1

u u

n

x x x f =

un

estimador de u . Entonces, la estadstica de prueba u

tiene distribucin conocida siempre que se

conozca el valor del parmetro u. Luego, dicha distribucin queda completamente definida suponiendo

verdadera la hiptesis nula H

0

: u = u

0

. Las reglas de decisin sobre el rechazo o no de H

o

se

establecen respecto a la amplitud de u

y el resultado particular de la muestra. Se clasifica la amplitud de

u

en dos subconjuntos que son : R = regin de rechazo o regin crtica que contiene los resultados

menos favorables a H

o

, y A = regin de aceptacin o regin de no rechazo que contiene los resultados

ms favorables a H

o

. De esta forma, si u

e R rechazamos H

o

y si u

e A no rechazamos H

o

. El

valor de u

que separa R de A se denomina valor critico de la estadstica de prueba, y se representa

por c .

Si suponemos u

1

> u

0

, entonces :

Estadstica Aplicada

2013

11

Mg. Miguel Angel Macetas Hernndez

) / ( ) (

) / ( ) (

1

u u u |

u u u o

= < = =

= > = =

c P eII P

c P eI P

o

u u u u u |

u u u u u o

d f falso es H H rech no P c P eII P

d f verdadera es H H rech P c P eI P

c

o o

c

o o o o

). ( ) / . ( ) / ( ) (

). ( ) / . ( ) / ( ) (

1 1 }

}

= = = < = =

= = = > = =

donde ) ( ) (

1

u u

f y f

o

son las funciones de densidad del estimador del parmetro u

, segn sea u = u

0

o u = u

1

respectivamente.

UBICACION DE LA REGION CRTICA

Fijado el nivel de significacin o = P rech H H es verdadera

o o

( . / ) ,debemos dividir (separar) el

recorrido de u

en dos subconjuntos disjuntos : R = regin de rechazo (o regin crtica) y A = regin de

no rechazo (o de aceptacin) , siendo A el complemento de R . Luego, se verifica que :

o u u u u = = e = e ) / ( ) / (

o o

R P verdadera es H R P

Dnde ubicamos esta regin crtica R ?

Dada nuestra preocupacin de cometer un error de tipo II , deberemos escoger para R una ubicacin

donde la probabilidad de este error sea mnima :

minimo ) /

(

minimo ) / . ( ) (

= = e

= = =

| u

|

falso es H A P equivale cual lo

falso es H H rech no P eII P

o o

o o

La regin de aceptacin A es el complemento de la regin de rechazo R , y la ubicacin de R depende

de la naturaleza de la hiptesis alternativa H .

Caso I

o

o o

H

H

u u

u u

>

=

:

:

1

0

A R

o |

c

x

u u u

}

= u = u < u = u = u e u = | u > u

). /

( ) /

( ) /

( :

1 1 1 1 1

d f c P A P para

c

o

Caso II

u

1

u

0

u

0

u

0

u

1

u

0

Estadstica Aplicada

2013

12

Mg. Miguel Angel Macetas Hernndez

o

o o

H

H

u u

u u

<

=

:

:

1

u u u

}

= u = u > u = u = u e u = | u < u

). /

( ) /

( ) /

( :

1 1 1 1 1

d f c P A P para

c

o

Caso III

o

o o

H

H

u u

u u

=

=

:

:

1

u u u

}

= u = u < u < = u = u e u = | u = u

). /

( ) /

( ) /

( :

1 1 1 2 1 1 1

2

1

d f c c P A P para

c

c

o

PASOS A SEGUIR PARA PROBAR UNA HIPOTESIS

1. Formular las hiptesis de acuerdo con el problema.

2. Escoger un nivel de significacin (o) dependiendo de los costos de cometer errores de tipo I y tipo II.

3. Escoger el estimador del parmetro cuya distribucin por muestreo sea conocida en el supuesto de que

la hiptesis nula sea verdadera, es decir, se conoce ( ) ( )

o o

que dado f sea o f u u u u =

.

4. Establecer la regla de decisin, que depende de la forma de la hiptesis alternativa y del nivel de

significacin. Esto se refiere a hallar los valores crticos.

5. En base a una muestra seleccionada al azar, calcular el valor del estadstico. Luego, comparar con el

valor crtico (o los valores crticos).

6. Decidir si rechazar o no la hiptesis nula.

Observaciones :

Slo se toma en cuenta el error de tipo I . Por lo tanto, el test es significativo si se rechaza la

hiptesis nula , pues en este caso se conoce la probabilidad de haber cometido un error. En

funcin de esto, se deber decidir cul de las hiptesis debe ser la nula y cul la alternativa, como

tambin cul debe ser el nivel de significacin.

u

0

u

0

u

1

u

1

u

0

u

0

u

0

u

0

u

1

Estadstica Aplicada

2013

13

Mg. Miguel Angel Macetas Hernndez

CASOS PARTICULARES DE PRUEBAS DE HIPTESIS

Prueba de hiptesis de la media en poblaciones normales

Sea ( X

1

, X

2

, ... , X

n

) una muestra aleatoria extrada de una poblacin normal, luego, i = 1 .. n :

X ~ N( , o ) .

Por lo tanto tenemos que: X

1

, X

2

, ... , X

n

iid N( , o ).

X

n

X N

n

i

=

1

~ ( , )

o

,

) 1 , 0 ( ~ N

X

n

o

H

0

: =

0

vs H

1

: =

0

Si la hiptesis nula H

0

es verdadera, entonces =

0

y por lo tanto

) 1 , 0 ( ~

0

N

X

n

o

Como la prueba es bilateral, se rechazar la hiptesis nula tanto como cuando se tenga evidencia de que la

media poblacional sea mayor que el valor postulado como cuando se tenga evidencia de que sea menor

que el valor postulado. Luego, se calculan dos valores crticos (z

c1

y z

c2

) para la variable pivotal o

estadstico de prueba, que son los valores de la distribucin Normal que dejan una probabilidad de o/2

por debajo y por encima respectivamente: z

c1

es tal que u( z

c1

) = o/2 y z

c2

es tal que u( z

c2

) = 1-o/2

Se estandariza el valor observado de la media muestral

n

obs

o

x

z

o

0

= del cual depender la

decisin : si z

o

> z

c2

v z

o

< z

c1

Se rechaza H

0

si z

c1

< z

o

< z

c2

No se rechaza H

0

Prueba de hiptesis de comparacin de medias de dos poblaciones normales

independientes.

Sean ( X

1

, X

2

, ... , X

n

) y ( Y

1

, Y

2

, ... , Y

m

) dos muestras aleatorias extradas de

poblaciones normales, luego:

i = 1 .. n : X

i

~ N(

x

, o

x

) j = 1 .. m : Y

j

~ N(

y

, o

y

).

Por lo tanto tenemos que

ntes independie Y e X con

m

N Y

m

Y

n

N X

n

X

y

y i

x

x i

) , ( ~

1

) , ( ~

1

o

=

o

=

Entonces

X Y N

n m

x y

x

y

+

|

\

|

.

|

|

~ ;

o

o

2

2

( ) 1 ; 0 ~

) (

2

2

N

m n

Y X

y

x

y x

o

o

+

Estadstica Aplicada

2013

14

Mg. Miguel Angel Macetas Hernndez

H

0

:

x

=

y

vs H

1

:

x

=

y

Si la hiptesis nula H

0

es verdadera, entonces

x

=

y

y por lo tanto ( ) 1 ; 0 ~

2

2

N

m n

Y X

y

x

o

o

+

Como la prueba es bilateral, se rechazar la hiptesis nula cuando se tenga evidencia de que las medias

poblacionales difieren entre s. Luego, se calculan dos valores crticos (z

c1

y z

c2

) para la variable pivotal

o estadstico de prueba, que son los valores de la distribucin Normal que dejan una probabilidad de o/2

por debajo y por encima respectivamente: z

c1

es tal que u(z

c1

) = o/2 y z

c2

es tal que u(z

c2

) = 1-o/2

Se estandariza el valor observado de la diferencia entre las medias muestrales

m n

y x

z

y

x

obs

obs

o

2

2

o

o

+

=

del cual depender la decisin :

si z

o

> z

c2

v z

o

< z

c1

Se rechaza H

0

si z

c1

< z

o

< z

c2

No se rechaza H

0

Prueba de hiptesis de la proporcin

Sean X

1

, X

2

, ... , X

n

iid B

i

( p ) . A travs de las propiedades de la Funcin Generatriz de

Momentos se demuestra que : X = E X

i

~ B ( n , p ) .

Para n suficientemente grande, la variable binomial se distribuye aproximadamente normal ,

aproximadamente : X ~ N( n.p , npq ) .

De donde se deduce que la proporcin muestral h

X

n

X

n

i

= =

tambin tiene una

distribucin aproximadamente normal :

h

n

X N p

pq

n

i

=

|

\

|

.

|

1

~ , , ( ) 1 , 0 ~ N

n

pq

p h

H

0

: p = p

0

vs H

1

: p = p

0

Si la hiptesis nula H

0

es verdadera, entonces p = p

0

y por lo tanto ( ) 1 , 0 ~

) 1 (

0 0

0

N

n

p p

p h

Como la prueba es bilateral, se rechazar la hiptesis nula tanto como cuando se tenga evidencia de que la

proporcin poblacional sea mayor que el valor postulado como cuando se tenga evidencia de que sea

menor que el valor postulado. Luego, se calculan dos valores crticos (z

c1

y z

c2

) para la variable pivotal o

estadstico de prueba, que son los valores de la distribucin Normal que dejan una probabilidad de o/2

por debajo y por encima respectivamente: z

c1

es tal que u(z

c1

) = o/2 y z

c2

es tal que u(z

c2

) = 1-o/2

Se estandariza el valor observado de la proporcin muestral

n

p p

p h

z

obs

o

) 1 (

0 0

0

= del cual depender

la decisin : si z

o

> z

c2

v z

o

< z

c1

Se rechaza H

0

si z

c1

< z

o

< z

c2

No se rechaza H

0

Estadstica Aplicada

2013

15

Mg. Miguel Angel Macetas Hernndez

Prueba de hiptesis de comparacin de proporciones de dos poblaciones

independientes

X

1

, X

2

, ... , X

n

iid B

i

(p

1

)

Y

1

, Y

2

, ... , Y

m

iid B

i

(p

2

) con X

i

independiente de Y

j

i= j

Sean h

n

X y h

m

Y

i j 1 2

1 1

= =

Luego, h

1

y h

2

son independientes y se distribuyen aproximadamente :

|

|

.

|

\

|

+

|

|

.

|

\

|

|

|

.

|

\

|

m

q p

n

q p

p p N h h

m

q p

p N h y

n

q p

p N h

2 2 1 1

2 1 2 1

2 2

2 2

1 1

1 1

; ~

, ~ , ~

( )

( ) 1 ; 0 ~

2 2 1 1

2 1 2 1

N

m

q p

n

q p

p p h h

+

H

0

: p

1

= p

2

vs H

1

: p

1

= p

2

Si la hiptesis nula H

0

es verdadera, entonces p

1

= p

2

( ) 1 ; 0 ~

1 1

) 1 (

2 1

N

m n

p p

h h

|

.

|

\

|

+

donde

m n

h m h n

p

+

+

=

2 1

. .

es la proporcin de xitos (total) .

Como la prueba es bilateral, se rechazar la hiptesis nula cuando se tenga evidencia de que las

proporciones poblacionales sean diferentes. Luego, se calculan dos valores crticos (z

c1

y z

c2

) para la

variable pivotal o estadstico de prueba, que son los valores de la distribucin Normal que dejan una

probabilidad de o/2 por debajo y por encima respectivamente: z

c1

es tal que u( z

c1

) = o/2 y z

c2

es

tal que u( z

c2

) = 1-o/2

Se estandariza el valor observado de la diferencia entre las proporciones muestrales

|

.

|

\

|

+

=

m n

p p

h h

z

obs obs

o

1 1

) 1 (

2 1

del cual depender la decisin :

si z

o

> z

c2

v z

o

< z

c1

Se rechaza H

0

si z

c1

< z

o

< z

c2

No se rechaza H

0

Estadstica Aplicada

2013

16

Mg. Miguel Angel Macetas Hernndez

Prueba de hiptesis de la variancia en poblaciones normales

Sean X

1

, X

2

, ... , X

n

iid N( , o )

Entonces :

2

1

2

1

~

=

|

|

.

|

\

|

n

n

i

i

X X

_

o

La variancia muestral est definida como S

x x

n

x

i

i

n

( )

( )

2 1

2

1

=

=

de donde se obtiene que

2

1

2

1

~

=

|

|

.

|

\

|

n

n

i

i

X X

_

o

2

1

2

2

) (

~

) 1 (

n

x

S n

_

o

H

0

: o

2

= o

2

0

vs H

1

: o

2

= o

2

0

Si la hiptesis nula H

0

es verdadera, entonces o

2

= o

2

0

y por lo tanto

2

1

0

2

) (

~

). 1 (

2

n

x

S n

_

o

Como la prueba es bilateral, se rechazar la hiptesis nula tanto como cuando se tenga evidencia de que la

variancia poblacional sea mayor que el valor postulado como cuando se tenga evidencia de que sea menor

que el valor postulado. Luego, se calculan dos valores crticos (_

2

c1

y _

2

c2

) para la variable pivotal o

estadstico de prueba, que son los valores de la distribucin _

2

n-1

que dejan una probabilidad de o/2

por debajo y por encima respectivamente : _

2

c1

es tal que P(_

2

n-1

< _

2

c1

) = o/2 y _

2

c2

es tal que

P(_

2

n-1

> _

2

c2

) = o/2 .

Se calcula el valor observado de la estadstica de prueba o variable pivotal que relaciona la variancia

muestral con la poblacional

2

0

2

2

). 1 (

o

_

obs

o

S n

= del cual depender la decisin :

si _

2

o

> _

2

c2

v _

2

o

< _

2

c1

Se rechaza H

0

si _

2

c1

< _

2

o

< _

2

c2

No se rechaza H

0

Prueba de hiptesis de comparacin de variancias de poblaciones normales

independientes

X

1

, X

2

, ... , X

n

iid N(

x

, o

x

) , Y

1

, Y

2

, ... , Y

m

iid N(

y

, o

y

) con X

i

independiente de Y

j

( ) 1 , 0 ,......, ) 1 , 0 ( ,......,

..... 1 ) 1 , 0 ( ~ ..... 1 ) 1 , 0 ( ~ :

1

1

N iid

Y Y

y N iid

X X

m j N

Y

y n i N

X

Luego

y

y m

y

y

x

x n

x

x

y

y i

x

x i

o

o

o

o

o

o

2

1

2

2

) (

2

1

2

2

) (

~

). 1 (

~

). 1 (

m

y

y

n

x

x

S n

y

S n

_

o

_

o

Estadstica Aplicada

2013

17

Mg. Miguel Angel Macetas Hernndez

que por ser independientes resulta que el cociente :

( )

( )

( )

( )

( )

( )

. ~

( )

( )

,

n S

n

m S

y

m

S

S

y

x

F

x

x

y

x

y

n m

=

1

1

1

1

2

2

2

2

2

2

2

2

1 1

o

o

o

o

H

0

: o

2

x

= o

2

y

vs H

1

: o

2

x

= o

2

y

Si la hiptesis nula H

0

es verdadera, entonces o

2

x

= o

2

y

y por lo tanto

1 , 1

2

) (

2

~

) (

m n

y

x

F

S

S

Como la prueba es bilateral, se rechazar la hiptesis nula cuando se tenga evidencia de que las variancias

poblacionales difieren entre s. Luego, se calculan dos valores crticos (F

c1

y F

c2

) para la variable pivotal

o estadstico de prueba, que son los valores de la distribucin F-Snedecor con n-1 y m-1 grados de

libertad, que dejan una probabilidad de o/2 por debajo y por encima respectivamente F

c1

es tal

que P(F

n-1;m-1

< F

c1

) = o/2 y F

c2

es tal que P(F

n-1;m-1

> F

c2

) = o/2 .

Se calcula el valor observado de la estadstica de prueba o variable pivotal del cociente de las variancias

muestrales

2

) (

2

) (

obs y

obs x

o

S

S

F =

del cual depender la decisin :

si F

o

> F

c2

v F

o

< F

c1

Se rechaza H

0

si F

c1

< F

o

< F

c2

No se rechaza H

0

Prueba de hiptesis de la media en poblaciones normales con variancia

desconocida.

Sean (X

1

, X

2

, ... , X

n

)

una muestra aleatoria extrada de una poblacin normal, luego i=1,.,n

X

i

~ N( , o ).

Por lo tanto tenemos que X

1

, X

2

, ... , X

n

iid N( , o ). de donde se deduce que:

) 1 , 0 ( ~ , ~ N

n

X

implica que

n

N X

o

o

|

|

.

|

\

|

y

2

1

2

2

) (

2

1

1

2

~

) 1 (

~

=

|

|

.

|

\

|

n

x

n

n

i

X X

S n

i

_

o

_

o

Como X y S

2

(x) son independientes, lo son tambin

2

2

) (

) 1 (

o

o

x

n

S n

y

X

, de distribucin normal

y chi cuadrado respectivamente. Luego, realizando el cociente entre ellas, obtenemos :

1

) (

~

n

n

x S

t

X

Estadstica Aplicada

2013

18

Mg. Miguel Angel Macetas Hernndez

H

0

: =

0

vs H

1

: =

0

Si la hiptesis nula H

0

es verdadera, entonces =

0

y por lo tanto

1

) (

0

~

n

n

x S

t

X

Como la prueba es bilateral, se rechazar la hiptesis nula cuando se tenga evidencia de que la media

poblacional sea mayor que el valor postulado como cuando se tenga evidencia de que sea menor que el

valor postulado. Luego, se calculan dos valores crticos (t

c1

y t

c2

) para la variable pivotal o estadstico de

prueba, que son los valores de la distribucin t-Student con n-1 grados de libertad que dejan una

probabilidad de o/2 por debajo y por encima respectivamente: t

c1

es tal que P(t

n-1

< t

c1

) = o/2 y t

c2

es

tal que P(t

n-1

> t

c2

) = o/2.

Se estandariza el valor observado de la media muestral

n

x S

obs

o

x

t

) (

0

= del cual depender la

decisin : si t

o

> t

c2

v t

o

< t

c1

Se rechaza H

0

si t

c1

< t

o

< t

c2

No se rechaza H

0

Nota: Para tamaos grandes de muestra, esta distribucin tiende a la distribucin normal con parmetros

=0 y o=1 .

( )

n N

n

x S

X

) 1 , 0 ( ~

) (

0

Prueba de hiptesis de comparacin de medias de dos poblaciones normales

independientes, con variancias desconocidas pero supuestamente iguales.

Sean (X

1

, X

2

, ... , X

n

)

y (Y

1

, Y

2

, ... , Y

m

) dos muestras aleatorias extradas de

poblaciones normales independientes con igual variancia . Entonces o o o

x y

= =

luego , i=1..n , X

i

~ N(

x

, o ) y i=1..m , Y

j

~ N(

y

, o ).

Por lo tanto tenemos que

X

1

, X

2

, ... , X

n

iid N(

x

, o ); Y

1

, Y

2

, ... , Y

m

iid N(

y

, o ). con X

i

independiente de Y

j

De la distribucin normal de las variables X e Y, se deduce que:

) 1 , 0 ( ~

1 1

) (

, ; ~

2 2

N

m n

Y X

tanto lo por y

m n

y x

N Y X

y x

+

|

|

.

|

\

|

+

o

o o

como tambin

2

1

2

2

) (

2

1

2

2

) (

~

) 1 (

~

) 1 (

m

y

n

x

S m

y

S n

_

o

_

o

que por ser independientes:

2

2

2

2

) (

2

) (

~

) 1 ( ) 1 (

+

+

m n

y x

S m S n

resulta _

o

Estadstica Aplicada

2013

19

Mg. Miguel Angel Macetas Hernndez

Luego, realizando el cociente, obtenemos:

X Y

n S m S

n m n m

t

x y

x y

n m

+

+

+

+

( )

( ) ( )

( )

~

( ) ( )

1 1

2

1 1

2 2

2

donde

( ) ( )

( )

( ) ( )

n S m S

n m

x y

+

+

1 1

2

2 2

es el estimador de la variancia comn o

2

, y lo simbolizaremos con S

2

A

H

0

:

x

=

y

vs H

1

:

x

=

y

Si la hiptesis nula H

0

es verdadera, entonces

x

=

y

y por lo tanto

2

2

) (

2

) (

~

1 1

) 2 (

) 1 ( ) 1 (

+

+

+

+

m n

y x

t

m n m n

S m S n

Y X

o bien

2

~

1 1

.

+

+

m n

A

t

m n

S

Y X

Como la prueba es bilateral, se rechazar la hiptesis nula cuando se tenga evidencia de que las medias

poblacionales sean diferentes. Luego, se calculan dos valores crticos (t

c1

y t

c2

) para la variable pivotal

o estadstico de prueba, que son los valores de la distribucin t-Student con n+m-2 grados de libertad

que dejan una probabilidad de o/2 por debajo y por encima respectivamente :

t

c1

es tal que P(t

n+m-2

< t

c1

) = o/2 y t

c2

es tal que P(t

n+m-2

> t

c2

) = o/2 .

Se estandariza el valor observado de la diferencia entre las medias muestrales

m n

S

y x

z

A

obs

obs

o

1 1

. +

= del

cual depender la decisin : si t

o

> t

c2

v t

o

< t

c1

Se rechaza H

0

si t

c1

< t

o

< t

c2

No se rechaza H

0

Nota: Para tamaos grandes de muestra, esta distribucin tiende a la distribucin normal con parmetros

=0 y o=1 .

) ( ) 1 , 0 ( ~

1 1

.

+

+

m n N

m n

S

Y X

A

Você também pode gostar

- Elasticidad 2Documento8 páginasElasticidad 2Ernesto SandovalAinda não há avaliações

- Los Cinco Terremotos Más Fuertes Que Han Azotado Al MundoDocumento27 páginasLos Cinco Terremotos Más Fuertes Que Han Azotado Al MundoelderchisoAinda não há avaliações

- Sistema IndirectoDocumento5 páginasSistema IndirectoelderchisoAinda não há avaliações

- Por Qué Se Cayó El Puente Peatonal de La Carrera 11 Con 103Documento5 páginasPor Qué Se Cayó El Puente Peatonal de La Carrera 11 Con 103elderchisoAinda não há avaliações

- Estudio Tec - Delos AgregadosDocumento12 páginasEstudio Tec - Delos AgregadoselderchisoAinda não há avaliações

- Manufactura de Materiales CompuestosDocumento30 páginasManufactura de Materiales Compuestoseduardos9500Ainda não há avaliações

- Los Cinco Terremotos Más Fuertes Que Han Azotado Al MundoDocumento27 páginasLos Cinco Terremotos Más Fuertes Que Han Azotado Al MundoelderchisoAinda não há avaliações

- Dosificacion de Mezclas de ConcretoDocumento30 páginasDosificacion de Mezclas de ConcretosebastianAinda não há avaliações

- PLANIFICACIÓNDocumento6 páginasPLANIFICACIÓNelderchisoAinda não há avaliações

- ValdiviaDocumento4 páginasValdiviaelderchisoAinda não há avaliações

- 05 IntroducciónDocumento5 páginas05 IntroducciónelderchisoAinda não há avaliações

- Saludos Cordiales A Todos Los ForistasDocumento2 páginasSaludos Cordiales A Todos Los ForistasDeener Paredes GarridoAinda não há avaliações

- Solicita Acceso A ComedorDocumento1 páginaSolicita Acceso A ComedorelderchisoAinda não há avaliações

- Dseño de Mescla Metodo a.C.IDocumento27 páginasDseño de Mescla Metodo a.C.IelderchisoAinda não há avaliações

- Trabajo de SolidosDocumento1 páginaTrabajo de SolidoselderchisoAinda não há avaliações

- Los Derechos HumanosDocumento2 páginasLos Derechos HumanoselderchisoAinda não há avaliações

- Los Derechos HumanosDocumento2 páginasLos Derechos HumanoselderchisoAinda não há avaliações

- Producción y Comercialización Del Tomate OrgánicoDocumento49 páginasProducción y Comercialización Del Tomate Orgánicoelderchiso60% (5)

- Informe de Analisis GranulometricoDocumento4 páginasInforme de Analisis GranulometricoelderchisoAinda não há avaliações

- Estudio de CanterasDocumento2 páginasEstudio de CanterasDeener Paredes GarridoAinda não há avaliações

- Deflexion Devida A Flexion Por El Método de Pendientes y DeflexionesDocumento7 páginasDeflexion Devida A Flexion Por El Método de Pendientes y DeflexionesDeener Paredes GarridoAinda não há avaliações

- GeoloxiaDocumento25 páginasGeoloxiaelderchisoAinda não há avaliações

- Producción y Comercialización Del Tomate OrgánicoDocumento49 páginasProducción y Comercialización Del Tomate Orgánicoelderchiso60% (5)

- Resumen Estabilidad y Pandeo en ColumnasDocumento5 páginasResumen Estabilidad y Pandeo en ColumnaselderchisoAinda não há avaliações

- Rocas OrnamentalesDocumento9 páginasRocas OrnamentalesLorena Santos AlbinesAinda não há avaliações

- GeoloxiaDocumento25 páginasGeoloxiaelderchisoAinda não há avaliações

- Cinematica Del Solido RigidoDocumento14 páginasCinematica Del Solido RigidoGerbercp Condori PalaciosAinda não há avaliações

- Estudio de CanterasDocumento2 páginasEstudio de CanterasDeener Paredes GarridoAinda não há avaliações

- FatigaDocumento2 páginasFatigaelderchisoAinda não há avaliações

- Curvas de TransicionDocumento41 páginasCurvas de TransicionEditmarRaga77% (13)

- Chte 2014Documento29 páginasChte 2014Rafael Franco100% (1)

- Guion 13 - Prueba de HipotesisDocumento9 páginasGuion 13 - Prueba de HipotesisJackelin Tatiana Lopez HernandezAinda não há avaliações

- Intervalos de confianza y prueba de hipótesis para proporciones poblacionalesDocumento3 páginasIntervalos de confianza y prueba de hipótesis para proporciones poblacionalesCarolina HerreraAinda não há avaliações

- Evaluación de Los Aprendizajes DomenechDocumento19 páginasEvaluación de Los Aprendizajes DomenechisabelcarrodAinda não há avaliações

- Diseño Experimental..examenDocumento11 páginasDiseño Experimental..examenMarelin JimenezAinda não há avaliações

- Tipos de MuestreoDocumento10 páginasTipos de MuestreoTu Chikito Carlòs Silva100% (1)

- Validación de Instrumentos de Recolección de DatosDocumento7 páginasValidación de Instrumentos de Recolección de Datosfrancisco alvarezAinda não há avaliações

- Distribución normal muestral y probabilidadesDocumento11 páginasDistribución normal muestral y probabilidadesLeonardoADS67% (3)

- Act 1 InferencialDocumento47 páginasAct 1 InferencialDann MartinezAinda não há avaliações

- Confiabilidad AlphaDocumento2 páginasConfiabilidad AlphaAndre Llanca SaldañaAinda não há avaliações

- Estadística Inferencial - Intervalos de ConfianzaDocumento126 páginasEstadística Inferencial - Intervalos de ConfianzaVisi NincoAinda não há avaliações

- Diagrama 3 Procedimiento ZZDocumento1 páginaDiagrama 3 Procedimiento ZZdimcg26Ainda não há avaliações

- Gestion y Aseguramiento de La Calidad Silabo 2019 IiDocumento6 páginasGestion y Aseguramiento de La Calidad Silabo 2019 IiManuel Patricio MotaAinda não há avaliações

- Fase 2 - Muestreo e Intervalos de ConfianzaDocumento512 páginasFase 2 - Muestreo e Intervalos de ConfianzaSEBASTIAN A .RAinda não há avaliações

- Psicometria ReferenciasDocumento11 páginasPsicometria ReferenciasDarelis BerdugoAinda não há avaliações

- PDF Apuntes Tema 1 Muestreo - CompressDocumento21 páginasPDF Apuntes Tema 1 Muestreo - CompressR Carlo ChAinda não há avaliações

- Ejercicios de Muestreo Aleatorio SimpleDocumento7 páginasEjercicios de Muestreo Aleatorio SimpleJaina Quispe Flores100% (1)

- Test estadísticos para variables cualitativas: Fisher, chi-cuadrado, McNemar y Q-CochranDocumento37 páginasTest estadísticos para variables cualitativas: Fisher, chi-cuadrado, McNemar y Q-CochranAlejandro ApazaAinda não há avaliações

- Ej InferenciaDocumento2 páginasEj InferenciaLeidy AgrofruitAinda não há avaliações

- EstadísticaDI I.Civil 2020Documento7 páginasEstadísticaDI I.Civil 2020LUIS FERNANDO CHAVEZ SEDANOAinda não há avaliações

- 2da Ficha de Matematica 3ro Abcdef Evaluacion DiagnosticaDocumento2 páginas2da Ficha de Matematica 3ro Abcdef Evaluacion DiagnosticaMario Roberto SacacaAinda não há avaliações

- Examen 4Documento33 páginasExamen 4Iver Antonio NIna BuenoAinda não há avaliações

- Test de Inteligencia WechslerDocumento5 páginasTest de Inteligencia WechslerChristian MerinoAinda não há avaliações

- S07.s2 - MaterialDocumento20 páginasS07.s2 - MaterialNatalia ChallaAinda não há avaliações

- MuestreoDocumento10 páginasMuestreoDarlenySueroAinda não há avaliações

- Instructivo Capacitación de Juntas Receptoras de Votos, Módulo IVDocumento18 páginasInstructivo Capacitación de Juntas Receptoras de Votos, Módulo IVChiquillaCastellanosAinda não há avaliações

- Rúbrica de Evaluación Del Tutor ExternoDocumento4 páginasRúbrica de Evaluación Del Tutor ExternoNidia PomaAinda não há avaliações

- Factorial confirmatory analysisDocumento7 páginasFactorial confirmatory analysisRodrigoAinda não há avaliações

- Conceptos Bocos 2 UNIDAD 4Documento15 páginasConceptos Bocos 2 UNIDAD 4Jennifer ZubietaAinda não há avaliações

- Ejemplo de Gerencia de La CalidadDocumento205 páginasEjemplo de Gerencia de La CalidadMaría Estela GómezAinda não há avaliações