Escolar Documentos

Profissional Documentos

Cultura Documentos

Bocos U5 Conceptos

Enviado por

Jose Gpe Tun SaraviaTítulo original

Direitos autorais

Formatos disponíveis

Compartilhar este documento

Compartilhar ou incorporar documento

Você considera este documento útil?

Este conteúdo é inapropriado?

Denunciar este documentoDireitos autorais:

Formatos disponíveis

Bocos U5 Conceptos

Enviado por

Jose Gpe Tun SaraviaDireitos autorais:

Formatos disponíveis

INSTITUTO TECNOLGICO DE CAMPECHE

La regresin lineal simple

Antecedentes

El primero en desarrollar el anlisis de regresin fue el cientfico ingls Sir. Francis

Galton (1822-1911). Sus primeros experimentos con regresin comenzaron con un

intento de analizar los patrones de crecimientos hereditarios de los guisantes.

Animado por los resultados. Sir Francis extendi su estudio para incluir los

patrones hereditarios en la estatura de las personas adultas. Descubrio que os

nios que tienen padres padres altos o bajos tendian a regresar a la estatura

promedio de la poblacin adulta. Con ese modesto inicio el uso del anlisis de

regresin se dio a conocer convirtindose en una de las herramientas estadsticas

ms poderosas que se encuentran disponibles actualmente.

Mediciones univaribles, bivariables y multivariables en

estadstica

Se debe diferenciar entre la regresin simple y la regresin mltiple. En la

regresin simple, se establece que Y es una funcin de solo una variable

independiente. Con frecuencia se le denomina regresin bivariada porque solo

hay dos variables, una dependiente y una independiente, y la regresin simple se

representa con la formula. En un modelo de regresin mltiple. Y es una funcin

de dos o ms variables independientes. Un modelo de regresin con k variables

independientes se puede expresar as:

Tambin es necesario hacer una distincin entre la regresin lineal y la regresin

curvilineal (no lineal). En modelo de regresin lineal, la relacin entre X y Y

puede representarse por medio de una lnea recta. Sostiene que a medida que X

cambia. Y cambia en cantidad constante. La regresin curvilineal utiliza una curva

para expresar la relacin entre X y Y. Es habitual colocar la variable independiente

en el eje horizontal. La siguiente figura11.1 (a) sugiere una relacin positiva y

SILVIA VICTORIA SALES DOMNGUEZPgina 1

INSTITUTO TECNOLGICO DE CAMPECHE

lineal entre X y Y. Es positiva porque X y Y parecen moverse en la misma

direccin. A medida que X aumenta (disminuye).Y aumenta (disminuye).

Es lineal por que la relacin puede identificarse mediante una lnea recta que se

dibuje entre los puntos. La

figura 11.1 (b) muestra una

relacin lineal y negativa

entre X y Y porque las dos

variables

moverse

parecen

en

direcciones

opuestas. Las figuras 11.1

(c)

11.1

(d)

indican

relaciones curvilineales. El

patrn de los puntos de

dispersin no se describe

bien con la lnea recta,

pero se define de manera ms exacta con la curva que proporciona un mejor

ajuste. Finalmente, es difcil observar toda relacin entre X y Y en la figura 11.1 (c).

La ausencia de todo patrn detectable sugiere que no existe ninguna relacin

entre X y Y.

Relaciones lineales y curvilneas. Si X y Y se relacionan en forma lineal, entonces

a medida que X cambia, Y cambia en una cantidad constante. Si existe una

relacin curvilnea, Y cambiar en una cantidad diferente a medida que X cambia.

Mediciones univariables

Como se ha visto, los mtodos de anlisis univariable se utilizan para estudiar el

comportamiento de las variables de forma individual.

Mediciones bivariables

Los mtodos de anlisis bivariable se utilizan para estudiar las relaciones que hay

entre variables tomadas de dos en dos.

SILVIA VICTORIA SALES DOMNGUEZPgina 2

INSTITUTO TECNOLGICO DE CAMPECHE

Mediciones multivariables

El anlisis multivariante no es fcil de definir. En un sentido amplio, se refiere a

todos los mtodos estadsticos que analizan simultneamente medidas mltiples

de cada individuo u objeto sometido a investigacin. Cualquier anlisis simultneo

de ms de dos variables puede ser considerado aproximadamente como un

anlisis multivariante.

Una definicin formal de la Regresin Lineal Simple

La regresin lineal tcnica que usa variables aleatorias, continuas se diferencia del

otro mtodo analtica que es la correlacin, porque esta ltima no distingue entre

las variables respuesta y la variable explicativa por que las trata en forma

simtrica.

El anlisis de regresin se usa con el propsito de prediccin. La meta del anlisis

de regresin es desarrollar un modelo estadstico que se pueda usar para predecir

los valores de una variable dependiente o de respuesta basados en los valores de

al menos una variable independiente o explicativa. La regresin lineal, que usa

una variable nmerica independiente X para predecir la variable numrica

dependiente Y.

Se dice que es regresin lineal: Cuando la funcin f (x) es lineal,

f(x) = 0 + 1x

Si 1 > 0 hay relacin lineal positiva.

Si 1 < 0 hay relacin lineal negativa.

SILVIA VICTORIA SALES DOMNGUEZPgina 3

INSTITUTO TECNOLGICO DE CAMPECHE

Los datos tienen un aspecto recto.

El diagrama de dispersin

La forma simple de un diagrama de dispersin consiste de un grfico en el plano

cartesiano para mostrar la relacin entre

dos

variables.

Cuando

se

analizan

procesos, la relacin entre una variable

controlable y una caracterstica de calidad

es de frecuente importancia. Conociendo

esta relacin se puede llegar a decidir

cmo controlar un conjunto de variables

para llegar a obtener una caracterstica de

calidad deseada.

Tipos de modelos de Regresin

Solo son necesarios dos puntos para dibujar la linea recta que representa esta

relacion lineal. La ecuacion de la recta puede expresarse como:

SILVIA VICTORIA SALES DOMNGUEZPgina 4

INSTITUTO TECNOLGICO DE CAMPECHE

En donde b0 es el intercepto y b1 es la pendiente de la recta. Por ejemplo se tiene

que:

Y=2+5x

Entonces, como se observa en la figura 11.2, la recta intersecta el eje vertical en 5.

Adems, la pendiente de la recta se halla

variacin vertica

2

= =2

B1= variacin horizontal 1

Por cada cambio de una unidad en X, Y cambia en dos unidades.

Vale la pena destacar que a medida que X incrementa de 2 a 3 (un incremento de

una unidad), Y incrementa de 9 a 11 (un incremento de dos unidades). La figura

11.3 a) muestra una grfica en la cual b1 0 , por ejemplo,

Y=10-3X

Revela que existe ua relacin negativa tal que entre Xy Y que por cada incremento

(reduccin) de una unidad en X, Y reducir (aumentar) en tres unidades. Si la

pendiente de la recta es b1=0 como en la figura 11.3 b), entonces un cambio en X

SILVIA VICTORIA SALES DOMNGUEZPgina 5

INSTITUTO TECNOLGICO DE CAMPECHE

no tiene relacin con un cambio en Y. Por tanto, X no puede utilizarse como

variable explicativa de Y.

Las relaciones entre las variables son o deterministicas o estocasticas

(aleatorias). Una relacion deterministica puede expresarse mediante la formula

que convierte la velocidad expresada en millas por hora ( mph) a kilometros por

hora (kph). Ya que 1 milla es aproximadamente igual a 1.6 kilometros, este modelo

es 1 mph=1.6 kph. Por tanto, una velocidad de 5 mph=5 (1.6)kph=8.0 kph. Este es

un modelo deterministico porque la relacion es exacta y no hay error ( salvo la

aproximacion).

Infortunamente, muy pocas relaciones en el mundo de los negocios son asi de

exactas. Con frecuencia se encuentra que al utilizar una variable para explicar

otra, existe algluna variacion en la relacion. Por ejemplo, se supone que la

vigencia de Vita+Plus,inc., distribuidores de productos para la salud, desea

desarrollar un modelo de regresion en el cual se utiliza la publicidad para explicar

los ingresos por concepto de venta. Probablemente encontraran que cuando

hacen publicidad y esta se fija en cierta cantidad de X , las ventas tendran algun

valor Y. Sin embargo , la proxima vez que se fije la publicidad en la misma

cantidad, las ventas pueden producir otro valor. La variable dependiente(ventes,

en este caso) presenta algun grado de aleatoriedad. Por tanto, habra algun error

en el intento por explicar o predecir las ventas. Se dice que un modelo de esta

SILVIA VICTORIA SALES DOMNGUEZPgina 6

INSTITUTO TECNOLGICO DE CAMPECHE

naturaleza es estocastico, por la presencia de la variacion aleatoria y puede

expresarse como:

La frmula (11.4) es la relacin poblacional (o verdadera) segn la cual se hace

0 + 1

regresin de Y sobre X. Adems,

, lo mismo que la mayora de los

parmetros, permanecern desconocidos y se pueden estimar slo con los datos

mustrales. Eso se expresa as:

En donde los valores b0 y b1 son estimadores de

0 y 1

, respectivamente, y e

es el termino aleatorio. Habitualmente se denomina residual cuando se utilizan

datos muestrales, e se reconoce que no todas las observaciones caen

exactamente en una lnea recta. Si se supiera el valor exacto de e, se podra

calcular de manera precisa Y. Sin embargo, debido a que e es aleatoria, y solo

puede estimarse. El modelo de regresin por ende toma la forma de:

en donde

Y^ (que se lee como Y sombrero) es el valor estimado de Y y b 0 y b1

son el intercepto y la pendiente de la recta de regresin estimada. Es decir,

Y^

simplemente es el valor estimado para las ventas con base en el modelo de

regresin.

SILVIA VICTORIA SALES DOMNGUEZPgina 7

INSTITUTO TECNOLGICO DE CAMPECHE

Determinacin de la ecuacin de Regresin Lineal Simple

A la ecuacin que describe la relacin entre el valor esperado de y, que se denota

E(x), y x se le llama ecuacin de regresin. La siguiente es la ecuacin de regresin para la regresin lineal simple.

La grfica de la ecuacin de regresin lineal simple es una lnea recta:

interseccin de la recta de regresin con el eje y,

es la

es la pendiente E(y) es la

media o valor esperado de y para un valor dado de x.

En l figura 14.1 se presentan ejemplos de posibles rectas de regresin. La recta de

regresin de la grfica A indica que el valor medio de y est relacionado

positivamente con x. La recta de regresin de la grfica B indica que el valor

medio de y est relacionado negativamente con x, valores menores de E(y)

corresponden a valores mayores de x. la recta de regresin de la grfica C

muestra el caso que el valor medio de y no est relacionado con ; es decir, el valor

medio de y es el mismo para todos los valores de x.

El mtodo de mnimos cuadrados

Se deben encontrar los valores de a y b, estimadores de y , de manera que la

suma de los cuadrados de los residuos sea mnima. La suma residual de los

cuadrados con frecuencia se denomina suma de cuadrados de los errores

SILVIA VICTORIA SALES DOMNGUEZPgina 8

INSTITUTO TECNOLGICO DE CAMPECHE

respecto de la recta de regresin, y se denota como SSE. Este procedimiento de

minimizacin para estimar los parmetros se llama mtodo de los mnimos

cuadrados. As, deben encontrarse a y b de modo que se minimice

Al diferenciar sse con respecto a a y b, se obtiene

Al igualar a cero las derivadas parciales y reacomodar los trminos, obtenemos las

ecuaciones siguientes (llamadas ecuaciones normales).

que se resuelven simultneamente para obtener frmulas de clculo para a y b.

Determinacin de los coeficientes b0 y b1.

Se puede usar clculos diferenciales para demostrar (vase apndice 14.1) que

los valores de b0 y b1 que minimiza la expresin (14.5) se pueden encontrar

usando las ecuaciones (14.6) y (14.7).

Donde

SILVIA VICTORIA SALES DOMNGUEZPgina 9

INSTITUTO TECNOLGICO DE CAMPECHE

X=valor de la variable independiente en la observacin

Y= valor de la variable dependiente en la observacin

x = media de la variable independiente

y = media de la variable dependiente

n=nmero total de observaciones

Ajuste e interpretacin de la recta

La recta de regresin, tiene carcter de lnea media, como ya se ha sealado con

anterioridad, tratando por lo tanto de resumir o sintetizar la informacin

suministrada por los datos.

Si tiene carcter de lnea media (de promedio, en definitiva), deber ir

acompaada siempre de una medida que nos hable de su representatividad, es

decir, de lo buena que es la recta, ya que el haber obtenido la mejor de todas no

da garantas de que sea buena.

Necesitamos, por tanto, una medida de dispersin, que tenga en cuenta la

dispersin de cada observacin con respecto a la recta, es decir, lo alejado que se

encuentra cada punto de la recta.

Es decir, deberemos evaluar esas distancias verticales a la recta, es decir, los

errores o residuales.

Si las dispersiones son pequeas, la recta ser un buen representante de la nube

de puntos, o lo que es lo mismo, la bondad de ajuste del modelo ser alta. Si la

dispersin es grande, la bondad de ajuste ser baja.

Una forma de medir dicha bondad de ajuste es precisamente evaluando la suma

de los cuadrados de los errores. Por tanto, llamaremos Varianza residual a la

expresin:

SILVIA VICTORIA SALES DOMNGUEZPgina 10

INSTITUTO TECNOLGICO DE CAMPECHE

Si la varianza residual es grande, el modelo ser malo, es decir, la recta no

explicar el comportamiento general de la nube.

La frmula prctica para el clculo de la varianza residual, si el procedimiento de

ajuste es el de los mnimos cuadrados es la siguiente:

La cota mxima de la varianza residual es la varianza que tratamos de explicar

mediante el modelo de regresin, es decir, la varianza de la variable dependiente.

Por tanto, sin ms que hacer relativa la varianza residual respecto de su mximo

valor, y multiplicando por 100, obtendremos el porcentaje de variaciones no

explicado por el modelo:

Ahora, ya es fcil obtener una media que nos indique el porcentaje de variaciones

controladas o explicadas mediante el modelo, que se conoce como Coeficiente de

Determinacin, que denotaremos con R2. Su expresin en tantos por 1, ser:

Como puede observarse, a partir de la expresin anterior: 0< R <1. Por tanto:

Si R=1, entonces no hay residuos, habr una dependencia funcional. Cuanto ms

se acerque dicho valor a la unidad, mayor poder explicativo tendr el modelo de

regresin.

SILVIA VICTORIA SALES DOMNGUEZPgina 11

INSTITUTO TECNOLGICO DE CAMPECHE

Si R=0, X no explica en absoluto ninguna de las variaciones de la variable Y, de

modo que o bien el modelo es inadecuado, o bien las variables son

independientes. Cuanto ms cercano a 0 est dicho valor, menor poder

explicativo.

Interpretacin de la pendiente del modelo.

Suposiciones en la R. L. S.

1. Los valores de la variable independiente X son fijos, medidos sin error.

2. La variable Y es aleatoria

3. Para cada valor de X, existe una distribucin normal de valores de Y

(subpoblaciones Y)

4. Las variancias de las subpoblaciones Y son todas iguales.

5. Todas las medias de las subpoblaciones de Y estn sobre la recta.

6. Los valores de Y estn normalmente distribuidos y son estadsticamente

independientes.

Inferencias en la R. L. S.

Adems de tan solo estimar la relacin lineal entre x y Y para fines de prediccin,

el experimentador podra estar interesado en hacer ciertas inferencias acerca de la

pendiente y la interseccin. Debe estarse dispuesto a hacer la suposicin adicional

de que cada i, i = 1, 2, . . . , n, tiene distribucin normal, con la finalidad de

permitir la prueba de hiptesis y la construccin de intervalos de confianza sobre

y . Esta suposicin implica que Y1, Y2, . . . , Yn tambin estn distribuidas en

forma normal, cada una con una distribucin de probabilidad n(yi; + xi, ).

Como A y B son funciones lineales de variables normales independientes, del

SILVIA VICTORIA SALES DOMNGUEZPgina 12

INSTITUTO TECNOLGICO DE CAMPECHE

teorema 7.11 se deduce que A y B tienen distribucin normal con distribuciones de

probabilidad n(a; , A) y n(b; , A), respectivamente.

Se ve que la suposicin de normalidad, un resultado mucho ms anlogo al dado

en el teorema 8.4, permite concluir que (n 2) S2/2 es una variable chi-cuadrada

con n 2 grados de libertad, independiente de la variable aleatoria B.

Entonces, el teorema 8.5 garantiza que el estadstico

tenga una distribucin t con n 2 grados de libertad . El estadstico T se usa para

construir un intervalo de confianza de (1 ) 100% para el coeficiente .

Error estndar de la Estimacin

El error estndar se calcula de la misma forma que la regresin simple.

En donde n-k-1 es el nmero de grados de libertad y k es el nmero de variables a

la derecha. El numerador bajo el radical de la formula (12.4) es la suma de los

errores elevada al cuadrado y se minimizar de acuerdo con el concepto de

mnimo cuadrados ordinarios. La pantalla 12.2 muestra una impresin en Minitab

de los valores reales para los pasajeros (Y 1), el valor proyectado para los

^

^

^

pasajeros ( Y ), y el error (Y- Y ), y el error al cuadrado (Y- Y )2. La suma

de esta ltima columna es la suma de los errores al cuadrado y se tiene que es

8.1016. El error estndar entonces ser:

Prueba t de independencia entre las variables (significacin de

la regresin).

SILVIA VICTORIA SALES DOMNGUEZPgina 13

INSTITUTO TECNOLGICO DE CAMPECHE

El modelo de regresin lineal simple es y =

relacionadas linealmente, Entonces

determinar si se puede concluir que

acerca del parmetro

H0:

Ha

x + . Si x y y estn

0. El objetivo de la prueba t es

0. Para probar la hiptesis siguiente

se emplearn los datos muestrales.

1 =0

Si se rechaza H0, se concluir que b1 0 y que entre las dos variables existe una

relacin estadsticamente significante. La base para esta prueba de hiptesis la

proporcionan las propiedades de la distribucin muestral de b1, el estimador de

1, obtenido mediante el mtodo de mnimos cuadrados.

Primero, considrese que es lo que ocurrira si para el mismo estudio de regresin

se usara otra muestra aleatoria simple. Supngase, por ejemplo, que Armands

Pizza Parlors usa una muestra de las ventas de otros 10 restaurantes. El anlisis

de regresin de esta otra muestra dar como resultado una ecuacin de regresin

parecida a la ecuacin de regresin anterior

Y^ =

60 + 5x. Sin embargo, no

puede esperarse que se obtenga exactamente la misma ecuacin (una ecuacin

en la que la interseccin con el eje y sea exactamente 60 y la pendiente sea

exactamente 5). Los estimadores b0 y b1, obtenidos por el mtodo de mnimos

cuadrados, son estadsticos muestrales que tienen su propia distribucin muestral.

A continuacin se presentan las propiedades de la distribucin muestral de b1.

SILVIA VICTORIA SALES DOMNGUEZPgina 14

INSTITUTO TECNOLGICO DE CAMPECHE

Obsrvese que el valor esperado de b1 es 1, por lo que b1 es un estimador

insesgado de

1.

Como no se conoce el valor de , se obtiene una estimacin de

denota S

b1

b1

, que se

, estimando mediante s en la ecuacin (14.17). De esta manera se

obtiene el estimador siguiente de

b1

Enfoque del ANDEVA p/la prueba de significacin de la regresin

SILVIA VICTORIA SALES DOMNGUEZPgina 15

INSTITUTO TECNOLGICO DE CAMPECHE

Intervalo de Confianza para 1 y 0 (pendiente y ordenada del

modelo).

Para el intervalo de confianza de la pendiente 1 se utiliza la distribucin t de

student con n-2 grados de libertad ya que se desconoce la varianza de la

poblacin

; el estimador de esta varianza se define por:

Por lo tanto el estadstico de prueba se define como:

En el intervalo de confianza de nivel 1- estab dado por :

Una prueba muy sensilla y util es la prueba de independencia entre variables. Si la

hipotesis nula H0: B1=0 es aceptada, Y no depende linealmente de X, en caso

contrario, se dice que Y depende de X.

Intervalo de confianza para la ordenada al origen 1.

Para probar H0, se utiliza la distribucion t de student con n-2 grados de libertad y

ccuya expresion esta dada por :

El intervalo de confianza del 95% est definido por

SILVIA VICTORIA SALES DOMNGUEZPgina 16

INSTITUTO TECNOLGICO DE CAMPECHE

Intervalo de Confianza para la media y,x .

A veces es conveniente estimar el valor medio o separado de Y para el un valor

dado de X, tal estimacin se hace con el intervalo de confianza:

Al calcular los lmites de confianza para los valores de medios, estos se obtiene

para cada valor de Xo; tales limites sern ms estrechos a medida que se

aproximan a la medida de la variable independiente y ms amplios a medida que

se alejan de ella, por esta razn se obtienen limites llamados bandas de confianza

dentro de las cuales queda comprendida la recta verdadera para un nivel de

significacin a.

Para trazar las bandas de confianza se elegirn cuando menos 3 valores de X0

dos valores extremos y uno intermedio, y se harn las estimaciones por intervalo.

Estos intervalos se dibujan sobre los diagramas de dispersin uniendo todos los

puntos generados por los lmites inferiores y por otro lado, todos los

correspondientes a los lmites superiores.

Intervalo de Confianza de prediccin para una observacin futura

Yi

Como las bandas de confianza se abren a medida que Xo se aleja de la media X,

resulta aventurado hacer predicciones sobre Y para valores fuera de la escala de

SILVIA VICTORIA SALES DOMNGUEZPgina 17

INSTITUTO TECNOLGICO DE CAMPECHE

valores de X empleada para establecer la ecuacin de regresin de la muestra. A

menos de que este razonablemente seguro que existe la misma funcin de

regresin sobre un amplio rango de valores de X, por haberse experimentado en

una muestra, se podr usar valores de Xo alejados de la media X para predecir

valores de Y.

Cuando se hacen predicciones, estas, ms que ser sobre valores medios de Y,

son para valores individuales, por lo tanto el error debido al azar (error

de estimacin

) es una fuente adicional de variacin, por ello la varianza se

ve aumentada y el intervalo de confianza para un valor de prediccin

es ms

amplio que el de

Evaluacin de la adecuacin del modelo de regresin

Los valores del error residual o estimado (ei) se definen como la diferencia entre

^

los valores observados (Yi) y los predichos ( Y 1 ) de la variable dependiente para

valores dados que Xi. por tanto

e i=Y iY^ i

Podemos evaluar lo adecuado del modelo de regresin ajustado mediante la

graficacion de los residuos del eje vertical con respecto a los correspondientes

SILVIA VICTORIA SALES DOMNGUEZPgina 18

INSTITUTO TECNOLGICO DE CAMPECHE

valores de Xi de la variable independiente del eje horizontal. Si el modelo ajustado

es adecuado para los datos, no deber aparecer ingun patrn evidente en esta

grafica de los residuos contra X i. sin embargo, si el modelo ajustado no es

adecuado, habr una relacin entre los valores de X i y los residuos ei.

tal patrn puede observarse en la figura 17.8.

en la figura 17.8(a) se presenta una situacin en la que existe una significativa

relacin lineal simple entre X y Y. sin embargo, parece mas apropiado tener un

modelo curvilneo entre las dos variables. Este efecto se resalta en la figura 17.8

(b), que es la grafica residual de ei contra Xi. aqu se tiene un efecto curvilneo

obvio entre Xi y ei. al graficar los residuos hemos dejado fuera o eliminado la

tendencia lineal de X con Y, exponiendo, en consecuencia, la falta de ajuste en el

modelo lineal simple. As pues, de (a) y (b) podemos llegar a concluir que el

modelo curvilneo puede ser un mejor ajuste y deberia evaluarse en lugar del

modelo lineal simple.

los residuos estandarizados representan a cada residuo dividido entre su error

estndar. El residuo estandarizado se expresa de la siguiente manera:

SR i=

ei

S YX 1hi

En la que

1

hi = +

n

( X i X )

X 21n X 2

i=1

SILVIA VICTORIA SALES DOMNGUEZPgina 19

INSTITUTO TECNOLGICO DE CAMPECHE

Los valores estandarizados nos permiten tomar en cuenta la magnitud de los

residuos en unidades que reflejen la variacin estandarizada alreedor de la lnea

de regresin. En la figura 17.9, los residuos estandarizados fueron graficados en

funcin de la variable independiente (nmero de clientes). De esta podemos

observar que, a pesar de que existe una dispersin amplia en la grafica de

residuos, no existe un patrn evidente o a una relacin entre los residuos

estandarizados y Xi. los residuos parecen estar equitativamente distribuidos por

arriba y por debajo de 0, para diferenciar valores de X . as pues, podemos llegar a

la conclusin, con respecto a los datos de la tienda departamental, que el modelo

ajustado parece ser adecuado.

Anlisis residual (grfico y numrico).

El anlisis residual es la herramienta principal para determinar si el modelo de

regresin empleado es apropiado.

Como ya se indic, el residual de la observacin i es la diferencia entre el valor

observado de la variable dependiente (yi) y el valor estimado de la variable

dependiente (y )

SILVIA VICTORIA SALES DOMNGUEZPgina 20

INSTITUTO TECNOLGICO DE CAMPECHE

donde

y es el valor observado de la variable dependiente

^y

es el valor estimado de la variable dependiente

En otras palabras, el residual i es el error que resulta de usar la ecuacin de regresin

estimada

para predecir el valor de la variable dependiente. En la tabla 14.7 se calculan estos

residuales correspondientes a los datos del ejemplo de Armands Pizza Parlors. En la

segunda columna de la

tabla se presentan los valores observados de la variable dependiente y en la tercera

columna, los

valores estimados de la variable dependiente obtenidos usando la ecuacin de

regresin estimada

^y

= 60 + 5x. Un anlisis de los residuales correspondientes, que se encuentran en

la cuarta columna de la tabla, ayuda a determinar si las suposiciones hechas acerca del

modelo de regresin son adecuadas.

A continuacin se revisan las suposiciones de regresin en el ejemplo de Armands

Pizza Parlors. Se supuso un modelo de regresin lineal simple

y=

x+

(14.29)

Este modelo indica que se supone que las ventas trimestrales (y) son funcin lineal del

tamao

de la poblacin de estudiantes (x), ms un trmino del error . En la seccin 14.4, para

el trmino

del error se hicieron las siguientes suposiciones

1. E() = 0.

2. La varianza de , que se denota 2, es la misma para todos los valores de x.

3. Los valores de son independientes.

4. El trmino del error tiene distribucin normal.

Estas suposiciones son la base terica para las pruebas t y F que se usan para

determinar si la relacin

entre x y y es significativa y para las estimaciones, mediante intervalos de confianza y

de

prediccin, presentadas en la seccin 14.6. Si las suposiciones acerca del trmino del

error son

dudosas, puede ser que las pruebas de hiptesis acerca de la significancia de la

relacin de regresin y los resultados de la estimacin por intervalo no sean correctos.

Los residuales proporcionan la mejor informacin acerca de ; por lo tanto, el anlisis

de los

residuales es muy importante para determinar si las suposiciones hechas acerca de

son apropiadas.

Gran parte del anlisis residual se basa en examinar grficas. En esta seccin se

estudiarn

las siguientes grficas de residuales.

SILVIA VICTORIA SALES DOMNGUEZPgina 21

INSTITUTO TECNOLGICO DE CAMPECHE

1. La grfica de residuales contra los valores de la variable independiente x

2. La grfica de residuales contra los valores pronosticados para la variable

dependiente

^y

3. La grfica de residuales estandarizados

4. La grfica de probabilidad normal.

Grfica de residuales contra x

La grfica de residuales contra la variable independiente x es una grfica en la que

los valores

de la variable independiente se representan en el eje horizontal y los valores de los

residuales correspondientes

se representan en el eje vertical. Para cada residual se grafica un punto. La primera

coordenada de cada punto est dada por el valor xi y la segunda coordenada est dada

por el

correspondiente valor del residual yi _ i. En la grfica de residuales contra x obtenida

con los

datos de Armands Pizza Parlors de la tabla 14.7, las coordenadas del primer punto son

(2, _12),

que corresponden a x1 = 2 y y1 _ 1__12; las coordenadas del segundo punto son (6, 15),

que

corresponden a x2 = 6 y y2 _ 2 _15; etc. En la figura 14.11 se muestra la grfica de

residuales

obtenida.

Antes de interpretar los resultados de esta grfica de residuales, se considerarn

algunas de

las formas generales que pueden tener las grficas de residuales. En la figura 14.12 se

muestran

tres ejemplos. Si la suposicin de que la varianza de _ es la misma para todos los

valores de x y

si el modelo de regresin empleado representa adecuadamente la relacin entre las

variables, el

aspecto general de la grfica de residuales ser el de una banda horizontal de puntos

como en

la grfica A de la figura 14.12. Pero si la varianza de _ no es la misma para todos los

valores x

por ejemplo, si la variabilidad respecto a la lnea de regresin es mayor para valores

de x mayores

el aspecto de la grfica puede ser como el de la grfica B de la figura 14.12. En este

caso,

se viola la suposicin de que _ tiene una varianza constante. En la grfica C se muestra

otra

forma que puede tomar la grfica de residuales. En este caso, se puede concluir que el

modelo

de regresin empleado no representa adecuadamente la relacin entre las variables, y

deber considerarse

un modelo de regresin curvilneo o mltiple.

Volviendo, ahora, a la grfica de los residuales del ejemplo de Armands Pizza Parlors,

figura

14.11. Estos residuales parecen tener una forma que se aproxima a la forma de banda

horizontal

de la grfica A de la figura 14.12. Por lo tanto, se concluye que esta grfica de

residuales no

muestra evidencias de que las suposiciones hechas para el modelo de regresin de

Armands puedan

SILVIA VICTORIA SALES DOMNGUEZPgina 22

INSTITUTO TECNOLGICO DE CAMPECHE

ser dudosas. Se concluye que el modelo de regresin lineal simple empleado para el

ejemplo

de Armands, es vlido.

Para la adecuada interpretacin de las grficas de residuales experiencia y criterio son

muy

importantes. Es raro que una grfica de residuales tenga exactamente la forma de una

de las grficas

presentadas en la figura 14.12. Sin embargo, los analistas que realizan frecuentemente

estudios

de regresin y grficas de residuales se vuelven expertos en reconocer las diferencias

entre

las formas razonables y las que indican que se pude dudar de las suposiciones del

modelo. Una

grfica de residuales proporciona una tcnica para evaluar la validez de las

suposiciones en un

modelo de regresin.

Grfica de residuales contra y^

En otra grfica de residuales los valores pronosticados para la variable dependiente se

representan

en el eje horizontal y los valores de los residuales en el eje vertical. A cada residual

corresponde

un punto en la grfica. La primera coordenada de cada uno de los puntos es i y la

segunda coordenada es el valor correspondiente del residual i,yi _ i. Empleando los

datos de Armands,

tabla 14.7, las coordenadas del primer punto son (70, _12), que corresponden a 1 _ 70

y y1 _ 1__12; las coordenadas del segundo punto son (90, 15), etc. En la figura 14.13 se

presenta

esta grfica de residuales. Obsrvese que la forma de esta grfica de residuales es

igual a

la forma de la grfica de residuales contra la variable independiente x. Esta no es una

forma que

pudiera llevar a dudar de las suposiciones del modelo. En la regresin lineal simple,

tanto la grfica

de residuales contra x como la grfica de residuales contra tienen la misma forma. En

el

anlisis de regresin mltiple, la grfica de residuales contra se usa ms debido a que

se tiene

SILVIA VICTORIA SALES DOMNGUEZPgina 23

INSTITUTO TECNOLGICO DE CAMPECHE

ms de una variable independiente.

El coeficiente de Determinacin

La intensidad de una relacin entre dos variables de una poblacin por lo general

se mide mediante el coeficiente de correlacin p, cuyos valores van desde -1,

correspondiente

una

correlacin

perfectamente

negativa,

hasta

+1,

correspondiente a una correlacin perfectamente positiva. En la figura 17.6 se

ilustran estas tres diferentes clases de asociacin entre variables. En el panel A de

esta figura presentamos una relacin lineal negativa prefecta entre X y Y, de modo

que Y disminuir de una manera perfectamente predecible en la medida que X

aumenta. En el panel B se tiene un ejemplo en el que no hay relacin entre X y Y.

a medida que X no se da ningn cambio en Y, de modo que no hay ninguna

asociacin entre los valores de X y los de Y. por el contrario, en el panel C se

presenta una correlacin perfectamente positiva entre las dos variables. En este

caso, Y aumenta de una manera perfectamente predecible conforme se

incrementa X.

Para problemas orientados a la regresin, el coeficiente de correlacin de muestra

(r) puede obtenerse de la siguiente manera:

r 2=

suma de cuadrados debido a la regresin SSR

=

sumatotal de cuadrados

SST

De modo que

r= r 2

En casos de regresin lineal simple, r toma el signo de b 1; si este es positivo, r es

positivo; si b1 es negativo, r es negativo; y si b1 es cero, r es cero.

La regresin y la correlacin son dos tcnicas separadas: la regresin tiene que

ver con la prediccin y la correlacin con la asociacin. En muchas aplicaciones

solamente nos interesa la medicin de la asociacin entre variables, y no con el

uso de una variable para predecir otra.

SILVIA VICTORIA SALES DOMNGUEZPgina 24

INSTITUTO TECNOLGICO DE CAMPECHE

Si nicamente se lleva a cabo un anlisis de correlacin de un conjunto de datos,

el coeficiente de correlacin de muestra r, puede calcularse directamente

utilizando la siguiente frmula:

n

(X 1 X )(Y 1Y )

r=

i=1

2

( X 1 X )

i=1

(Y 1Y )

i=1

Alternativamente, con la frmula del calculador:

n

X 1 Y 1n X Y

r=

i=1

n

i=1

X n X 2

2

1

i=1

Y 21 n Y 2

+ Introduccin

+ Medidas de variacin en la Regresin y Correlacin

* SCT (SST), SCR (SSR), SCE (SSE)

Existen tres Fuentes de variacin en un modelo de regresin.

SCT (SST): variacin total, la cual es la suma de las dos primeras.

SCR (SSR):la variacin explicada por la regresin.

SCE (SSE): la variacin que permanece sin explicar debido al error.

SILVIA VICTORIA SALES DOMNGUEZPgina 25

INSTITUTO TECNOLGICO DE CAMPECHE

La razon CMR/CME proporciona una medida de exactitud del modelo porque es la

razon de la desviacion promedio al cuadrado que se explica con el modelo, y la

desviacion promedio al cuadrado se queda sin explicar. Entre mayor sea esta

razon, el modelo tendra mayor poder explicativo. Es decir, una prueba F alta

seala que el modelo posee un poder explicativo significativo. Para determinar que

es alto, el valor F debe compararse con un valor critico.

Suma de cuadrados de la regresion

2

(SCxy )

SCR =

SCx

SCT se halla como la suma de SCR y SCT

Clculo del coeficiente e interpretacin

Prueba de falta de ajuste

La suma de errores cuadrticos consiste en dos partes: la cantidad debida a la

variacin entre los valores de Y dentro de valores dados de x, y un componente

que normalmente se denomina contribucin a la falta de ajuste. El primer

componente refleja tan slo la variacin aleatoria, o error experimental puro;

mientras que el segundo es una medida de la variacin sistemtica introducida por

los trminos de orden superior. En nuestro caso, stos son trminos de x distintos

de la contribucin lineal o de primer orden. Observe que al elegir un modelo lineal

en esencia se supone que este segundo componente no existe y, por lo tanto, la

suma cuadrtica de errores se debe por completo a errores aleatorios. Si ste

fuera el caso, entonces S2 = SSE/(n 2) es un estimador insesgado de 2. Sin

SILVIA VICTORIA SALES DOMNGUEZPgina 26

INSTITUTO TECNOLGICO DE CAMPECHE

embargo, si el modelo no se ajusta a los datos en forma apropiada, entonces la

suma cuadrtica de errores estar inflada y producir un estimador sesgado de

2.

Sea que el modelo se ajuste o no a los datos, siempre que se tienen

observaciones repetidas es posible obtener un estimador insesgado de 2

calculando

para cada uno de los k valores distintos de x y, despus, al agrupar estas

varianzas, tenemos

El numerador de s2 es una medida del error experimental puro. A continuacin se

presenta un procedimiento computacional para separar la suma cuadrtica de

errores en los dos componentes que representan el error puro y la falta de ajuste.

Clculo de la suma de cuadrados debida a la falta de ajuste.

1. Calcule la suma de los cuadrados del error puro

Esta suma de cuadrados tiene n k grados de libertad asociados con ella, y la

media cuadrtica resultante es el estimador insesgado s2 de 2.

2.

Reste la suma de cuadrados del error puro de la suma de cuadrados del

error, SSE, con lo que se obtiene la suma de cuadrados debida a la falta de

ajuste. Los grados de libertad de la falta de ajuste tambin se obtienen con

la sola resta de

(n 2) (n k) = k 2.

SILVIA VICTORIA SALES DOMNGUEZPgina 27

INSTITUTO TECNOLGICO DE CAMPECHE

> El anlisis de Correlacin

- Introduccin

Clculo del coeficiente

Al cociente de la variacin explicada entre la variacin total se le llama coeficiente

de determinacin. Si hay cero variacin explicada (es decir, si la variacin total es

slo variacin no explicada), este cociente es 0. Si hay 0 variacin no explicada

(es decir, si la variacin total es slo variacin explicada), este cociente es 1. En

los dems casos, este cociente se encuentra entre 0 y 1; como siempre es no

negativo, se denota r2. A la cantidad r se le llama coeficiente de correlacin; est

dado por

y vara entre 1 y +1. Los signos + y se usan para correlacin lineal positiva y

correlacin lineal negativa, respectivamente.

Obsrvese que r es una cantidad adimensional; es decir, no depende de las

unidades que se empleen.

Utilizando las ecuaciones (8) y (11) y el hecho de que la desviacin estndar de Y

es

se encuentra que la ecuacin (12) puede expresarse, sin hacer caso del signo,

como

SILVIA VICTORIA SALES DOMNGUEZPgina 28

INSTITUTO TECNOLGICO DE CAMPECHE

Si se intercambian X y Y se obtienen ecuaciones similares.

En el caso de la correlacin lineal, la cantidad r es la misma, ya sea que se

considere a X o a Y como la variable independiente. Por lo tanto r es una muy

buena medida de la correlacin lineal entre dos variables.

- P. de H. e Interpretacin

SILVIA VICTORIA SALES DOMNGUEZPgina 29

Você também pode gostar

- Precursores 1Documento17 páginasPrecursores 1Jose Gpe Tun SaraviaAinda não há avaliações

- Introducción A La Óptica CompletoDocumento49 páginasIntroducción A La Óptica CompletoJose Gpe Tun SaraviaAinda não há avaliações

- 2 Introduccion y Origenes Del LenguajeDocumento12 páginas2 Introduccion y Origenes Del LenguajeJose Gpe Tun Saravia0% (1)

- Empresa Internacional McdonaldsDocumento9 páginasEmpresa Internacional McdonaldsJose Gpe Tun SaraviaAinda não há avaliações

- Material para La InstalacionDocumento41 páginasMaterial para La InstalacionJose Gpe Tun SaraviaAinda não há avaliações

- Analisis Regresion MultipleDocumento23 páginasAnalisis Regresion MultipleXavier XdAinda não há avaliações

- Galvez Peralta, Jose Fernando - Silva Lopez, Jose Luis PDFDocumento124 páginasGalvez Peralta, Jose Fernando - Silva Lopez, Jose Luis PDFAlonso ReyesAinda não há avaliações

- Parcial 1 Iop 2Documento12 páginasParcial 1 Iop 2alexandraAinda não há avaliações

- Sílabo - Fundamentos de EconometríaDocumento5 páginasSílabo - Fundamentos de EconometríarematoAinda não há avaliações

- Modelo de Regresion CuadraticaDocumento13 páginasModelo de Regresion CuadraticaCristian RamírezAinda não há avaliações

- Master Metodologia UABDocumento22 páginasMaster Metodologia UABMoileon2011Ainda não há avaliações

- Labo 4 17Documento9 páginasLabo 4 17Junior ApazaAinda não há avaliações

- Regresión Logística Simple y MúltipleDocumento41 páginasRegresión Logística Simple y MúltipleJuan Pablo Góngora PérezAinda não há avaliações

- Economía de La Educación - Capital Humano y Rendimiento EducativoDocumento29 páginasEconomía de La Educación - Capital Humano y Rendimiento EducativoetnoeducacionAinda não há avaliações

- Contabilidad de CostosDocumento3 páginasContabilidad de CostosOtaku GirlAinda não há avaliações

- Compendio 7Documento12 páginasCompendio 7Nata SaenzAinda não há avaliações

- Control 6Documento6 páginasControl 6francisco esquivel montenegroAinda não há avaliações

- Análisis Por El Método de Regresión Lineal Simple para La Producción de Mango en Chiapas (2015-2019)Documento21 páginasAnálisis Por El Método de Regresión Lineal Simple para La Producción de Mango en Chiapas (2015-2019)LissethAinda não há avaliações

- Met Est Fin Oct Dic 2018 Apuntes Completos PDFDocumento129 páginasMet Est Fin Oct Dic 2018 Apuntes Completos PDFEucario Gasca CarrilloAinda não há avaliações

- Aplicación Del Análisis de Regresión Lineal Simple para La Estimación de Los Precios de Las Acciones de Facebook PDFDocumento23 páginasAplicación Del Análisis de Regresión Lineal Simple para La Estimación de Los Precios de Las Acciones de Facebook PDFFernando MuñozAinda não há avaliações

- Analisis de Datos Categoricos 2017Documento1 páginaAnalisis de Datos Categoricos 2017deyvis mamani quispeAinda não há avaliações

- Revisar Entrega de Examen - Semana 6 - Sumativa 2 - DISPDocumento8 páginasRevisar Entrega de Examen - Semana 6 - Sumativa 2 - DISPecornejokAinda não há avaliações

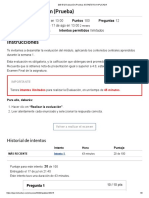

- (M3-E1) Evaluación (Prueba) - ESTADÍSTICA APLICADADocumento9 páginas(M3-E1) Evaluación (Prueba) - ESTADÍSTICA APLICADASONIA GONZALEZ SALAZARAinda não há avaliações

- Ejercicios Simulacion Matematica 1er ParcialDocumento3 páginasEjercicios Simulacion Matematica 1er ParcialDaniel A. Aguilar M.Ainda não há avaliações

- Determinantes de Las Brechas Educativas-César Del Pozo LoayzaDocumento44 páginasDeterminantes de Las Brechas Educativas-César Del Pozo LoayzaMarco AntonioAinda não há avaliações

- Evaluacion Estadistica Ii PDFDocumento9 páginasEvaluacion Estadistica Ii PDFJonathan OcampoAinda não há avaliações

- 9.4 Entregar Práctica 4 - A01323445Documento15 páginas9.4 Entregar Práctica 4 - A01323445Estefanía ZavalaAinda não há avaliações

- Analisis Cuenca Rio Anaime TOLIMADocumento10 páginasAnalisis Cuenca Rio Anaime TOLIMAChristian Camilo Pira RoaAinda não há avaliações

- Test M4 EstadisticaDocumento12 páginasTest M4 EstadisticaANGELICA RIVAS MUÑOZAinda não há avaliações

- Mineria de DatosDocumento6 páginasMineria de DatosDominga Velazquez AncheitaAinda não há avaliações

- Econometría I Parcial 2Documento8 páginasEconometría I Parcial 2pruebaAinda não há avaliações

- Estadistica IIDocumento14 páginasEstadistica IIWILMOIS MASTERAinda não há avaliações

- TP3 Esquivelgonzalo24781Documento7 páginasTP3 Esquivelgonzalo24781Gonzalo EsquivelAinda não há avaliações

- Clase 01 DPI Estudios Previos VDocumento42 páginasClase 01 DPI Estudios Previos VGeyson Huamán CerasAinda não há avaliações