Escolar Documentos

Profissional Documentos

Cultura Documentos

Semana 009 Dist. Bidimensionales

Enviado por

MarioSedanoArecheDireitos autorais

Formatos disponíveis

Compartilhar este documento

Compartilhar ou incorporar documento

Você considera este documento útil?

Este conteúdo é inapropriado?

Denunciar este documentoDireitos autorais:

Formatos disponíveis

Semana 009 Dist. Bidimensionales

Enviado por

MarioSedanoArecheDireitos autorais:

Formatos disponíveis

Estadstica y

Probabilidades

M.Sc.Ing. Jorge Luis Huere Pea

Docente Asociado del Departamento Acadmico de Ciencias Bsicas FCI

Web Page : www.unh.edu.pe e-mail : jhuere@unh.edu.pe

Semana 09:

Distribuciones Bidimensionales

Universidad Nacional de Huancavelica

Facultad de Ciencias de Ingeniera

Escuela Acadmico Profesional de Ingeniera Civil

Departamento Acadmico de Ciencias Bsicas

Se denominan distribuciones bidimensionales cuando se

estudian 02 caractersticas (variables) de un mismo elemento

(unidad experimental), considerando simultneamente las dos

series.

De manera general si se estudian sobre una poblacin y se

miden por las mismas unidades estadsticas una variable X y

una variable Y, se obtienen series estadsticas de las variables

X e Y.

Introduccin

Se consideran 02 tipos de tabulaciones:

Tabulacin de variables estadsticas

bidimensionales

1. Tabla de Correlacin.

Para variables cuantitativas

2. Tabla de Contingencia

Para variables cualitativas

Hay textos que usan los clculos de regresin y

correlacin para los mismos casos por lo similares

que son. A veces el investigador se confunde y piensa

que puede emplear ambos modelos en un mismo

problema.

X

Y

A. Relacin lneal positiva

X

Y

B. Relacin lneal negativa

X

Y

C. Relacin No lneal

X

Y

D. Sin relacin defnida, incorrelacin

X

Y

A. Relacin lneal positiva

X

Y

B. Relacin lneal negativa

X

Y

C. Relacin No lneal

X

Y

D. Sin relacin defnida, incorrelacin

y* = a + bx

Se usa cuando sabe que existe una relacin entre las variables

porque hay una teora o investigaciones previas que la han

descubierto.

Por ejemplo, la relacin entre espacio y tiempo ya se sabe que

es la velocidad, o como la relacin entre voltaje e intensidad de

corriente elctrica. .

En estos casos, se busca verificar experimentalmente tal

relacin y el objeto de la regresin es encontrar la curva que

mejor ajuste a sus datos experimentales.

Anlisis de Regresin

Se emplea cuando el investigador sospecha que ambas

magnitudes estn relacionadas, pero no tiene idea de una

ecuacin que las combine.

Por ejemplo el caso de peso y talla, donde todo lo que se

sospecha es que a mayor talla, mayor peso, pero nadie ha

descubierto una frmula que las relacione.

Anlisis de Correlacin

La forma ms comn de concebir las relaciones entre

pares de magnitudes es del tipo causa-efecto. Lo que

trata el anlisis estadstico es establecer la forma y la

significacin de las relaciones funcionales entre las dos

variables. La demostracin de la relacin causa-efecto es

tema del procedimiento del mtodo cientfico, y queda a

cargo del investigador.

I. ANALISIS DE REGRESIN:

PROCEDIMIENTOS DE UN ANALISIS DE REGRESION

Se suele escribir como y = F(x), donde x es la variable

independiente

Aqu se trata de predecir o explicar el comportamiento o

resultado de una variable (VD)

en funcin de otras variables (VI), as como investigar si

ellas estn asociadas o correlacionadas entre s

y

F (x)

Dado n observaciones bidimensionales, cada par de

valores (x,y) en el plano cartesiano est representado por

un punto, y habr tantos puntos como parejas de

observaciones se tenga.

Est representacin da origen a una NUBE DE PUNTOS

que se denomina DIAGRAMA DE ESPARCIMIENTO o

DISPERSIN; este diagrama puede tomar diferentes

formas, como se observa por ejemplo en el Grfico N 1

1.- Diagrama de dispersin:

X

Y

A. Relacin lneal positiva

X

Y

B. Relacin lneal negativa

X

Y

C. Relacin No lneal

X

Y

D. Sin relacin defnida, incorrelacin

GRFICO N 1

Ejemplo de Diagramas de Dispersin para datos bidimensionales.

2.- Regresin Simple:

El propsito de la regresin simple es estimar la

relacin que existe entre dos variables x e y, que se

expresan como:

y = F(x) que se lee y depende de x

y = Variable dependiente, predictando o explicada

x = Variable independiente, predictor o explicativa

Antes de definir cul sera la funcin matemtica o modelo

de regresin que exprese adecuadamente la relacin entre las

variables, es indispensable comprobar por un anlisis lgico la

existencia de una relacin de dependencia o causalidad directa

o indirecta entre las variables.

Por ejemplo, es lgico aceptar

que las utilidades o ganancias

depender del volumen de ventas;

la capacidad de ahorro es funcin

del ingreso, etc. En este anlisis es

muy til la nube de puntos, cuya

forma insina la forma de la

funcin de regresin.

Para determinar o construir MODELOS o FUNCIONES

DE REGRESIN es indispensable disponer informacin

acerca de los valores cada una de las variables en

distintos momentos o lugar. En general, la funcin de

regresin como modelo estadstico se construye a partir

de una muestra representativa de valores (x

i

,y

i

).

y = F(x)

3.- Ajuste de una Funcin de Regresin:

Ajustar una funcin de regresin significa buscar o

definir la funcin que exprese con mayor precisin la

relacin entre variables. Grficamente ser aquella

funcin que mejor se adecue a la nube de puntos.

Analticamente, la relacin Y* = f(X) permite obtener valores

estimados Y* a partir de los valores reales de X, entonces el

problema del ajuste de una funcin es que la diferencia o sesgo

(e

i

) entre los valores reales de y y los estimados Y* sea

mnimo, para cada valor se tendra: y - y* = e.

El mtodo consiste en minimizar la suma de sus cuadrados:

derivando respecto de las dos incgnitas a y b, igualando a

cero y despejando. Queda un sistema de dos ecuaciones con

dos incgnitas, que al resolverlo permiten hallar las

denominadas ecuaciones paramtricas de regresin

Consideremos la ecuacin de la recta :

que tiene dos parmetros a y b. Estos parmetros son

determinados al aplicar el Mtodo de los Mnimos

Cuadrados, que significa minimizar la expresin

4.- La lnea recta de Regresin:

y* = a + bx

e

i

2

= (Yi Yi*)

2

= Mnima

Para minimizar se usan las relaciones:

Resolviendo estas relaciones se obtienen Ecuaciones

Normales o Parmetros de Regresin

5.- Mtodo de los Mnimos Cuadrados:

X

2

. Y - X. XY

n X

2

- ( X)

2

a =

De las ecuaciones normales se obtiene los parmetros a

y b:

n XY - X Y

n X

2

- ( X)

2

b =

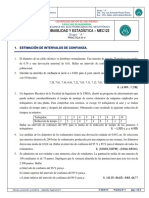

EJEMPLO 1 Supongamos que se quiere estimar la relacin

entre ingreso y consumo. Para el efecto se eligi una muestra

de 6 familias.

Dados los datos, se define la

variable dependiente (y = Consumo) y la

variable independiente (x = Ingreso), luego se construye el

Cuadro N 1, donde estn los valores que participan en las

ecuaciones normales.

INGRESO

x

CONSUMO

y

35

40

38

55

42

60

30

35

30

50

35

50

270 230

Cuadro N 01

INGRESO Y CONSUMO DE UNA

MUESTRA DE 6 FAMILIAS

Diagrama de dispersin

0

10

20

30

40

50

60

0 10 20 30 40 50 60 70

Consumo

I

n

g

r

e

s

o

INGRESO

X

CONSUMO

y

xy x

2

y

2

35

40

38

55

42

60

30

35

30

50

35

50

1050

1400

1140

2750

1470

3000

1225

1600

1444

3025

1764

3600

900

1225

900

2500

1225

2500

270 230 10810 12658 9250

X Y xy x

2

y

2

Cuadro N 01

INGRESO Y CONSUMO DE UNA MUESTRA DE 6 FAMILIAS

X

2

. Y - X. XY

n X

2

- ( X)

2

a =

n XY - X Y

n X

2

- ( X)

2

b =

12658(230) 270(10810)

6(12658) - (270)

2

a =

6(10810) 270(230)

6(12658)

2

- (270)

2

b =

= - 2.4147

= 0.9055

luego la recta de regresin es y* = -2,4147 + 0,9055 x

Diagrama de dispersin

0

10

20

30

40

50

60

0 10 20 30 40 50 60 70

Ingreso

C

o

n

s

u

m

o

6.- ERROR ESTNDAR DE ESTIMACIN:

Es una medida de esparcimiento alrededor de una lnea de

regresin. Es la desviacin estndar de los valores

observados Y con respecto a los valores Y* estimados por

la lnea de regresin.

y

2

- a y - b xy

n - 2

S

e

= S

yx

=

El error estndar de estimacin o de regresin mide la

dispersin de los valores alrededor de la lnea de

regresin.

Para el ejemplo anterior el error estndar de estimacin es:

9250 (- 2.4147)(230) (0.9055) (10810)

6-2

S

yx

=

S

yx

= 16.926

4

S

yx

= 2.05706

Ahora, suponiendo que y se distribuye normalmente, al

construir rectas paralelas a ambos lados de la lnea de

regresin a una distancia proporcional a S

yx

se definen

franjas o intervalos como se aprecia en el grfico

siguiente:

Segn la distribucin normal en los intervalos:

y* = S

yx

, se encuentra el 68.3% de los valores reales y

y * = 2S

yx

, se encuentra el 95.5% de los valores reales y

y * = 3S

yx

, se encuentra el 99.7% de los valores reales

+3S

yx

-3S

yx

+2S

yx

-2S

yx

+S

yx

-S

yx

Grfico de la distribucin normal en los intervalos

Antes de definir el coeficiente de determinacin, es necesario

justificar su uso mediante el examen de la lgica en la que se

basa su calculo.

Primero se comienza por considerar el punto correspondiente a

cualquier valor observado, y

i

, y se mide la distancia vertical

entre dicho punto y la recta y. A esto se le da el nombre de

desviacin total y se designa por (y

i

y).

Si se mide la distancia vertical entre la recta de regresin y la

recta y, se obtiene (y* - y), que se conoce como desviacin

explicada, ya que muestra en cuanto disminuye la desviacin

total cuando la recta de regresin se ajusta a los puntos.

Finalmente , se mide las distancia vertical entre el punto

observado y la recta de regresin para obtener (y

i

y*),

que se conoce como desviacin inexplicada ya que

representa la porcin de la desviacin total que no esta

explicada o tomada en cuenta por la introduccin de la

recta de regresin. Esto s emuestra en la siguiente figura:

Y

Desviacin inexplicada

(y

i

y*)

X

Desviacin explicada

(y* y)

Desviacin Total

(y

i

y)

y*

y

Diagrama de dispersin que

muestra la desviacin total, la

desviacin explicada y la no

explicada para un valor

seleccionado de Y.

Se aprecia entonces que la deviacin total parta una y

i

particular es igual a la suma de las desviaciones explicadas

e inexplicadas. Simbolicamente:

(y

i

y) = (y* y) + (y

i

y*)

desviacin desviacin desviacin

total explicada inexplicada

Si se miden estas desviaciones para cada valor de y

i

y y*,

se eleva al cuadrado cada desviacin y se suman todas ellas

para obtener:

(y

i

y)

2

= (y* y)

2

+ (y

i

y*)

2

Suma total Suma explicada Suma inexplicada

de cuadrados de cuadrados de cuadrados

(y

i

y)

2

= (y* y)

2

+ (y

i

y*)

2

Suma total Suma explicada Suma inexplicada

de cuadrados de cuadrados de cuadrados

STC = SCR + SEC

Suma total = Suma de cuadrados + Suma de error

de cuadrados debido a la de cuadrados

regresin lneal

STC=

y

i

2

- ( y

i

)

2

n

SCR=

x

i

2

- ( x

i

)

2

n

b

2

SEC = STC - SCR

7.- CLCULO DEL COEFICIENTE DE DETERMINACIN

El coeficiente de determinacin se calcula como:

R

2

= SCR

STC

que si se expresa en tanto por ciento, representa el

porcentaje de informacin que explica el modelo; es decir,

mide la proximidad del ajuste de la ecuacin de regresin de

la muestra a los valores observados de Y. tambin se

interpreta como el porcentaje de la variacin total en los y

i

es explicada por la regresin.

Ejemplo calcular el coeficiente de determinacin

para el ejemplo anterior.

R

2

= SCR = 416.5246 = 0.9612

STC 433.3333

STC=

9250 - (230)

2

=

6

SCT = 433.3333

SCR=

12658 - (270)

2

6

(0.9055)

2

= 416.5245

SEC = 433.3333 - 416.5246 = 16.8087

En los ejemplos anteriores usamos la lnea de mnimos

cuadrados para pronosticar el consumo de familias de

acuerdo al ingreso familiar; pero an, si interpretamos

correctamente la lnea como una lnea de regresin, todava

quedan cuestiones por resolver como:

Cun buenos son los valores obtenidos para a y b en la

ecuacin de los mnimos cuadrados o la ecuacin lneal?

Qu tan buena es una estimacin Y* ?

Asimismo, cuando estamos pensando en hacer pronsticos

podramos preguntarnos:

Podemos dar un intervalo para el cual podemos afirmar con

cierto grado de confianza que contendr la estimacin de y*

cuando la variable independiente tome un valor x?

En relacin a la primera pregunta a y b (coeficiente de

regresin estimados) son solo estimaciones basadas en datos

muestrales y esto implica la existencia de valores reales

correspondientes, generalmente representados por y

conocidos como los coeficientes de regresin. En forma

correspondiente tambin hay una lnea de regresin real

y/x

= + X, donde

y/x

es la media real de Y para un valor dado

de X.

En el anlisis de regresin lneal suponemos que las Xs

son constantes, no valores de variables aleatorias y que para

cada valor de X la variable que se debe de pronosticar, Y,

tiene cierta distribucin cuya media es + . En el anlisis

de regresin normal suponemos adems que todas estas

distribuciones son distribuciones normales con la misma

desviacin estndar .

8.- CORRELACIN LINEAL:

La correlacin expresa el grado de asociacin o afinidad

entre las variables consideradas; la correlacin tambin

explica el grado de la bondad del ajuste de las lneas de

regresin

Denota la interdependencia entre datos cuantitativos o

cualitativos

8.1 COEFICIENTE DE CORRELACIN RECTILINEA

El Coeficiente de correlacin, es el estadgrafo

que expresa o mide el grado de asociacin o

afinidad entre las variables relacionadas, se

denota por R y se define como:

R = SCR

STC

Ejemplo, calcular el coeficiente de correlacin para el

ejercicio anterior:

0.9804

R =

R = SCR

STC

R = 416.5246

433.3333

PROPIEDADES DE R

Como R

2

es siempre positivo resulta que la propiedad

fundamental del coeficiente de correlacin es:

De donde se deduce que:

a) Si R > 0, entonces existe correlacin directa positiva

b) Si R < 0, se trata de una correlacin inversa negativa

c) Si R

2

= 1 los datos forman una lnea recta, en el caso de

correlacin rectilnea

d) Si R = +1, hay una correlacin perfecta positiva

e) Si R = - 1, hay una correlacin perfecta negativa

f) Si R = 0, los datos son incorrelacionados.

-1 R +1

Tabla de Interpretacin de la Correlacin

Otro mtodo: Frmula de Thurstone

X

i

Y

i

n X Y

X

i

2

n X

2

Y

i

2

n Y

2

R =

10810 6(45)(38.3333)

12658 6 (45)

2

9250 6(38.3333)

2

R =

R = 0.980426

El coeficiente de correlacin de la poblacin es la raz

cuadrada de

2

el coeficiente de determinacin de la

poblacin previamente estudiada, y dado que ste toma

valores entre 0 y 1 inclusive, puede tomar cualquier

valor entre -1 y +1.

El signo de siempre ser igual al signo de (poblacin

o b para la muestra), la dependiente de la recta de

regresin de la poblacin para X e Y.

Você também pode gostar

- AASHTO T180 Proctor ModificadoDocumento16 páginasAASHTO T180 Proctor Modificadoerick308591% (11)

- Ejercicios de Hipótesis PareadasDocumento23 páginasEjercicios de Hipótesis PareadasCarlos López100% (2)

- Problemas Sobre Tablas de FrecuenciasDocumento2 páginasProblemas Sobre Tablas de FrecuenciasVanessa Medina100% (5)

- Procesos PsicologicosDocumento7 páginasProcesos PsicologicosMiguelAngelIturraAinda não há avaliações

- Regresion LinealDocumento24 páginasRegresion LinealGeorge MarriottAinda não há avaliações

- Ejercicios Distribucion Normal Estandar-1Documento7 páginasEjercicios Distribucion Normal Estandar-1erika quishpeAinda não há avaliações

- 005-11 - CORRALES INGENIEROS - Reajuste de Precios en ObrasDocumento3 páginas005-11 - CORRALES INGENIEROS - Reajuste de Precios en ObrasWilber Claudio GonzalesAinda não há avaliações

- Examen Parcial UnhnnnDocumento1 páginaExamen Parcial UnhnnnMarioSedanoArecheAinda não há avaliações

- Doctrinas Gnoseologicas PDFDocumento15 páginasDoctrinas Gnoseologicas PDFMarioSedanoArecheAinda não há avaliações

- Responsabilidad Medica (1) CallDocumento16 páginasResponsabilidad Medica (1) CallMarioSedanoArecheAinda não há avaliações

- Documentos Originales SolicitudDocumento3 páginasDocumentos Originales SolicitudMarioSedanoArecheAinda não há avaliações

- MACUTODocumento3 páginasMACUTOMarioSedanoArecheAinda não há avaliações

- Tema 1Documento86 páginasTema 1GzBladi Mamani CuaylaAinda não há avaliações

- SEDAMDocumento1 páginaSEDAMMarioSedanoArecheAinda não há avaliações

- In S Talar Latex en WindowsDocumento11 páginasIn S Talar Latex en WindowsCesar Vera ParamoAinda não há avaliações

- Trip TicoDocumento2 páginasTrip TicoMarioSedanoArecheAinda não há avaliações

- Doctrinas Gnoseologicas PDFDocumento15 páginasDoctrinas Gnoseologicas PDFMarioSedanoArecheAinda não há avaliações

- Control - Interno de Produccion - Pagi22Documento51 páginasControl - Interno de Produccion - Pagi22AmadoUlloaDECorazonAinda não há avaliações

- Guia de Laboratorio 3 Densidad y ProctorDocumento12 páginasGuia de Laboratorio 3 Densidad y ProctorMarioSedanoArecheAinda não há avaliações

- Statistics Lab 1 SpssDocumento13 páginasStatistics Lab 1 SpssMarioSedanoArecheAinda não há avaliações

- TALLERES DE ESATDISTICA 2 Y 3 Actualizado PDFDocumento16 páginasTALLERES DE ESATDISTICA 2 Y 3 Actualizado PDFNESTOR ELIECER GAMARRA GUERREROAinda não há avaliações

- Examen Final - Semana 8 - 10Documento11 páginasExamen Final - Semana 8 - 10Yesid CotrinaAinda não há avaliações

- Actividad de Puntos Evaluables - Escenario 6 - Primer Bloque-Ciencias Basicas - Virtual - Estadística Inferencial - (Grupo b04)Documento5 páginasActividad de Puntos Evaluables - Escenario 6 - Primer Bloque-Ciencias Basicas - Virtual - Estadística Inferencial - (Grupo b04)nicolasAinda não há avaliações

- Precertamen 3Documento2 páginasPrecertamen 3Celeste BurgosAinda não há avaliações

- Excel Ingenieros-Sesion 3-Tarea-1.1-DataDocumento4 páginasExcel Ingenieros-Sesion 3-Tarea-1.1-DataRosaAinda não há avaliações

- Gijs S Homework TemplateDocumento8 páginasGijs S Homework Templatecamila arangoAinda não há avaliações

- Ejercicios de Regresión LinealDocumento4 páginasEjercicios de Regresión LinealHUSTON MAX PEÑA ALAGÓNAinda não há avaliações

- ANOVA Sem13Documento49 páginasANOVA Sem13Eduardo AndradersAinda não há avaliações

- LOML TAREA - MergedDocumento4 páginasLOML TAREA - MergedLeidy Lopez MorenoAinda não há avaliações

- Taller Unidad 1 (Ene-Jun 2023)Documento7 páginasTaller Unidad 1 (Ene-Jun 2023)AliciaAinda não há avaliações

- Ejer Cici OsDocumento15 páginasEjer Cici OsJUAN CARLOS HUISA GAMARRA50% (10)

- Actividades Probabilidad y EstadisticaDocumento4 páginasActividades Probabilidad y EstadisticaTinkyWinkyAinda não há avaliações

- U3A12 Solanor AnacristinaDocumento3 páginasU3A12 Solanor AnacristinaJUAN MEDINAAinda não há avaliações

- Esp U3 Ea ErhsDocumento6 páginasEsp U3 Ea ErhsEmmanuel OsorioAinda não há avaliações

- Metodología para Entender El Test de Zivot Y AndrewDocumento11 páginasMetodología para Entender El Test de Zivot Y AndrewKatia Baquerizo MartinezAinda não há avaliações

- Caso PracticoDocumento6 páginasCaso Practicohector jhaziel reyes garciaAinda não há avaliações

- Primer Taller Estadística 2Documento4 páginasPrimer Taller Estadística 2Felipe Mesa Alvarado100% (2)

- Actividad 7 Taller de Regresión y Correlación LinealDocumento6 páginasActividad 7 Taller de Regresión y Correlación LinealTatiana MILLAN MARTINEZAinda não há avaliações

- PrácticaDocumento6 páginasPrácticaJonathanAinda não há avaliações

- EsstDocumento33 páginasEsstHERNEYSAinda não há avaliações

- MetodologíaDocumento55 páginasMetodologíamirellaAinda não há avaliações

- Problemas Tema 4Documento2 páginasProblemas Tema 4Gema MacíasAinda não há avaliações

- Tarea de Estadistica 2Documento5 páginasTarea de Estadistica 2Gabriel Quispe SanesAinda não há avaliações

- Regresion y Correlacion LinealDocumento11 páginasRegresion y Correlacion LinealContreras NefAinda não há avaliações

- Lista2 IC Media Stat Apli NegociosDocumento5 páginasLista2 IC Media Stat Apli NegociosFLOR LENNY ALVAREZ VENGOAAinda não há avaliações