Escolar Documentos

Profissional Documentos

Cultura Documentos

Intro Proc Est

Enviado por

carlos eduardoDireitos autorais

Formatos disponíveis

Compartilhar este documento

Compartilhar ou incorporar documento

Você considera este documento útil?

Este conteúdo é inapropriado?

Denunciar este documentoDireitos autorais:

Formatos disponíveis

Intro Proc Est

Enviado por

carlos eduardoDireitos autorais:

Formatos disponíveis

Introduc ao aos Processos Estoc asticos

Eduardo F. Costa e Marinho G. Andrade

com a colaborac ao de Juliana Cobre

18 de abril de 2004

Sum ario

1 Processos de Bernoulli 2

1.1 O Processo de Bernoulli, X . . . . . . . . . . . . . . . . . . . . . 2

1.2 N umero de Sucessos em um Processo de Bernoulli, N . . . . . . . 4

1.2.1 Valor Esperado e Vari ancia de N . . . . . . . . . . . . . . 5

1.2.2 Distribuic ao de N . . . . . . . . . . . . . . . . . . . . . . 6

1.3 Tempo de Sucesso, T . . . . . . . . . . . . . . . . . . . . . . . . 9

1.3.1 Valor Esperado e Vari ancia de T . . . . . . . . . . . . . . 10

1.3.2 Distribuic ao de T . . . . . . . . . . . . . . . . . . . . . . 11

1.4 Exerccios . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 12

2 Processo de Poisson 15

2.1 Hip oteses do Processo de Poisson . . . . . . . . . . . . . . . . . 15

2.1.1 Distribuic ao de N

t

. . . . . . . . . . . . . . . . . . . . . 18

2.1.2 Valor Esperado de N

t

e o Signicado de . . . . . . . . . 19

2.1.3 Tempo de Chegada . . . . . . . . . . . . . . . . . . . . . 23

2.2 Tempo de Recorr encia (Forward) . . . . . . . . . . . . . . . . . . 26

2.3 Superposic ao de Processos de Poisson . . . . . . . . . . . . . . . 27

2.4 Decomposic ao de um Processo de Poisson . . . . . . . . . . . . . 28

2.5 Exerccios . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 29

1

Captulo 1

Processos de Bernoulli

Neste captulo estudaremos um processo estoc astico simples, denominado pro-

cesso de Bernoulli. Este e um processo a par ametro discreto no qual o conjunto

de par ametros e o conjunto dos n umeros inteiros, T N; al em disto, para cada

t N xo, ele assume apenas os valores discretos 0 e 1. Estudam-se tamb em dois

processos associados - o n umero de sucessos e o tempo de sucesso de um processo

de Bernoulli.

Apesar de sua simplicidade, o processo de Bernoulli serve para ilustrar concei-

tos, bem como algumas das principais quest oes que surgem, associados a processos

estoc asticos. Ainda, o n umero de sucessos consiste em um caso particular de ca-

deia de Markov, a qual ser a estudada em detalhes subsequentemente.

1.1 O Processo de Bernoulli, X

O processo de Bernoulli tem uma relac ao estreita com a id eia de ensaios de Ber-

noulli e de vari avel aleat oria binomial, conforme vimos em SCE-119. Recordando,

consideram-se um experimento E e um evento associado A, com probabilidade de

sucesso p; para n repetic oes independentes deste experimento, o n umero de suces-

sos obtido e uma vari avel aleat oria binomial com par ametros n e p.

Nesta sec ao, para cada repetic ao de E associaremos uma vari avel aleat oria X

n

,

que mapeia sucesso da n- esima repetic ao em 1 e fracasso em 0. Note que o

conjunto destas vari aveis, X = {X

n

, n = 1, 2, . . .}, satisfaz a denic ao de processo

estoc astico; este ser a o chamado processo de Bernoulli. Este processo e forma-

lizado a seguir, para facilitar futuras refer encias.

Denic ao 1. Considere uma sequ encia de repetic oes de um experimento E e os

eventos {A

n

; n =1, 2, . . .}, cada umdos quais estando associado ` a n- esima repetic ao.

2

Considere, ainda,

X

n

= I

{A

n

}

sendo I a func ao indicadora. O processo estoc astico X ={X

n

; n = 1, 2, . . .} e cha-

mado de processo de Bernoulli com probabilidade de sucesso p se:

(a) A

1

, A

2

, . . . s ao eventos independentes;

(b) P(A

n

) = p, P(

A

n

) = 1p, n = 1, 2, . . ..

Note que X

1

, X

2

, . . . s ao identicamente distribuidos e P e a unica medida de

probalidade em que satisfaz as propriedades (a) e (b).

E comum referir-se ao

evento A

n

={X

n

= 1} como sendo um sucesso e

A

n

={X

n

= 0} como fracasso.

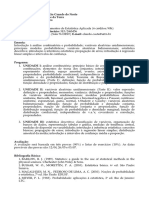

A Figura 1.1 ilustra uma realizac ao do processo X.

1 2 3 4 5 6 7 8 9 10

0

0.2

0.4

0.6

0.8

1

1.2

1.4

1.6

1.8

2

T

X

Figura 1.1: Realizac ao do processo de Bernoulli {X

n

, n = 1, 2, . . .}, com par ametro

p = 0, 3.

Exemplo 1. Devido a interfer encias que incidem em uma certa linha de trans-

miss ao de dados, h a uma probabilidade constante p = 0, 05 de que haja erro na

transmiss ao de um bit. Dena X

n

como 1 ou 0 se o n- esimo bit recebido for errado

ou correto, respectivamente. Assumindo que a interfer encia incide independente-

mente na transmiss ao de cada bit, as vari aveis aleat orias X

1

, X

2

, . . . s ao indepen-

dentes. Ent ao {X

n

; n = 1, 2, . . .} e um processo de Bernoulli com probabilidade de

sucesso P(X

n

= 1) = p = 0.05.

Exemplo 2. Considere o c alculo da probabilidade de que os primeiros 2 bits sejam

recebidos corretamente e que os dois bits subsequentes sejam recebidos com erro.

Temos:

P(X

1

= X

2

= 0, X

3

= X

4

= 1) = P(X

1

= 0)P(X

2

= 0)P(X

3

= 1)P(X

4

= 1)

= (1p)(1p)pp = (1p)

2

p

2

0, 00226

3

1.2 N umero de Sucessos em um Processo de Bernoulli, N

Considere as primeiras n tentativas de um processo de Bernoulli e considere o

n umero de sucessos obtido, denotado por N

n

. Note que N = {N

n

, n N} e um

processo estoc astico, o qual e estudado nesta sec ao.

Denic ao 2. Seja X um processo de Bernoulli com probabilidade de sucesso p.

Os n umeros de sucesso {N

n

, n N} s ao denidos por

N

n

(w) =

_

0 se n = 0,

X

1

(w) +X

2

(w) +. . . +X

n

(w) se n = 1, 2, . . .

Uma realizac ao do processo N e mostrada na Figura 1.2.

1 2 3 4 5 6 7 8 9 10

0

0.5

1

1.5

2

2.5

3

T

N

Figura 1.2: Realizac ao do processo {N

n

, n = 0, 1, . . . , 4} com par ametro p = 0, 3,

correspondente a realizac ao de X da Figura 1.1.

Observac ao 1. Note que

N

n+m

N

n

= X

n+1

+X

n+2

+. . . +X

n+m

e o n umero de sucessos associado ` as tentativas n+1, n+2, . . . , n+m. O processo

estoc astico {N

n

, n N} e um processo estoc astico a par ametro discreto e a v.a.

N

n

, com n xo, e discreta assumindo os valores 0, 1, 2, . . . n.

Exemplo 3. Considere a realizac ao do processo de Bernoulli da Figura 1.2. Note

que o conhecimento do processo N

n

permite recuperar o processo de Bernoulli

original fazendo X

n

= N

n

N

n1

, n = 1, 2, . . .. Ent ao, temos:

N

0

= 0; X

0

= 0

X

1

= N

1

N

0

= 0

4

X

2

= N

2

N

1

= 0

X

3

= N

3

N

2

= 0

X

4

= N

4

N

3

= 1,

em conformidade com a realizac ao de X dada na Figura 1.1.

1.2.1 Valor Esperado e Vari ancia de N

Se {X

n

; n = 1, 2, . . .} e um processo de Bernoulli com probabilidade de sucesso p.

Ent ao para qualquer n, temos:

(i) E(X

n

) = E(X

2

n

) = E(X

3

n

) = . . . = p

(ii) Var(X

n

) = E(X

2

n

) E

2

(X

n

) = pp

2

= p(1p) = p q

(iii) E(

X

n

) =

0

P(X

n

= 0) +P(X

n

= 1) = q+p

onde 0.

As propriedades (i), (ii) e (iii) s ao provadas usando

E[g(X

n

)] = g(1) p+g(0) (1p),

onde g() e uma func ao limitada. Para (iii) temos g(X

n

) =

X

n

Usando a propriedade de linearidade do valor esperado e os resultados apre-

sentados acima para X

n

, temos:

(i) E(N

n

) = E(X

1

+X

2

+. . . +X

n

) = np;

(ii) Var(N

n

) =Var(X

1

+X

2

+. . . +X

n

) = npq;

(iii) E(N

2

n

) =Var(N

n

) +E

2

(N

n

) = npq+n

2

p

2

.

Podemos obter o valor E(N

2

n

) de forma direta como segue:

N

2

n

=

n

i=1

X

i

2

+

n

i=1

n

j=i

X

i

X

j

E(N

2

n

) =

n

i=1

E(X

i

2

) +

n

i=1

n

j=i

E(X

i

X

j

)

sendo E(X

i

2

) = p e E(X

i

X

j

) = p

2

temos que:

E(N

2

n

) = np+n(n1)p

2

= np+n

2

p

2

np

2

= np(1p) +n

2

p

2

= npq+n

2

p

2

Estes c alculos indicam um caminho para se calcular os momentos de ordem

mais elevada para N

n

. Note que calculamos E(N

n

), Var(N

n

) sem conhecermos a

5

func ao distribuic ao de N

n

. No entanto se quisermos calcular E(g(N

n

)) onde g()

e uma func ao limitada e necess ario conhecermos a func ao distribuic ao de N

n

. O

uso da probabilidade condicional nas provas que se seguem e uma das principais

t ecnicas usadas em estudos de processos estoc asticos.

1.2.2 Distribuic ao de N

Um ponto fundamental para a an alise de um processo consiste em estabelecer as

distribuic oes e distribuic oes condicionadas. No caso emquest ao (processo {N

n

, n

N}), iniciamos observando que a vari avel aleat oria N

n

e binomial com par ametro

p, o que permite escrever o seguinte resultado, de imediato; a prova e omitida.

Lema 1. Para qualquer n N,

P(N

n

= k) =

_

n

k

_

p

k

(1p)

nk

.

Recordando da Observac ao 1 que N

n+m

N

n

=X

n+1

+. . . +X

n+m

e a soma de n

vari aveis aleat orias independentes, e simples compreender que N

n+m

N

n

tamb em

tem distribuic ao binomial, como formalizado adiante.

Corol ario 1. Para qualquer n, m N,

P(N

m+n

N

m

= k) =

_

n

k

_

p

k

(1p)

nk

.

Teorema 1. Para qualquer n, m N

P(N

m+n

N

m

= k|N

0

, . . . , N

m

) = P(N

m+n

N

m

= k) =

_

n

k

_

p

k

(1p)

nk

Demonstrac ao. As vari aveis aleat orias N

0

, N

1

, . . . , N

m

s ao determinadas por X

1

, X

2

, . . . , X

m

e vice-versa, da seguinte forma:

X

1

= N

1

, X

2

= N

2

N

1

, . . . , X

m

= N

m

N

m+1

,

de maneira que

P(N

m+n

N

m

= k|N

0

, . . . , N

m

) = P(N

n+1

N

m

= k|X

1

, X

2

, . . . , X

m

).

Como {X

m+1

, . . . , X

m+n

} e independente de {X

1

, . . . , X

m

} temos que N

m+n

N

m

=

X

m+1

, . . . , X

m+n

e independente de {X

1

, X

2

, . . . , X

m

}, logo podemos escrever

P(N

m+n

N

m

= k|X

1

, . . . , X

m

) = P(N

m+n

N

m

= k)

e o Corol ario 1 completa a prova.

6

Observac ao 2. O Teorema 1 arma que as distribuic oes do processo N relativas

` as tentativas m+1, . . . , m+n s ao independentes da hist oria passada at e m (i.e.,

a hist oria passada e irrelevante). Este e um caso particular de quando a hist oria

passada at e m1 e irrelevante mas a hist oria em m e relevante; os processos

que satisfazem esta propriedade s ao denominados Markovianos. Em conson ancia,

lembre que o processo N e um caso particular de cadeia de Markov, como j a

comentamos.

Corol ario 2. Seja n

0

=0 <n

1

<n

2

< <n inteiros. Ent ao as vari aveis aleat orias

N

n

1

N

n

0

, N

n

2

N

n

1

, . . . , N

n

j

Nn

j1

, s ao independentes.

Demonstrac ao. Seja j = 3, sem perda de generalidade. Usando o Teorema 1, ava-

liamos:

P(N

n

3

N

n

2

,N

n

2

N

n

1

, N

n

1

)

= P(N

n

3

N

n

2

|N

n

2

N

n

1

, N

n

1

)P(N

n

2

N

n

1

, N

n

1

)

= P(N

n

3

N

n

2

)P(N

n

2

N

n

1

, N

n

1

)

= P(N

n

3

N

n

2

)P(N

n

2

N

n

1

|N

n

1

)P(N

n

1

)

= P(N

n

3

N

n

2

)P(N

n

2

N

n

1

)P(N

n

1

)

Observac ao 3 (Incrementos Independentes). Vari aveis aleat orias da forma N

m+n

N

m

associada ao processo N podem ser encaradas como o incremento do pro-

cesso no intervalo entre t =me t =m+n, no sentido que representama quantidade

da qual o processo aumentou neste intervalo, ou seja,

N

n+m

= N

m

+(N

m+n

N

m

).

O Corol ario 2 nos diz que os incrementos no processo N s ao independen-

tes ao longo de certos intervalos (note que os intervalos s ao disjuntos, isto e, a

intersec ao entre eles e nula). Quando um processo apresenta esta caracterstica,

dizemos que tem incrementos independentes.

Note que a independ encia de N

m+n

N

m

com relac ao a N

0

, . . . , N

m

foi provada

sem lancar m ao da distribuic ao de X

n

. Portanto o Corol ario 2 e verdadeiro para

qualquer processo {Z

n

, n N}, denido por:

Z

n

=

_

0 se n = 0

Y

1

+Y

2

+ +Y

n

se n 1

sendo Y

1

+Y

2

+ +Y

n

vari aveis aleat orias independentes. Se os Y

i

s tamb em

s ao identicamente distribudos, ent ao a distribuic ao do incremento Z

m+n

Z

m

n ao

7

depende de m e, neste caso, diz-se que o processo {Z

n

; n N} possui incrementos

independentes e estacion arios.

Exemplo 4. Considere novamente o processo de Bernoulli do Exemplo 1. Calcule

a probabilidade conjunta P(N

5

= 4, N

7

= 5, N

13

= 8), bem como E(N

5

N

8

).

Soluc ao: o evento (N

5

= 4, N

7

= 5, N

13

= 8) e equivalente ao evento (N

5

= 4, N

7

N

5

= 1, N

13

N

7

= 3) e empregando o Teorema 1 e o Corol ario 2, escrevemos:

P(N

5

= 4, N

7

= 5, N

13

= 8) = P(N

5

= 4, N

7

N

5

= 1, N

13

N

7

= 3)

= P(N

5

= 4)P(N

7

N

5

= 1)P(N

13

N

7

= 3)

=

_

5

4

_

p

4

(1p)

7

_

2

1

_

p

1

(1p)

1

_

6

3

_

p

3

(1p)

3

.

Portanto,

P(N

5

= 4, N

7

= 5, N

13

= 8) = 200p

8

(1p)

11

= .

Para calcular E(N

5

N

8

), escrevemos

N

8

= N

5

+N

8

N

5

e, portanto,

E(N

5

N

8

) = E[N

5

(N

5

+N

8

N

5

)] = E[N

5

2

+N

5

(N

8

N

5

)]

= E(N

5

2

) +E(N

5

)E(N

8

N

5

) = 5p

2

+5pq+5p3p

= 23p

2

+5pq+15p

2

= 40p

2

+5pq

Finalizamos esta sec ao com um resultado util para c alculo de valores espera-

dos.

Teorema 2. Considere umprocesso de Bernoulli e os n umeros de sucessos N

m

, N

m+1

, . . ..

Ent ao,

E(g(N

m

, . . . , N

m+n

)|N

0

, . . . , N

m

) = E(g(N

m

, . . . , N

m+n

)|N

m

)

Observac ao 4. Note que o Teorema 2 diz que a hist oria passada (N

0

, . . . , N

m1

) e

irrelevante para o c alculo de valores esperados associados ` as tentativas futuras.

Repare na conex ao disto com os coment arios da Observac ao 2.

Exerccio 1. Calcule: (i)E(N

5

|N

3

); (ii)E(N

5

N

11

|N

2

, N

3

).

Exerccio 2 (Para entregar). Seja p =0, 1. Calcule E(N

2

N

4

). Simule 5 realizac oes

para o processo N e calcule a m edia para N

2

N

4

; compare com o valor te orico.

8

1.3 Tempo de Sucesso, T

Um outro importante processo associado a um processo de Bernoulli {X

n

, n =

1, 2, . . .} e o denominado tempo de sucesso, denotado por {T

k

, n N}, que con-

siste basicamente nos intantes de ocorr encia do k- esimo sucesso. O conceito e mais

facilmente entendido atrav es da ilustrac ao na Figura 1.3, que associa o processo T

aos processos X e N.

Figura 1.3: Figura ainda n ao disponvel...

Denic ao 3. Sejam {X

n

; n 1} um processo de Bernoulli com probabilidade p de

sucessos e {N

n

, n N} os n umeros de sucesso associados. Os tempos de sucesso

{T

k

, k N} s ao denidos por

T

k

(w) =

_

0 k = 0

min

n

{n : N

n

(w) k} k = 1, 2, . . .

(1.1)

Observac ao 5. Similarmente ao que ocorria comos n umeros de sucesso, as vari aveis

aleat orias T

k

s ao determinadas por X

n

bem como por N

n

e vice-versa. De fato, as

seguintes armac oes podem ser facilmente deduzidas:

i) T

k

= n N

n1

= k 1 e N

n

= k.

ii) T

k

n N

n

k (o k- esimo sucesso ocorre at e n se, e somente se, o n umero

de sucessos nas primeiras n tentativas e pelo menos k).

iii) T

k

= kI

{X

j

=1}

, k = 1, 2, . . ..

iv)

_

X

n

= 1, k : n = T

k

X

n

= 0, c.c..

Note que T

k

T

kj

e o intervalo entre o (k j)- esimo sucesso e o k- esimo su-

cesso. Como veremos a seguir, vari aveis aleat orias desta forma s ao independentes

sempre que os intervalos aos quais elas se referem n ao se intercalam.

Lema 2. T

1

, T

2

T

1

, T

3

T

2

, . . . s ao v.a. independentes e identicamente distribui-

das (i.i.d.) com distribuic ao

P(T

k

T

k1

= j) = p(1p)

j1

. (1.2)

9

Demonstrac ao. Parte a) Empregando a relac ao da Observac ao 5 (iv), avaliamos

P(T

1

= j

1

, T

2

T

1

= j

2

) = P(T

1

= j

1

|T

2

T

1

= j

2

)P(T

2

T

1

= j

2

)

= P(X

0

= 0, X

1

= 0. . . , X

j

1

1

= 0, X

j

1

= 1|

X

j

1

+1

= 0, . . . , X

j

1

+j

2

1

= 0, X

j

1

+j

2

= 1)P(T

2

T

1

= j

2

)

= P(X

0

= 0, X

1

= 0. . . , X

j

1

1

= 0, X

j

1

= 1)P(T

2

T

1

= j

2

)

= P(T

1

= j

1

)P(T

2

T

1

= j

2

)

sendo que na p en ultima passagem usamos o fato de que X

n

e X

m

s ao independentes

para n = m. A prova pode ser concluida usando o mesmo argumento, indutiva-

mente. Por exemplo,

P(T

1

= j

1

,T

2

T

1

= j

2

, T

3

T

2

= j

3

)

= P(T

1

= j

1

, T

2

T

1

= j

2

|T

3

T

2

= j

3

)P(T

3

T

2

= j

3

)

= P(T

1

= j

1

, T

2

T

1

= j

2

)P(T

3

T

2

= j

3

)

= P(T

1

= j

1

)P(T

2

T

1

= j

2

)P(T

3

T

2

= j

3

)

Parte b) Dada a independ encia demonstrada na parte (a), temos que

P(T

k

T

k1

= j) = P(T

k

T

k1

= j|T

k1

)

= P(X

T

k1

+1

= 0, . . . , X

T

k1

+j1

= 0, X

T

k1

+j

= 1|T

k1

)

= (1p)

j1

p

1.3.1 Valor Esperado e Vari ancia de T

E possvel calcular E(T

k+1

T

k

) e Var(T

k+1

T

k

) diretamente, empregando o fato

de T

k+1

T

k

ter a distribuic ao geom etrica dada no Lemma 2. Por exemplo,

E(T

k+1

T

k

) =

j=1

j pq

j1

=

1

p

.

Similarmente,

Var(T

k+1

T

k

) =

(1p)

p

2

.

Como T

k

= T

1

+(T

2

T

1

) + +(T

k

T

k1

), segue que T

k

e a soma de k vari aveis

aleat orias i.i.d., e podemos escrever:

E(T

k

) = E(T

1

) + +E(T

k

T

k1

) =

k

p

,

assim como

Var(T

k

) =

k(1p)

p

2

.

10

1.3.2 Distribuic ao de T

Teorema 3. Para qualquer k {1, 2, . . . }, tem-se:

i)

P(T

k

= n) =

_

n1

k 1

_

p

k

q

nk

, n = k, k +1, . . . ;

ii)

P(T

k

n) =

n

j=k

_

n

j

_

p

j

q

nj

, n = k, k +1, . . . .

Demonstrac ao. Inicialmente, note que T

k

(w) k para qualquer w , pois o k-

esimo sucesso n ao pode ocorrer em menos do que k tentativas. Desta forma, para

n < k teremos P(T

k

= n) = 0, bem como P(T

k

n) P(T

k

k) = P() = 1. Na

sequ encia, consideraremos n k.

i) Conforme foi comentado na Observac ao 5,

T

k

= n N

n1

= k 1 e N

n

= k

e, portanto,

P(T

k

= n) = P(N

n1

= k 1, N

n

= k)

= P(N

n1

= k 1, N

n

N

n1

= 1)

Em seguida, empregando o Corol ario 2 e o Teorema 1, avaliamos:

P(T

k

= n) = P(N

n1

= k 1, N

n

N

n1

= 1)

= P(N

n1

= k 1)P(N

n

N

n1

= 1)

=

_

n1

k 1

_

p

k1

(1p)

n1k+1

p =

_

n1

k 1

_

p

k

(1p)

nk

.

ii) Conforme a Observac ao 5 (ii),

T

k

n N

n

k,

Assim, para n k, de acordo com o Lema 1, temos:

P(T

k

n) = P(N

n

k) =

n

j=k

P(N

n

= j) =

n

j=k

_

n

j

_

p

j

q

nj

11

Exemplo 5. Calcule i) P(T

3

= 5); ii) P(T

3

= 5|T

1

); iii) P(T

3

= 5) =

j=0

P(T

3

=

5|T

1

= j)P(T

1

= j) e compare com (i).

Soluc ao: i) P(T

3

= 5) =

_

4

2

_

p

3

(1p)

2

;

ii) P(T

3

= 5|T

1

) = P(T

3

T

1

= 5T

1

|T

1

= j

1

)

= P(T

2

= 5 j

1

) =

_

4T

1

1

_

p

2

(1p)

3T

1

;

iii) P(T

3

= 5) =

j=0

P(T

3

= 5|T

1

= j)P(T

1

= j)

=

3

j=1

_

4 j

1

_

p

2

(1p)

3j

_

j 1

0

_

p

1

(1p)

j1

=

3

j=1

_

4 j

1

_

p

3

(1p)

2

=

_

4

2

_

p

3

(1p)

2

Exemplo 6. Para um evento A qualquer, sabe-se que

E(I

A

) = P(A).

Este fato pode ser usado, em conjunto com a lei dos grandes n umeros, para inferir

probabilidades. Por exemplo, com p = 0, 3, simulando 100.000 realizac oes para

T

3

, obtendo os valores de I

{T

3

=5}

, e calculando a m edia obtemos:

m edia de I

{T

3

=5}

= 0, 0793.

Conrmando o resultado,

E(I

{T

3

=5}

) = P(T

3

= 5) =

_

4

2

_

p

3

(1p)

2

= 0, 0794.

Exemplo 7. Calcule P()

1.4 Exerccios

Exerccio 3. Considere uma possvel realizac ao = (S, F, F, S. . .) de uma seq u encia

de lancamentos independentes com dois possveis resultados S e F. Determine o

valor da vari avel aleat oria.

12

Exerccio 4. Seja {X

n

; n = 1, 2, . . .} um processo de Bernoulli.

Se p = P(X

n

= 1) = 0.05

a) Qual a probabilidade de X

1

= 1, X

2

= 1 e X

3

= 1 ?

b) P(N

3

= 1) ?

Exerccio 5. Seja {X

n

; n = 1, 2, . . .} um processo de Bernoulli. Calcule:

a)P(N

1

= 0, N

2

= 0, N

3

= 1, N

4

= 1)

b)P(N

1

= 0, N

3

= 2, N

3

= 1, N

4

= 2)

c)P(N

8

= 6, N

15

= 12)

Exerccio 6. No problema mostrado no exemplo 4, qual a probabilidade de um

mancal estar dentro da especicac ao ? Qual a probabilidade de um rebite sair da

especicac ao ? Qual e o valor esperado de pecas fora da especicac ao depois de

400 fabricadas ?

Exerccio 7. Para p = 0.8, calcule:

a)E(N

3

)

b)E(N

7

)

c)E(N

3

+4N

7

)

d)Var(N

3

)

e)Var(N

7

N

3

)

f)E(6N

4

+N

7

|N

2

)

Exerccio 8. Considere o processo de Bernoulli com probabilidade p = 0.8 . As

cinco primeiras tiragens resultam em {SFFSS} . Determinar o valor esperado de

N

3

+2N

7

dado o hist orico.

Exerccio 9. Mostrar que E(N

n+m

|N

n

) = N

n

+mp .

Exerccio 10. Sejam N

n

o n umero de veculos que passam por um certo ponto no

intervalo (0, n], e T

k

marca o tempo (em segundo) do k- esimo veculo ter passado

por tal ponto. Suponha a taxa de passagem de 4 veculos/minuto. Calcule:

a) p = P(X

n

= 1)

b) P(T

4

T

3

= 12)

c)E(T

4

T

3

) , E(T

13

T

3

)

d) Var(T

2

+5T

3

)

Exerccio 11. Prove que P(T

8

= 17|T

0

, . . . , T

7

) = pq

16T

7

, {T

7

16} .

Exerccio 12. Mostre que

E(T

m+n

|T

n

) = T

n

+

m

p

.

13

Exerccio 13. Calcule:

a)P(T

1

= k, T

2

= m, T

3

= n), k < m < n .

b)P(T

3

= n|T

1

= k, T

2

= m)

c)E(T

3

|T

1

= k, T

2

= m)

d)E[g(T

3

)|T

1

, T

2

] para g(b) =

b

, [0, 1] .

Exerccio 14. Se uma vari avela aleat oria T tem distribuic ao geom etrica, ent ao

P(T > n+m|T > n) = q

m

= P(T > m)

para todo n e m. Mostre que a recproca e tamb em verdadeira: se uma

vari avela aleat oria T e tal que

P(T > n+m|T > n) = P(T > m)

para todo m, n N ent ao T tem distribuic ao geom etrica.

Exerccio 15. A probabilidade de um motorista parar para um caroneiro e p =

0.04; e claro que motoristas diferentes fazem sua decis ao de parar ou n ao inde-

pendente de cada um. Dado que nosso caroneiro contou que 30 carros passaram

sem lhe dar carona, qual a probabilidade de ser pego pelo 37

o

motorista ou antes?

Exerccio 16. Seja a chegada de carros descrita no exerccio anterior. Imagine

que dois carros passam a cada minuto (determinsticamente). Seja S o tempo em

segundos em que ele nalmente consegue a carona.

a) Ache a distribuic ao de S; calcule E(S), Var(S).

b) Dado que depois de 5 minutos, durante os quais 10 carros passaram, o

caroneiro ainda continua no seu lugar, calcule o valor esperado de T.

Exerccio 17. Um duelo entre dois homens e feito em rounds, da seguinte forma:

em cada round, ambos atiram simultaneamente e a probabilidade de o 1

o

matar

o 2

o

e p

1

, e do 2

o

matar o 1

o

e p

2

(n ao necessariamente p

1

+ p

2

= 1). Ache a

probabilidade de que:

a) o duelo termine no 13

o

round.

b) o 1

o

termine vivo.

c) o duelo termine no 13

o

round com o 1

o

vivo.

DICA: crie um processo de Bernoulli identiando

sucesso um ou ambos homens morrem no n- esimo round.

14

Captulo 2

Processo de Poisson

No captulo anterior estudamos processos estoc asticos discretos bastante simples.

A partir de agora estudaremos o processo de Poisson, um processo estoc astico si-

milar ao processo de n umero de sucessos de um processo de Poisson. Este processo

e simples do ponto de vista conceitual e intuitivo, mas e contnuo no tempo, o que

traz uma certa compexidade analtica.

Diferentemente do processo de Bernoulli e dos processo de n umero de sucessos

e de tempo de sucessos associados, cujo apelo era mais did atico do que aplicativo,

o processo de Poisson encontra diversas aplicac oes, como em telefonia, no estudo

de chegada de clientes em uma loja, ou de sadas de pecas de um estoque.

2.1 Hip oteses do Processo de Poisson

H a um certo processo estoc astico, denominado de processo de contagem de che-

gadas, que e util para descrever o processo de Poisson. No processo de contagem

de chegada {N

t

, t 0}, em cada instante de tempo t 0, a vari avel aleat oria N

t

registra o total do n umero de chegadas.

Em termos formais, N ={N

t

; t 0} e tal que para cada w o mapeamento

t N

t

(w) e n ao decrescente, aumenta somente por saltos, e contnuo a direita e

N

0

(w) = 0, onde N

t

(w) e o n umero de chegadas no intervalo [0, t] para a realizac ao

w . Note que N e um processo estoc astico a par ametro (de tempo) contnuo e

com espaco de estado discreto N = {0, 1, 2, . . .}. Veja um exemplo de realizac ao

do processo na Figura 2.1.

Quando o processo de contagem satisfaz certas hip oteses (simplicadoras),

ent ao diz-se que ele e um processo de Poisson. Desta forma, o processo de Poisson

consiste em um caso particular do processo de contagem de chegadas, para o qual

certas hip oteses valem.

15

Figura 2.1: Figura ainda n ao disponvel... Realizac ao do processo de contagem

{N

n

, n N}.

Se por umlado e verdade que e relativamente difcil que as hip oteses de Poisson

sejam perfeitamente vericadas na pr atica, por outro lado em um grande n umero de

aplicac oes elas representam boas aproximac oes, e por isto o processo de Poisson e

considerado um bom modelo para diversos processos de contagem. Estudaremos

as hip oteses de Poisson a seguir.

Notac ao 1. Chama-se N

t+s

N

t

o n umero de chegadas no intervalo (t, t+s].

Recorde, da Observac ao 3, que o n umero de sucessos do processo de Ber-

noulli tem incrementos independentes, pois os incrementos em intervalos dis-

juntos eram independentes.

A priemira hip otese considerada e uma transposicao direta: o n umero de che-

gadas em um certo intervalo e independente do n umero de chegadas em um outro

intervalo. N os formalizamos a noc ao de incrementos independentes, para referen-

cia posterior, da seguinte forma.

Denic ao 4 (Incrementos Independentes). Considere um processo estoc astico

{Z

k

, k T}, sendo T o conjunto de par ametros. Se as vari aveis aleat orias Z

k

1

+k

2

Z

k

1

e Z

k

3

+k

4

Z

k

3

forem independentes para quaisquer k

1

, k

2

, k

3

, k

4

tais que os in-

tervalos (k

1

, k

1

+k

2

] (k

3

, k

3

+k

4

] forem disjuntos, ent ao dizemos que o processo

tem incrementos independentes.

A segunda hip otese consiste no fato que os incrementos dependem do compri-

mento do intervalo, mas n ao de sua localizac ao; ou seja, o n umero de chegadas

N

t+s

N

t

, t, s 0, depende de s mas n ao de t. Dada esta independ encia do tempo,

dizemos que o processo e estacion ario. Novamente, h a semelhanca com o n umero

de sucessos em um processo de Poisson, pois quando tratamos dos incrementos

podamos fazer um shift no tempo. Formalizamos o conceito como segue.

Denic ao 5 (Incrementos Estacion arios). Considere um processo estoc astico

{Z

k

, k T}, sendo T o conjunto de par ametros. Se a distribuic ao da vari avel

aleat oria Z

t+s

Z

t

for independente de t, ent ao dizemos que o processo tem incre-

mentos estacion arios.

A terceira e ultima hip otese consiste no fato que n ao ocorrem chegadas si-

mult aneas. Se considerarmos, por exemplo, a chegada de pessoas a um est adio,

teremos que considerar que todas as pessoas chegam sozinhas.

Formalmente, temos:

16

Denic ao 6 (Chegadas n ao Simult aneas). Considere um processo de contagem

de chegadas {N

t

, t 0}. Dizemos que o processo tem chegadas n ao simult aneas

se os saltos em N

t

(w) forem de amplitude unit aria, para quase todo w.

Denic ao 7. Um processo de chegada N ={N

t

, t 0} e chamado um processo de

Poisson se:

i) tiver incrementos independentes. Ou seja, para qualquer s, t 0, N

t+s

N

t

e independente de {N

u

, u t};

ii) tiver incrementos estacion arios. Ou seja, para qualquer s, t 0, a distribuic ao

de N

s+t

N

t

e independente de t (estacionaridade);

iii) apresentar chegadas n ao simult aneas.

Observac ao 6. Note que a hip otese (i) da Denic ao 6 n ao parece (ao menos em

princpio) id entica ` a hip otese de incrementos independentes.

Contudo, elas s ao equivalentes. A seguir mostramos que a hip otese (i) da

denic ao leva ` a hip otese de independ encia incremental; a demonstrac ao reversa e

deixada ao leitor.

Note que o conhecimento de N

t

1

, N

t

2

, . . . , N

t

n

e equivalente ao conhecimento de

N

t

1

, N

t

2

N

t

1

, . . . , N

t

n

N

t

n1

, ou seja,

N

t

1

= N

t

1

N

t

2

= N

t

1

+(N

t

2

N

t

1

)

.

.

.

N

t

n

= N

t

n1

+(N

t

n

N

t

n1

)

portanto

P(N

s+t

N

t

|N

t

1

, N

t

2

, . . . , N

t

n

) = P(N

s+t

N

t

|N

t

1

, N

t

2

N

t

1

, . . . , N

t

n

N

t

n1

)

Da hip otese (i) da Denic ao 6, temos que N

s+t

N

t

e independente do hist orico

passado N

t

1

, N

t

2

, . . . , N

t

n

, quando t

1

< t

2

< . . . < t

n

t. Ent ao, podemos escrever

que

P(N

s+t

N

t

|N

t

1

, N

t

2

, . . . , N

t

n

) = P(N

s+t

N

t

)

e, substituindo na equac ao anterior, obtemos

P(N

s+t

N

t

|N

t

1

, N

t

2

N

t

1

, . . . , N

t

n

N

t

n1

) = P(N

s+t

N

t

).

Ou seja, N

t+s

N

t

e independente de N

t

1

, N

t

2

N

t

1

, . . . , N

t

n

N

t

n1

, e da obtemos

P(N

t

2

N

t

1

|N

t

1

) = P(N

t

2

N

t

1

) (N

t

2

N

t

1

) e N

t

1

s ao independentes;

P(N

t

3

N

t

2

|N

t

1

, N

t

2

N

t

1

) =P(N

t

3

N

t

2

) (N

t

3

N

t

2

) e independente de N

t

1

, N

t

2

N

t

1

.

Logo N

t

1

, N

t

2

N

t

1

e N

t

3

N

t

2

s ao independentes. O resultado segue por induc ao.

17

2.1.1 Distribuic ao de N

t

E possvel partir das hip oteses que denem o processo de Poisson e encontrar as

distribuic oes associadas de N. Contudo, e mais simples (e igualmente did atico)

partirmos propondo a distribuic ao de um incremento N

t+s

N

t

e em seguida veri-

car que de fato esta distribuic ao corresonde ` as hip oteses do processo, como segue.

Teorema 4. Se {N

t

, t 0} e um processo de Poisson, ent ao, para qualquer t, s 0

e k 0,

P(N

t+s

N

t

= k|N

u

, u t) = P(N

t+s

N

t

= k) =

e

t

(t)

k

k!

. (2.1)

Demonstrac ao. H a dois fatos a serem vericados. Primeiro, se (2.1) e, de fato,

uma distribuic ao. Deixamos isto ao encargo do leitor.

Segundo, devemos vericar se os tens (i) a (iii) da Denic ao 7 s ao satisfeitos,

assumindo que a distribuic ao e como em (2.1). Os tens (i) e (ii) s ao triviais, pois

de (2.1) vem que P(N

t+s

N

t

= k|N

u

, u t) e igual a

e

t

(t)

k

k!

, valor este que s o

depende do intervalos; n ao depende de t e nem dos valores passados do processo.

Com respeito ao item (iii), temos:

vide notas de aula

E interessante visualizar as curvas da distribuic ao do Teorema 4, tracadas na

Figura 2.2. Note que a distribuic ao e bastante assim etrica para P(N

s+t

N

s

= k)

quando k e pequeno, e que vai se tornando mais sim etrica na medida em que k

aumenta; para valores elevados de k, a distribuic ao aproxima-se da normal com

m edia t.

Exemplo 8. Seja N ={N

t

, t 0} um processo de Poisson com taxa = 8. Quere-

mos calcular

P(N

2.5

= 17, N

3.7

= 22, N

4.3

= 36)

O conhecimento de N

2.5

, N

3.7

e N

4.3

e equivalente a N

2.5

, N

3.7

N

2.5

,

N

4.3

N

3.7

, ent ao

P(N

2.5

= 17, N

3.7

= 22, N

4.3

= 36) =

P(N

2.5

= 17, N

3.7

N

2.5

= 5, N

4.3

N

3.7

= 14)

= P(N

2.5

= 17)P(N

3.7

N

2.5

= 5)P(N

4.3

N

3.7

= 14)

= P(N

2.5

= 17)P(N

1.2

= 5)P(N

0.6

= 14)

18

0 200 400 600 800 1000 1200 1400 1600 1800 2000

0

2

4

6

8

10

0

0.05

0.1

0.15

0.2

0.25

0.3

0.35

0.4

Poisson ~ e

(lt)

(lt)

k

/(k!)

tempo, t

unidades, k

Figura 2.2: Distribuic ao dos incrementos N

s+t

N

s

de um processo de Poisson com

taxa = 1/100

Assim

P(N

2.5

= 17, N

3.7

= 22, N

4.3

= 36) =

e

82.5

(82.5)

17

17!

e

81.2

(81.2)

5

5!

e

80.6

(80.6)

14

14!

=

e

20

(20)

17

17!

e

9.6

(9.6)

5

5!

e

4.8

(4.8)

14

14!

2.1.2 Valor Esperado de N

t

e o Signicado de

Seja N

t

, t 0 um processo de Poisson

P(N

t

= n) =

e

t

(t)

n

n!

, n = 0, 1, 2, . . .

Vamos calcular E(N

t

)

E(N

t

) =

n=0

nP(N

t

= n)

=

n=0

n

e

t

(t)

n

n!

19

=

n=1

n

e

t

(t)

n1

(n1)!

(t)

=te

t

n=1

(t)

n1

(n1)!

Fazendo a mudanca de vari avel j = n1, onde n = 1 j = 0 e n j

.

E(N

t

) = (t)e

t

j=0

(t)

j

j!

. .

=t

e

t

Note que o resultado acima sugere que o signicado de e o do valor esperado

de chegadas em um certo intervalo de durac ao t, dividido por t,

=

E(N

t

)

t

.

Ou seja, e a taxa m edia de chegadas. Esta id eia e reforcada pelo resultado que

segue, que estabelece que tem o signicado da raz ao entre a probabilidade de

uma chegada em um pequeno intervalo. A prova vem de imediato da distribuic ao

dos incrementos e e omitida.

Lema 3.

lim

t0

P(N

t

= 1)

t

=

Exemplo 9. Suponha que em um terminal telef onico chegam 20 chamadas por dia.

Qaul a probabilidade de 10 ou mais chamadas ocorrerem entre 10h e 18h de um

dia? Qual a probabilidade de mais de uma chamada nas primeira 8 horas do dia?

Soluc ao:

= 20 chamadas por dia = 20/24 chamadas por hora .

P(N

t

= n) =

e

t

(t)

n

n!

, n = 0, 1, 2, . . .

(i)Sabemos que P(N

t+s

N

t

= n) = P(N

s

) =

e

s

(s)

n

n!

. Assim, fazendo t = 10,

s = 8 e n = 10 temos

P(N

8

10) =

n=10

P(N

8

= n) =

n=10

e

20

24

8

(

20

24

8)

n

n!

=

n=10

e

20

3

(

20

3

)

n

n!

20

Devemos usar que

P(N

8

10) = 1P(N

8

10) = 1

9

n=0

e

20

3

(

20

3

)

n

n!

(ii)P(N

t

2), t = 8h

P(N

8

2) = 1P(N

8

1) = 1P(N

8

= 0) P(N

8

= 1)

= 1

e

20

24

8

(

20

24

8)

0

0!

e

20

24

8

(

20

24

8)

1

1!

= 1e

20

3

20

3

e

20

3

= 1e

20

3

_

1+

20

3

_

Exemplo 10. Qual o valor esperado do n umero de chamadas do Exemplo 9? Con-

sidere os dois intervalos 0 t 8h e 10 t 18h?

Soluc ao:

(i) E(N

t

) =t, 0 t 8

E(N

8

) =

20

24

8 =

20

3

chamadas .

(ii) E(N

t+s

N

t

) para 10 t 18

P(N

t+s

N

t

) = P(N

s

)

E(N

t+s

N

t

) = E(N

t+s

) E(N

t

) =(t +s) t =s

Assim

E(N

18

N

10

) =

20

24

8 =

20

3

chamadas .

Teorema 5. N ={N

t

, t 0} e um processo de Poisson se, e somente se,

(a) Para quase todo w, cada salto N

t

(w) e de magnitude unit aria;

(b) E{N

t+s

N

t

|N

u

, u t} =s

A prova deste teorema ser a omitida.

Observac ao 7. A denic ao do processo de Poisson e puramnete qualitativa, o sur-

preendente e que estes axiomas qualitativos especicamcompletamente a distribuic ao

de N

t

e as leis probabilsticas do processo como um todo.

O teorema anterior d a uma caracterizac ao qualitativa mais simples do pro-

cesso de Poisson. Este teorema e de f acil uso quando existe uma forte evid encia

para sugerir a independ encia de N

t+s

N

t

do hist orico passado N

u

, u t.

21

O pr oximo teorema e de f acil uso onde os axiomas de independ encia n ao s ao

evidentes, mas existem dados para se obter a distribuic ao do n umero de chegada

em v arios intervalos de tempo.

Teorema 6. N = {N

t

, t 0} e um processo de Poisson com taxa se, e somente

se,

P(N

B

= k) =

e

b

(b)

k

k!

para qualquer intervalo B [0, ) que e a uni ao de um n umero nito de intervalos

disjuntos tal que a soma dos comprimentos e b.

Demonstrac ao. (i) Provaremos o teorema s o em um sentido. Considere o n umero

de chegadas em dois intervalos de tempo disjuntos

X

1

= N

t

1

+s

N

t

1

; X

2

= N

t

2

+s

2

N

t

2

em um processo de Poisson com taxa . Ent ao

P(X

1

+X

2

= n) =

j=0

P(X

1

= j)P(X

1

+X

2

= n|X

1

= j)

=

j=0

P(X

1

= j)P(X

2

= n j)

usamos na ultima passagem o fato de X

2

ser independente de X

1

. Logo

P(X

1

+X

2

= n) =

j=0

e

s

1

(s

1

)

j

j!

e

s

2

(s

2

)

nj

(n j)!

= e

(s

1

+s

2

)

j=0

(s

1

)

j

(s

2

)

nj

j!(n j)!

=

e

(s

1

+s

2

)

n!

j=0

n!

j!(n j)!

(s

1

)

j

(s

2

)

nj

Mas

j=0

n!

j!(n j)!

(s

1

)

j

(s

2

)

nj

= (s

1

+s

2

)

n

portanto

P(X

1

+X

2

= n) =

e

(s

1

+s

2

)

(s

1

+s

2

)

n

n!

(ii) A recproca n ao ser a provada.

22

Proposic ao 1. SejamA

1

, A

2

, . . . , A

n

intervalos disjuntos comuni ao B, sejama

1

, a

2

, . . . , a

n

os respectivos comprimentos de A

1

, A

2

, . . . , A

n

e b = a

1

+a

2

+ +. . . +a

n

. Ent ao,

para k

1

+k

2

+. . . +k

n

= k N, temos

P(N

A

1

= k

1

, N

A

2

= k

2

, . . . , N

A

n

= k

n

|N

B

= k)

=

k!

k

1

!k

2

! . . . k

n

!

_

a

1

b

_

k

1

. . .

_

a

n

b

_

k

n

.

(2.2)

Demonstrac ao. Se N

A

1

= k

1

, N

A

2

= k

2

, . . . , N

A

n

= k

n

e N

B

= k temos

P(N

A

1

= k

1

, . . . , N

A

n

= k

n

|N

B

= k) =

P(N

A

1

= k

1

, . . . , N

A

n

= k

n

)

P(N

B

= k)

Se A

1

, A

2

, . . . , A

n

s ao disjuntos, ent ao N

A

1

, . . . N

A

n

s ao independentes, logo

P(N

A

1

= k

1

, . . . , N

A

n

= k

n

) = P(N

A

1

= k

1

). . . P(N

A

n

= k

n

)

Sendo P(N

A

i

= k

i

) =

e

a

i

(a

i

)

k

i

k

i

!

, P(N

B

= k) =

e

b

(b)

k

k

temos

P(N

A

1

= k

1

, . . . , N

A

n

= k

n

|N

B

= k) =

k!

k

1

!k

2

! . . . k

n

!

_

a

1

b

_

k

1

. . .

_

a

n

b

_

k

n

2.1.3 Tempo de Chegada

Seja N = {N

t

, t 0} um processo de Poisson com taxa , para quase todo w. A

func ao t N

t

(w) e n ao decrescente, contnua ` a direita e aumenta somente por

saltos unit arios. Esta func ao e completamente determinada pelos instantes de salto

T

1

(w), T

2

(w), . . . , T

n

(w), . . .. Denotamos T

1

, T

2

, . . . , T

n

os sucessivos instantes (ou

tempo) de chegada.

Seja X

n

=T

n

T

n1

, (T

0

=0, por conveni encia), X

n

e o intervalo de tempo entre

as chegadas n 1 e n. Para determinar a distribuic ao de X

n

, vamos usar o fato de

que {X

n

> t} signica o mesmo que ter ocorrido zero chegadas no intervalo [0, t],

ou seja

P(X

n

>t) = P(zero chegadas entre [0, t]) = e

t

Devemos observar ainda algumas propriedades da vari avel aleat oria X

n

:

P(X

n

>t|X

n1

= s) = P(zero chegadas entre (s, t +s] | X

n1

= s)

= P(zero chegadas entre (s, t +s])

23

P(X

n

>t|X

n1

= s) = P(X

n

>t) = independ encia.

Por outro lado P(X

n

>t) = e

t

, logo

P(X

n

>t|X

n1

= s) = e

t

= estacionariedade.

Conclus ao:

Os tempos entre chegadas X

n

s ao vari aveis aleat orias independentes e identica-

mente distribudas com distribuic ao exponencial e

t

.

Lembrando que se uma vari avel aleat oria tem distribuic ao exponencial, ent ao

P(X >t +s|X >t) = P(X > s)

para quaisquer t, s 0.

Alternativamente se X tem essa propriedade, ent ao X tem distribuic ao expo-

nencial, pois

P(X >t +s|X >t) =

P(X >t +s)

P(X >t)

= P(X > s)

e da

P(X >t +s) = P(X >t)P(X > s),

o que implica que X tem distribuic ao exponencial.

Teorema 7. Sejam T

1

, T

2

, . . . tempos sucessivos de chegadas de um processo de

chegada N = {N

t

, t 0}. Ent ao N e um processo de Poisson com taxa se, e so-

mente se, os tempos de chegadas T

1

, T

2

T

1

, T

3

T

1

, . . . s ao i.i.d, com distribuic ao

exponencial de par ametro .

Demonstrac ao. Notemos que uma parte do teorema j a foi provada, e deixamos a

recproca como exerccio.

Valor esperado e vari ancia de T

n

T

n1

Sendo T

n

T

n1

uma vari avel aleat oria com distribuic ao exponencial de par ametro

, temos

E(T

n

T

n1

) =

1

e Var(T

n

T

n1

) =

1

2

sendo T

n

= T

1

+(T

2

T

1

) +(T

3

T

2

) +. . . +(T

n

T

n1

) temos

E(T

n

) =

n

e Var(T

n

) =

n

2

24

Exemplo 11. Um item tem um tempo de vida aleat orio cuja distribuic ao e expo-

nencial com par ametro . Quando este falha, e imediatamente substitudo por

um item id entico e assim sucessivamente. Isto signica que os tempos de vidas

X

1

, X

2

, . . . dos sucessivos itens em uso sao i.i.d. com distribuc ao exponencial dada

por

P(X

n

t) = 1e

t

; t 0.

Se T

1

, T

2

, . . . s ao os tempos das falhas sucessivas, temos que T

1

= X

1

, T

2

=

X

1

+X

2

, . . .. Ent ao as condic oes do teorema 44 est ao satisfeitas pela seq u encia

T

1

, T

2

, . . . Assim se N

t

e o n umero de falhas em [0, t], conclumos que o processo de

falhas N ={N

t

, t 0} e um processo de Poisson com taxa .

Exemplo 12. Supondo que no exemplo ?? = 2.10

4

temos que o tempo de vida

esperado de um item e

E(X

n

) =

1

= 5000(horas)

A vari ancia e

Var(X

n

) =

1

2

= 25.10

6

(horas)

2

Supondo que numa m aquina funcionem tr es desses itens, onde o segundo entra

em funcionamento imediatamente ap os o primeiro falhar e o terceiro logo ap os o

segundo falhar, ent ao o tempo de vida esperado da m aquina e

E(T

3

) = E(X

1

+X

2

+X

3

) =

3

= 15000(horas)

Var(T

3

) =Var(X

1

+X

2

+X

3

) =

3

2

= 75 10

6

(horas)

2

.

Exemplo 13. Supondo que os itens do exemplo anterior s ao recolocados por outro

id entico t ao logo eles falhem, e supondo que o custo de reposic ao e $ e que a

taxa de desconto e > 0, ent ao $1 gasto no instante t tem um valor presente de

e

t

( e a taxa de juros). Logo, para uma realizac ao w , o tempo da n- esima

falha e T

n

(w), e o valor presente do custo de reposic ao e e

(T

n

(w))

. Assumindo

esse custo para todo n, temos que o valor presente do custo de todas reposic oes

futuras e

C(w) =

n=1

e

(T

n

(w))

, w

Estamos interessados no valor espreado do custo C(w), ou seja

E(C(w)) =

n=1

E(e

(T

n

(w))

)

25

Para n xo, podemos escrever T

n

= T

1

+ (T

2

T

1

) +. . . + (T

n

T

n1

), onde

T

1

, T

2

T

1

, . . . , T

n

T

n1

s ao vari aveis aleat orias i.i.d., logo

E(e

T

n

) = E(e

T

1

e

(T

2

T

1

)

. . . e

(T

n

T

n1

)

)

= E(e

T

1

)E(e

(T

2

T

1

)

). . . E(e

(T

n

T

n1

)

)

= [E(e

T

1

)]

n

Desde que a distribuic ao de T

1

e exponencial com par ametro , temos

E(e

T

1

) =

0

e

t

e

t

dt =

+

temos

E(C) =

n=1

_

+

_

n

=

+

_

1

+

_

1

=

2.2 Tempo de Recorr encia (Forward)

Observa-se uma loja no instante t e suponha que o ultimo cliente tenha chegado no

instante t h. Vamos mostrar que a fuc ao distrituic ao do intervalo de tempo que

devemos esperar para a chegada do pr oximo cliente n ao depende de h e coincide

com a distribuic ao de X

n

=T

n

T

n1

. O processo n ao se lembra de que se passaram

h unidades de tempo entre as chegadas do ultimo cliente e o instante presente.

Teorema 8. Se se observa um processo de Poisson no instante de tempo t onde a

ultima chegada N

t

ocorreu no instante T

N

T

= t h e a pr oxima chegada N

T

+1

ocorrer a em T

N

T

+1

. Denotando o tempo de espera at e a chegada N

T

+1 por

W

t

= T

N

t

+1

t,

tem-se que

P(W

t

z|N

s

, s t) = 1e

z

para qualquer z 0, independentemente de t e de h.

Demonstrac ao.

[W

t

z] = [T

N

T

+1

t z] = [T

N

T

+1

t z]

c

= [N

t+z

N

t

= 0]

c

Portanto

P(W

t

z|N

s

, s t) = P([N

t+z

N

t

= 0]

c

|N

s

, s t)

= 1P(N

t+z

N

t

= 0|N

s

, s t)

= 1P(N

t+z

N

t

= 0)

= 1e

z

26

2.3 Superposic ao de Processos de Poisson

Seja L = {L

t

, t 0} e M = {M

t

, t 0} dois processos de Poisson independentes

com taxas e , respectivamente. Para cada w e t 0, seja N

t

(w) dado por

N

t

(w) = L

t

(w) +M

t

(w)

O processo N ={N

t

, t 0} e chamado de superposic ao dos processos L e M.

Teorema 9. N ={N

t

, t 0} e um processo de Poisson com taxa =+.

Demonstrac ao. Pelo Teorema 6, basta mostrar que para qualquer intervalo de

tempo B, que e a uni ao de um n umero nito de intervalos disjuntos de compri-

mento total b, o n umero de chegadas durante B tem distribuic ao de Poisson com

par ametro b.

P(N

B

= n) =

n

k=0

P(L

B

= k, M

B

= nk)

=

n

k=0

e

b

(b)

k

k!

e

b

(b)

nk

(nk)!

=

e

(+)b

(+)

n

n!

b

n

n

k=0

n!

k!(nk)!

nk

(+)

n

=

e

(+)b

(+)

n

n!

b

n

n

k=0

n!

k!(nk)!

_

+

_

k

_

+

_

nk

logo

P(N

B

= n) =

e

(+)b

[(+)b]

n

n!

n

k=0

n!

k!(nk)!

p

k

q

nk

onde p =

+

e q =

+

, ou seja p+q = 1. Sendo

n

k=0

n!

k!(nk)!

p

k

q

nk

= (p+q)

n

= 1

temos

P(N

B

= n) =

e

(+)b

[(+)b]

n

n!

Chamando + = temos

P(N

B

= n) =

e

b

(b)

n

n!

27

2.4 Decomposic ao de um Processo de Poisson

Sejam N ={N

t

, t 0} um processo de Poisson com taxa e {K

n

, n = 1, 2, . . .} um

processo de Bernoulli independente de N com probabilidade p de sucesso. Seja S

n

o n umero de sucessos nas primeiras n-tentativas. Suponha que a n- esima tentativa

e realizada no instante da n- esima chegada T

n

.

Para uma realizac ao w, o n umero de tentativas realizadas em [0, t] e N

t

(w),

e o n umero de sucessos obtidos em [0, t] e denotado por

M

t

(w) = S

N

t

(w)

e o n umero de falhas e

L

t

(w) = N

t

(w) M

t

(w).

Teorema 10. Os processos M = {M

t

, t 0} s ao processos de Poisson com taxas

p e q (q = 1p), respectivamete. Al em disso, L e M s ao independentes.

Demonstrac ao. Mostraremos que

P(M

t+s

M

t

= m, L

t+s

L

t

= k|M

u

, L

u

, u t) =

e

ps

(ps)

m

m!

e

qs

(qs)

k

k!

com k, m = 0, 1, 2, . . . e qualquer s, t 0. Notando a igualdade entre os eventos

seguintes

A ={M

t+s

M

t

= m, L

t+s

L

t

= k} ={N

t+s

N

t

= m+k, M

t+s

M

t

= m},

escrevemos

A ={N

t+s

N

t

= m+k, S

N

t+s

S

N

t

= m}

Al em disso o conhecimento do hist orico {M

u

, L

u

, u t} e equivalente ao con-

hecimento de

K

={N

u

, u t, X

1

, X

2

, . . . , X

N

t

}

Como N e um processo de Poisson, e como os processos N e S s ao indepen-

dentes, a vari avel aleat oria N

t+s

N

t

e independente de K

. Al em disso o n umero

de sucessos nas tentativas N

t+1

, N

t+2

, . . . , N

t+s

e independente da hist oria passada

X

1

, X

2

, . . . , X

N

t

, e como S e N s ao independentes, S

N

t+1

S

N

t

e independente de K

.

Ent ao temos

P(A) =

n=0

P(N

t

= n, N

t+s

N

t

= m+k, S

N

t+s

S

N

t

= m)

=

n=0

P(N

t

= n, N

t+s

= m+k +n, S

m+k+n

S

n

= m)

28

=

n=0

P(N

t

= n, N

t+s

= m+k +n)P(S

m+k+n

S

n

= m)

=

n=0

P(N

t

= n, N

t+s

N

t

= m+k)P(S

m+k+n

S

n

= m)

= P(N

t+s

N

t

= m+k)P(S

m+k

= m)

=

e

s

(s)

m+k

(m+k)!

(m+k)!

m!k!

p

m

q

k

=

e

(p+q)s

(sp)

m

(sq)

k

m!k!

=

e

ps

(ps)

m

m!

e

qs

(qs)

k

k!

2.5 Exerccios

Exerccio 18. Seja N um processo de Poisson com taxa = 2, calcule

a) E(N

t

) e Var(N

t

)

b)E(N

t+s

|N

t

)

Exerccio 19. Uma loja promete dar um pr emio a todo 13

o

cliente que chegar. Se

a chegada do cliente e um processo de Poisson com taxa

a) calcule a func ao densidade de probabilidade do tempo entre clientes premi-

ados;

b) ache P(M

t

= k) para o n umero de pr emios dados no intervalo [o, t].

Exerccio 20. Usu arios chegam a uma loja segundo um processo de Poisson com

taxa = 20/hora. Ache o n umero esperado de vendas durante as 8 horas de

espedimente do dia se a probabilidade do cliente comprar e 0,30.

Exerccio 21. Uma loja tem 3 portas. A chegada em cada porta forma um pro-

cesso de Poisson com taxas

1

=110,

2

=90,

3

=160 usu arios/hora. 30% dos

usu arios s ao masculino. A probabilidade de que um masculino compre alguma

coisa e 0,80, e a probabilidade de que um feminino compre alguma coisa e 0,10.

Uma compra m edia e avaliada em $4,50.

a)Qual o valor esperado do total de vendas feito ` as 10 horas do dia.

b)Qual e a probabilidade de que o terceiro usu ario feminino para comprar

qualquer coisa chegue durante os primeiros 15 minutos? Qual e o tempo espe-

rado de sua chegada?

29

Exerccio 22. Seja N ={N

t

, t 0} um processo de Poisson com taxa e suponha

que em um dado t N

t

= 1. Qual a distribuic ao do tempo T

1

em que a chegada

ocorreu?

30

Você também pode gostar

- 3 O Erro de MediçãoDocumento69 páginas3 O Erro de MediçãoRosineia BergamaschiAinda não há avaliações

- Capitulo 9Documento36 páginasCapitulo 9Rosana LiliamAinda não há avaliações

- Época de Recurso - SoluçãoDocumento8 páginasÉpoca de Recurso - Soluçãodwadadw dawdadawAinda não há avaliações

- Aula Variaveis Aleatorias Versao 2022Documento57 páginasAula Variaveis Aleatorias Versao 2022Guilherme Avelar AntunesAinda não há avaliações

- Variancia e Desvio PadraoDocumento7 páginasVariancia e Desvio PadraoJoão de MouraAinda não há avaliações

- Lista Variaveis Aleatórias Continuas e DiscretasDocumento4 páginasLista Variaveis Aleatórias Continuas e DiscretasLuiz Otavio Daros NunesAinda não há avaliações

- 03 Gamma JeffreyDocumento7 páginas03 Gamma JeffreyPatrícia VianaAinda não há avaliações

- UD4 DistribuicoesDocumento261 páginasUD4 DistribuicoesKorea NewbaAinda não há avaliações

- Quiz - 2.1Documento5 páginasQuiz - 2.1Raíssa SerpaAinda não há avaliações

- Rolla, L.-Introdução À Probabilidade (Apostila)Documento177 páginasRolla, L.-Introdução À Probabilidade (Apostila)Denny Andrew100% (1)

- ClariceDocumento255 páginasClariceThalis ReboucasAinda não há avaliações

- Exercícios - Esperança e VariânciaDocumento24 páginasExercícios - Esperança e VariânciaYuri FagundesAinda não há avaliações

- Tabela T 3 PDFDocumento1 páginaTabela T 3 PDFThalita BorgesAinda não há avaliações

- Aula 8 - Probabilidade Condicional PDFDocumento21 páginasAula 8 - Probabilidade Condicional PDFClécioChrisAinda não há avaliações

- Slides1 Aula1 TPDocumento7 páginasSlides1 Aula1 TPGonçalo PereiraAinda não há avaliações

- Distrib. Discr. de Probab.Documento8 páginasDistrib. Discr. de Probab.SpillerAinda não há avaliações

- Tipos de Convergência, LGN e TCLDocumento9 páginasTipos de Convergência, LGN e TCLRodrigo FerreiraAinda não há avaliações

- Estatística - Medidas de AssociaçãoDocumento5 páginasEstatística - Medidas de Associaçãocjjgoes100% (1)

- Lista1 Prob CCOMPDocumento3 páginasLista1 Prob CCOMPbakedcookedAinda não há avaliações

- Plano de Aula EST0232Documento2 páginasPlano de Aula EST0232Jamykson FreitasAinda não há avaliações

- Teste 3 Probabilidade Estatistica JunhoDocumento7 páginasTeste 3 Probabilidade Estatistica JunhoRita TavaresAinda não há avaliações

- Variaveis Aleatorias Discretas ADMDocumento21 páginasVariaveis Aleatorias Discretas ADMDaniel BezerraAinda não há avaliações

- Integral GaussianoDocumento2 páginasIntegral GaussianoPaulo FreitasAinda não há avaliações

- Distribuiçoes de Variaveis Aleatorias PDFDocumento13 páginasDistribuiçoes de Variaveis Aleatorias PDFAudemiro AntónioAinda não há avaliações

- Avaliação II - Probabilidade e Estatistica - Passei DiretoDocumento9 páginasAvaliação II - Probabilidade e Estatistica - Passei DiretoEduardo PedrosaAinda não há avaliações

- 2017-18 - 1sem - Teste - EN - Sol - EstatísticaDocumento4 páginas2017-18 - 1sem - Teste - EN - Sol - EstatísticaMartha MarthaAinda não há avaliações

- 3 Lista de Exercícios V.A. Discretas e ContínuasDocumento3 páginas3 Lista de Exercícios V.A. Discretas e ContínuasEliomar Resplandis100% (1)

- Capítulo 4 - V ADocumento22 páginasCapítulo 4 - V AGeorge BarrozoAinda não há avaliações

- Artigo - Avaliação de Testes de NormalidadeDocumento8 páginasArtigo - Avaliação de Testes de NormalidadecaiopetroniosAinda não há avaliações

- Tab EstatisticaDocumento10 páginasTab EstatisticaBaddyoSantanaAinda não há avaliações