Escolar Documentos

Profissional Documentos

Cultura Documentos

Aula 4 - Inteligência Artificial (Educa)

Enviado por

Carlos Adriano De AnchietaDescrição original:

Direitos autorais

Formatos disponíveis

Compartilhar este documento

Compartilhar ou incorporar documento

Você considera este documento útil?

Este conteúdo é inapropriado?

Denunciar este documentoDireitos autorais:

Formatos disponíveis

Aula 4 - Inteligência Artificial (Educa)

Enviado por

Carlos Adriano De AnchietaDireitos autorais:

Formatos disponíveis

AULA 4 – DESAFIOS CONEXOS

APLICAÇÃO DA

INTELIGÊNCIA

ARTIFICIAL AO DIREITO

AULA 4 – DESAFIOS CONEXOS

GUSTAVO MASCARENHAS LACERDA PEDRINA

APLICAÇÃO DA INTELIGÊNCIA ARTIFICIAL AO DIREITO 1

AULA 4 – DESAFIOS CONEXOS

INTRODUÇÃO ....................................................................... 3

1. CRIPTOGRAFIA, PROTEÇÃO DE DADOS PESSOAIS

E BLOQUEIO DE CONTEÚDOS E APLICAÇÕES......... 4

2. BLOCKCHAIN................................................................... 10

3. FAKE NEWS...................................................................... 13

REFERÊNCIAS .................................................................... 21

APLICAÇÃO DA INTELIGÊNCIA ARTIFICIAL AO DIREITO 2

AULA 4 – DESAFIOS CONEXOS

INTRODUÇÃO

Como vai? Tudo bem?

Bom, agora que você já está craque em IA, entende suas origens, conhece

a evolução das máquinas, aprendeu os conceitos que envolvem o termo, sabe

diferenciar os tipos de IA, viu exemplos de como as máquinas funcionam no atual

estágio de desenvolvimento – inclusive em aplicações diretamente relacionadas

aos operadores do direito – e alcança quais são as possíveis aplicações no futuro,

é hora de complementarmos a sua formação, de modo que você seja capaz de

discutir assuntos correlatos que, de uma forma ou de outra, envolvem o aprendizado

da máquina e as questões diretamente ligadas ao seu funcionamento ou à sua

aplicação.

Nesse cenário, diversas aplicações recolhem dados por emissão de

cookies (pequenos arquivos que traçam quem esteve em um site) e controle de

permanência, formando uma nova cadeia de informações, provavelmente a mais

importante desde a criação da web (a blockchain, que estudaremos mais adiante).

Assim, a inteligência artificial e as neurociências aliadas à computação preditiva

avançam; em meio a tudo isso, plataformas distribuem notícias falsas, o que impõe

novas e importantes questões sociais que afetam a própria democracia.

Se você assistiu a alguns noticiários, ouviu jornais no rádio, leu periódicos ou,

de maneira mais ligada aos temas que tratamos, consultou a internet nos últimos

tempos, certamente ouviu falar de temas como criptografia, blockchain, fake news

e bloqueio de conteúdo de aplicações.

Essas são questões que mostram como a internet e as máquinas potencializam

debates que acompanham a evolução da sociedade da informação há algum

tempo. Não é de agora que nos preocupamos com a privacidade de nossas

comunicações, embora, recentemente, grandes empresas desafiem governos

poderosos em nome da privacidade dos dados...

Há séculos a humanidade discute como construir cadeias confiáveis de tutela

de dados, mas note como grandes conglomerados têm utilizado a blockchain

como solução... Não é de hoje que os boatos e as notícias falsas existem, mas

veja como ganharam importância no debate sobre a saúde das democracias nos

últimos momentos... Tem bastante tempo que discutimos a censura, mas perceba

como o bloqueio de alguns aplicativos (ainda que temporário) levantou vozes...

APLICAÇÃO DA INTELIGÊNCIA ARTIFICIAL AO DIREITO 3

AULA 4 – DESAFIOS CONEXOS

Todos esses assuntos são de alguma forma ligados ao que tratamos nesse

curso. Por isso, vamos explorá-los nessa quarta e última aula. Você sairá desse curso

com conhecimentos bastante sólidos!

Bom, diante dessas percepções, vamos ver como esses temas têm se

desenvolvido?

Pronto para a nossa última aula? Então vamos lá!

1. CRIPTOGRAFIA, PROTEÇÃO DE DADOS PESSOAIS

E BLOQUEIO DE CONTEÚDOS E APLICAÇÕES

Em 1890, Warren e Brandeis publicaram nos EUA seu artigo com a teoria do

direito à privacidade (the right to privacy), popularizada quando Brandeis, então

Justice (ou Ministro) na Suprema Corte norte-americana, aplicou-a no julgamento

de Olmstead v. Estados Unidos. Segundo ele, o direito de privacidade (the right of

privacy) é o direito de ser deixado em paz (the right to be let alone), sendo esse “o

direito que deve ser o mais valorizado pelos homens civilizados”.

A privacidade se expandiu, tornando-se uma nova expressão da liberdade,

abarcando novos ramos do direito. Uma dessas evoluções está associada

diretamente à tecnologia: a proteção dos dados pessoais.

O mais notável esforço nesse campo vem da União Europeia (UE), que se

dedica a estabelecer princípios para a coleta, armazenamento e uso de dados

pessoais por indivíduos, organizações e pessoas desde o início da década de

80, com a instituição da Convenção n. 108 do Conselho da Europa. Ali já se

estabelecia que os dados deveriam ser “obtidos e processados de maneira justa e

legal”, devendo ser arquivados “para fins específicos e legítimos e nunca usados

de maneira incompatível com estes fins”.

Em 1995, com a Diretiva n. 95/46/EC – complementada em 2002 pela

Diretiva n. 2002/58/EC –, a UE passou a regular o uso deste tipo de informação

de seus residentes. Com o advento do novo Regulamento Geral de Proteção de

Dados, que entrou em vigor em 25 de maio de 2018, o bloco deu um importante

passo na proteção de dados diante do oceano de novas aplicações para as

coleções de big data atuais.

APLICAÇÃO DA INTELIGÊNCIA ARTIFICIAL AO DIREITO 4

AULA 4 – DESAFIOS CONEXOS

E no Brasil? A discussão chegou na última década por aqui, e, como vivemos

na sociedade da informação e o tema é urgente, rapidamente aprovamos a Lei

Geral de Proteção de Dados Pessoais (LGPDP), a Lei nº 13.709/2018, que, inspirada

na regulação europeia, estabelece um conjunto de regras de proteção aos dados

dos cidadãos brasileiros.

SAIBA MAIS

Veja aqui um programa bastante

interessante sobre a nova Lei de Proteção

de Dados brasileira. São 30 minutos que

valem a pena!

De Hert e Gutwirth (2014) postulam que a privacidade e a proteção de

dados são “direitos diferentes, complementares e fundamentais”. A distinção seria

necessária, conforme descrevem mais recentemente, porque as leis de proteção à

privacidade destinam-se à proteção da não interferência nos atos privados da vida,

criando um campo de autonomia e liberdade para os indivíduos, enquanto que

as leis de proteção aos dados devem destinar-se à transparência no tratamento

dos dados de indivíduos e organizações por parte de outros atores privados e

governos, possibilitando a cada um o controle de seus dados e a consciência de

como serão utilizados por terceiros.

Ou seja, precisamos tanto da proteção constitucional da privacidade quanto

da tutela específica dos nossos dados pessoais – ainda mais numa sociedade na

qual, como vimos ao longo desse curso, os dados implicam no desenvolvimento

da inteligência da máquina e, consequentemente, no dia a dia da maior parte da

humanidade.

A privacidade, afirmam Poullet e Rouvroy (2014, p. 61), “não é uma

liberdade com o mesmo status de outras”. Segundo os autores, “é essencial para

a formação da dignidade humana e para a autonomia individual e traduz esses

princípios morais para a esfera legal”, sendo, deste modo, “precondição necessária

para o usufruto de muitas outras liberdades e direitos fundamentais”. É só com

a garantia da intimidade que o indivíduo pode ser livre para tomar decisões e

formar sua opinião.

APLICAÇÃO DA INTELIGÊNCIA ARTIFICIAL AO DIREITO 5

AULA 4 – DESAFIOS CONEXOS

Diante dessas afirmações, você consegue perceber como é importante

ter certeza de que nossas comunicações não estão sendo monitoradas? Estar ou

não sendo monitorado é, sem dúvida, algo que influi na formação das nossas

vontades. A criptografia, uma técnica de codificação de dados, é hoje o caminho

mais seguro para garantirmos isso. Vamos ver juntos como?!

A criptografia atua por “chaves” (também chamadas de protocolos) privadas

e públicas. Uma forma bastante comum de aplicação da tecnologia é a criptografia

de ponta a ponta, na qual cada usuário tem uma chave privada. Quando dois

usuários trocam uma comunicação, as informações que estão contidas nesse

diálogo ficam protegidas pelo encontro das duas chaves privadas únicas. Quando

os dados são criptografados, é aplicado um algoritmo para codificá-los de modo

que eles não tenham mais o formato original e, portanto, não possam ser lidos. Os

dados só podem ser decodificados ao formato original com o uso de uma chave

específica, a do usuário de destino. Quando as chaves se cruzam, o texto passa a

fazer sentido.

Um exemplo muito antigo e rudimentar da prática era o Bastão Scytale,

inventado pelos espartanos, por volta do ano 500 a.C. Uma mensagem, escrita em

um pedaço de pergaminho, só fazia sentido quando enrolada em bastão feito

especificamente para decodificar aquele texto. Veja o exemplo na figura abaixo:

Modernamente, podemos exemplificar a tecnologia com o desenho abaixo.

Sem a chave correta (segunda figura) é praticamente impossível de se alcançar

o ponto C (o resultado decodificado da conversa) –, o trabalho para alcançá-lo

inviabiliza a tarefa. Enquanto isso, na primeira figura há um caminho criptografado

no qual A tem uma chave e B tem outra. Quando as duas se “encontram”,

o diálogo é “fechado”, sendo entregue o resultado legível, o ponto C. Note

que, apesar de complexo, o caminho é facilmente encontrado com as chaves

criptográficas adequadas:

APLICAÇÃO DA INTELIGÊNCIA ARTIFICIAL AO DIREITO 6

AULA 4 – DESAFIOS CONEXOS

A B A B

?

2+?

2+? ? 2+?

?

?

2+?

C C

Nota: A imagem é de autoria desconhecida e circula há vários anos como

exemplificação da criptografia como técnica de opacidade.

(Com adaptações.)

Na próxima figura, você pode perceber o quanto é difícil para um hacker

espião interceptar a mensagem. Veja que ele não será capaz de entender os dados.

Maria João

Texto Texto

Olá, João. Olá, João.

Assinado Assinado

Maria

Chave Simétrica Maria

Texto cifrado

Criptografar

kla5%&ili(’&T Descriptografar

UT%776yuff7-

C = E (M,K) S&ghjhdf M = D (C,K)

C = Texto criptografado, cifrado

M = Mensagem (texto)

K = Chave Secreta Espião

E = Função CRIPTOGRAFAR

D = Função DESCRIPTOGRAFAR

Disponível em: blog.certisign.com.br.

(com adaptações.)

Isso ocorre, por exemplo, nas comunicações de WhatsApp. A própria

empresa explica como aplica a criptografia de ponta a ponta nas conversas que

mantemos pelo aplicativo. Confira em: Sobre a criptografia de ponta a ponta.

APLICAÇÃO DA INTELIGÊNCIA ARTIFICIAL AO DIREITO 7

AULA 4 – DESAFIOS CONEXOS

É quase impossível para as autoridades em uma investigação, ainda que

autorizadas pelo judiciário, interceptar comunicações protegidas por criptografia.

Quando conseguem, as autoridades na verdade invadem os dispositivos ou as

nuvens de dados das aplicações, não os aplicativos em si, instalados nos aparelhos.

Fazem espelhamentos em tempo real das telas das máquinas ou pesquisam os

dados armazenados em nuvem. Isso nos leva ao terceiro ponto desse tópico: o

bloqueio de conteúdos e aplicativos.

Entre 2007 e 2018, assistimos a diversas ordens judiciais que bloquearam

aplicativos no Brasil. O YouTube sofreu, ainda em 2007, um bloqueio parcial por se

negar a retirar do ar um vídeo íntimo de uma modelo. O Facebook recebeu, entre

2012 e 2018, ao menos três casos de repercussão sobre o bloqueio de conteúdo

em sua rede. O WhatsApp mesmo foi bloqueado ao menos quatro vezes entre

2015 e 2016 por se negar a oferecer os conteúdos de conversas de seus usuários.

A questão chegou inclusive no STF. Nos dias 2 e 5 de junho de 2017, aconteceu

no Tribunal uma audiência pública para discutir os objetos da ADPF 403 e da ADI

5.527. A primeira, de relatoria do ministro Edson Fachin, discute a compatibilidade

de ordens judiciais de bloqueio do WhatsApp com a liberdade de comunicação.

A segunda, de relatoria da ministra Rosa Weber, discute a constitucionalidade

dos incisos III e IV do art. 12 do Marco Civil da Internet (MCI), que autorizam a

imposição das sanções de “suspensão temporária” e de “proibição do exercício

das atividades” de provedores de conexão e aplicações de internet.

SAIBA MAIS

Quanto tempo demoraria para quebrarmos uma chave criptográfica de 256 bits

(uma das mais comuns hoje em dia)?

220000000000

Você não vai acreditar, mas eis a resposta:

“Imaginemos que o computador mais rápido do planeta – Sunway TaihuLight, capaz

de processar 93 quatrilhões de instruções por segundo – em breve esteja no bolso dos

7,5 bilhões de habitantes do planeta. Imaginemos também que todos esses habitantes

se unam na tarefa de varrer todas as possibilidades de uma chave criptográfica

000000000000

simétrica com comprimento de 256 bits, já comum hoje em dia. Em quanto tempo

varreremos todas as possibilidades de combinação de bits dessa chave? Fazendo as

contas: 7 bilhões e 500 milhões de habitantes no planeta com poder computacional

individual de calcular 93 quatrilhões de instruções por segundo. Isso resulta numa

capacidade combinada de testar aproximadamente 22 milhões de bilhões de bilhões

de bilhões de possibilidades por ano. Você não leu errado, não existem palavras

000000000000

duplicadas, se trata do numeral 22 seguido de 33 zeros. Assim sendo, demoraríamos

aproximadamente 5,2 milhões de bilhões de bilhões de bilhões de bilhões de anos

para varrer todas as possibilidades de combinação dos 256 bits 0s e 1s. Considerando

que o universo tem idade estimada em 13,3 bilhões de anos, demoraríamos muito

mais tempo do que gostaríamos para conseguir tal façanha.”

Disponível em: blog.ipog.edu.br. Acesso em: 5 dez. 2019.

APLICAÇÃO DA INTELIGÊNCIA ARTIFICIAL AO DIREITO 8

AULA 4 – DESAFIOS CONEXOS

SAIBA MAIS

Na plataforma Bloqueios.info, você pode ver todos os casos rumorosos

de bloqueios de conteúdo ou de aplicativos no Brasil.

Nos EUA, há grande desconfiança por parte dos usuários sobre o

fornecimento de backdoors (portas traseiras) pelas principais empresas de

tecnologia para que as autoridades monitorem seus usuários, mas não há

comprovação da prática.

Você pode ter pensado: e a inteligência artificial nisso tudo?

Bem, já imaginou se todas as comunicações que são protegidas pela

criptografia deixassem de ser? Robôs algorítmicos, que funcionam essencialmente

a partir de grandes volumes de dados, poderiam facilmente rastrear tudo o que

você pensa e diz, impactando de maneira decisiva na sua privacidade e, como

vimos acima, em última análise, até na formação da sua vontade. Percebeu como

o tema é importante? Os dados são a principal matéria-prima para a aplicação de

inteligência artificial, por isso a gestão das grandes coleções de big data (que,

aliás, todos nós produzimos e incrementamos diariamente) é tão importante para

o debate acerca dos usos e aplicações de inteligência artificial.

Para fecharmos esse assunto tão intrigante, veja aqui uma palestra sobre os

porquês de a proteção de dados pessoais ser essencial atualmente (são só 12

minutinhos):

APLICAÇÃO DA INTELIGÊNCIA ARTIFICIAL AO DIREITO 9

AULA 4 – DESAFIOS CONEXOS

SAIBA MAIS

Quer se aprofundar academicamente na proteção de dados?

Convido você a ler dois textos interessantes:

1. Xeque-mate: o tripé de proteção de dados pessoais no xadrez das iniciativas legislativas

no Brasil; e

2. Parece que o juiz não entende: entrevista com o criador da criptografia

utilizada no WhatsApp.

2. BLOCKCHAIN

A blockchain é uma das maiores invenções no campo informático desde a

web. Essa tecnologia registra as operações em sistema P-2-P (pessoa-para-pessoa)

e está baseada em quatro fundamentos: o registro compartilhado das transações

(ledger), o consenso para verificação das transações, um contrato que determina

as regras de funcionamento das transações e, finalmente, a criptografia, que é o

fundamento de tudo. Processos complexos e lentos, suscetíveis a confirmações

de vários níveis e expostos a furto de dados em toda a cadeia, podem, com o uso

dessa tecnologia, tornarem-se rastreáveis e permanentes.

Na blockchain, os registros são encadeados, de forma que cada novo

registro dependa do anterior. Esses registros são blocos de transações, daí o

nome blockchain (cadeia de blocos). Ao mesclar o conceito de um livro-razão,

que contém as entradas contábeis de uma empresa e seu caráter distribuído, a

blockchain também passou a ser chamada de distributed ledger (livro-razão

distribuído).

Eleito o processo que utilizará a tecnologia, são programados na blockchain

os contratos, isto é, as regras de negócio aplicadas aos sistemas (ANDERSON e

SHAPIRO, 2019). O Bitcoin, que ficou famoso nos últimos anos, nada mais é que

um tipo de contrato, ainda muito rudimentar. Nessa programação também são

incluídos os níveis de acesso dos membros da rede às informações contidas na

ledger. A partir daí, todas as novas transações serão registradas e operadas de

APLICAÇÃO DA INTELIGÊNCIA ARTIFICIAL AO DIREITO 10

AULA 4 – DESAFIOS CONEXOS

acordo com o que foi programado.

Trata-se de uma maneira revolucionária de estocar e registrar informações

on-line. Ela funciona como um grande registro público de dados em que cada

bloco na cadeia de informações contém dados com contratos, registros de

operações, provas de autenticidade, entre outras possibilidades. Cada bloco nessa

cadeia está conectado de forma segura ao próximo por uma assinatura digital

criptografada, o código hash.

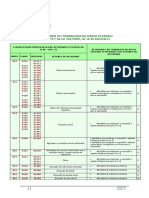

BLOCO 1 BLOCO 2 BLOCO 3

CONTEÚDO CONTEÚDO

CONTEÚDO + +

HASH 0 HASH 1

HASH 0 HASH 1 HASH 2

O hash de um bloco é único e representa ao final todas as informações

contidas no bloco que ele “fechou” da cadeia. Assim, o próximo bloco não

precisará conter toda a informação do bloco anterior – começará apenas com o

hash do último.

NOTA

Aqui vale uma explanação maior para os interessados: uma função hash (ou função de

dispersão) pode ser definida como uma função que recebe como entrada uma cadeia

de tamanho arbitrário e dá como saída uma cadeia de tamanho fixo, denominada valor

de hash. O cálculo da saída da função deve ser computável eficientemente, em tempo

linear sobre o tamanho da cadeia de entrada. Uma função hash criptográfica é uma

função hash que é resistente à colisão, resistente à pré-imagem e resistente à segunda

pré-imagem. Essas três propriedades estão relacionadas e seguem suas definições:

1. Resistência à colisão: uma função hash H é considerada resistente à colisão se é

impraticável encontrar duas cadeias, x e y, tal que x ≠ y, e H (x) = H(y). Intuitivamente,

ela será resistente à colisão se é difícil encontrar duas mensagens com o mesmo valor

de hash.

2. Resistência à pré-imagem (ou propriedade de mão-única): uma função de hash H

é considerada resistente à pré-imagem se, dado um valor de hash y, é impraticável

computar qualquer cadeia de entrada x, tal que H(x) = y.

3. Resistência à segunda pré-imagem: uma função hash H é considerada resistente à

segunda pré-imagem se, dado uma cadeia x, é impraticável encontrar uma cadeia y,

tal que x ≠ y, e H(x) = H(y).

APLICAÇÃO DA INTELIGÊNCIA ARTIFICIAL AO DIREITO 11

AULA 4 – DESAFIOS CONEXOS

Com o crescimento da cadeia de blocos, a informação torna-se cada vez

mais segura e estável, já que cada novo bloco inserido legitima todos os anteriores,

porque depende deles para existir. Com mais blocos e mais usuários, a tecnologia

também ganha em segurança. A tecnologia é baseada na checagem contínua de

dados públicos, ou seja, se um usuário mal-intencionado inserir uma informação

inverídica em blocos anteriores, o bloco ilegítimo não poderá ser encaixado na

cadeia, tornando-se imprestável.

A ideia é bastante similar, por exemplo, à que norteia o funcionamento do

Sistema Financeiro e as suas transações, com uma diferença fundamental: baseada

num registro público difuso de informações, ela elimina a figura do intermediário,

o “homem do meio”. Ela torna possível que uma pessoa transfira uma quantia,

em moeda digital, para outro indivíduo sem precisar de nenhuma conta bancária,

apenas registrando isso no bloco de informações que está sendo criado naquele

momento.

Mas a funcionalidade da blockchain vai muito além das transações bancárias:

como qualquer tipo de dado pode ser gravado numa cadeia de informações

desse tipo, a indústria de pedras preciosas, por exemplo, está usando a blockchain

para catalogar diamantes. A tecnologia poderia também simplificar sobremaneira

os registros cartoriais, evitar a falsificação de medicamentos e melhorar o rastreio

de animais ou mercadorias desde a sua origem. Basta registrar todos esses dados

em blocos.

Essa cadeia de dados permite ainda a criação dos smart contracts, contratos

inteligentes que podem ser executados automaticamente desde uma ordem pré-

agendada na cadeia de informações. Os smart contracts são contratos escritos

em código de computador que se diferenciam de suas contrapartes jurídicas

por serem autoexecutáveis. Isto é, uma vez aceitos, cumprem automaticamente o

acordo estabelecido nas linhas de código, ou garantem que este seja cumprido.

No direito, podemos aplicar um smart contract em contratos de compra e

venda. Por exemplo: uma parte concorda em transferir a quantia, a outra concorda

em transferir a chave e imediatamente os valores e a propriedade são transferidos

de forma autêntica, sem a necessidade de se fazerem alterações de registro

em cartório para autenticar aquela transação. Cria-se, assim, o que se chama de

trustless trust, um sistema que não depende de confiança entre as partes, já que é

confiável em si. Não é incrível?!

Sob o aspecto da intimidade e da privacidade de dados, essa nova

tecnologia traz evoluções consideráveis. Em primeiro lugar, porque tem efeito

APLICAÇÃO DA INTELIGÊNCIA ARTIFICIAL AO DIREITO 12

AULA 4 – DESAFIOS CONEXOS

dissuasório para invasões por hackers para o furto de informações bancárias. É inútil

invadir apenas um computador para efetivar transações, toda a cadeia pública

de informação do restante daquela blockchain negará a utilização do dado ao

usuário mal-intencionado. Hackear a cadeia só seria efetivo se a maior parte dos

computadores-usuários que mantém e autentica as informações fosse hackeada

ao mesmo tempo (o ataque dos 51%), o que é praticamente inviável numa cadeia

difusa e bem distribuída de informações que tem confirmação em rede por

maioria dos usuários.

Com a tecnologia do livro-razão distribuído podemos estar diante de um

daqueles momentos na história em que testemunhamos a explosão do potencial

criativo da humanidade, como ocorreu com a web há alguns anos, levando ao

crescimento exponencial de usos e aplicações de uma tecnologia.

Na inteligência artificial, vimos que quanto mais confiáveis os dados, melhor

é a aplicação dos robôs algorítmicos. A blockchain é capaz de tutelar dados de

maneira confiável, bem distribuída e segura. Assim, se os usuários escolherem

disponibilizar seus dados, essa tecnologia pode ser importante para a melhoria das

técnicas de IA na medida que estão sendo fornecidos dados confiáveis, a abranger

dois dos “V’s” que vimos na primeira aula: valor e veracidade da informação. Viu

só como tudo está conectado?

SAIBA MAIS

Assista aqui a um vídeo bem

interessante, em que um

executivo da IBM explica sobre o

funcionamento da blockchain.

3. FAKE NEWS

O fenômeno das notícias falsas não é novo: segundo Darnton, elas existem

pelo menos desde o Século VI, quando o historiador bizantino Procópio arruinou

APLICAÇÃO DA INTELIGÊNCIA ARTIFICIAL AO DIREITO 13

AULA 4 – DESAFIOS CONEXOS

“E as notícias falsas sempre existiram. Procópio foi um historiador bizantino

do Século 6 famoso por escrever a história do império de Justiniano. Mas ele

também escreveu um texto secreto, chamado ‘Anekdota’, e ali ele espalhou

‘fake news’, arruinando completamente a reputação do imperador Justiniano e

de outros. Era bem similar ao que aconteceu na campanha eleitoral americana.”

Fonte: Folha de S.Paulo. Acesso em 4 dez. 2019.

a reputação do imperador Justiniano com o texto intitulado “Anekdota”.

Afirma-se ainda, no entanto, que o ocidente testemunhou a primeira

difusão escrita de um boato como notícia verdadeira em 1755, quando um

grande terremoto atingiu Lisboa. Mais especificamente, foram divulgados na

ocasião os panfletos de relações de sucessos. Segundo Araújo (2006), eram

“histórias tipicamente distorcidas que continham omissões, elementos de fantasia,

negligência e incerteza”, a difundir a “notícia’’ de que uma aparição da Virgem

Maria teria salvo as vidas de alguns dos sobreviventes.

Os jornais com informações apuradas, como conhecemos hoje, apenas se

popularizaram no Século XIX. De fato, foi só a partir do lançamento do The New

York Times, em 1896, que o modelo de negócios de jornais diários de notícias

como fonte confiável de informação tomou corpo no ocidente.

Mesmo naquela época, ainda eram comuns as publicações que mixavam

notícias verdadeiras e exageradas. Bom exemplo disso era o Morning Journal, de

William Randolph Hearst (inspiração mais tarde para o personagem principal de

Cidadão Kane, de Orson Welles), que incentivou, em boa medida com notícias

falsas ou, no mínimo, bastante infladas, a guerra hispano-americana.

Na contemporaneidade, a internet trouxe novos desafios também na

aferição de veracidade das notícias, que são divulgadas agora em meios sociais

expandidos e potencializados pela conexão em rede. Os últimos anos certamente

consistiram no ápice da circulação de notícias falsas em toda a história da

humanidade. Se antes a limitação de um boato dificilmente transpassava os limites

de uma cidade ou, quando muito, de um país, hoje, um boato torna-se global

sem grandes dificuldades, com consequências imprevisíveis.

Com o avanço da tecnologia, testemunhamos a difusão de casos nada

críveis vendidos como notícias verdadeiras . O principal meio de difusão desse

tipo de “informação” tem sido as redes sociais. Nesse cenário, a difusão de notícias

falsas tem poder social que não pode ser ignorado. O próprio Facebook foi alvo

APLICAÇÃO DA INTELIGÊNCIA ARTIFICIAL AO DIREITO 14

AULA 4 – DESAFIOS CONEXOS

de uma notícia falsa no começo de 2016, quando ex-funcionários da empresa

teriam declarado que a rede social “suprimiu rotineiramente publicações e notícias

tidas como de caráter conservador”. Reportagens de jornais respeitados se

seguiram ao suposto vazamento e revelaram que a plataforma teria, inclusive,

impulsionado fatos ligados a candidatos do Partido Democrata e deliberadamente

sabotado republicanos nas eleições de 2012. Nada disso era verdade – um

“engano”, como preferiram os periódicos.

Diversas reportagens da imprensa especializada deram conta de tais

denúncias, entre elas, Gizmodo, The Guardian e The Telegraph.

O que leva alguém a investir na disseminação de notícias falsas? Há várias

respostas para esse questionamento. A mais óbvia delas é a financeira: propagar

notícias falsas em redes sociais pode ser uma boa fonte de renda em algumas

partes de um mundo globalizado caracterizado por economias integradas; a

outra tem cunho mais ideológico, no sentido de difundir fake news para atingir

determinada ideia, agenda, organização, movimento ou agente político (ALCOTT

e GENTZKOW, 2016). Ambas as possibilidades ensejam sérias preocupações no

que concerne à intimidade dos internautas.

A disseminação de notícias falsas pode levar à definição de aspectos

ideológicos dos indivíduos – ou, pelo menos, à sua reafirmação –, prejudicando

a formação de convencimentos em espaços sociais que deveriam viabilizar níveis

mais adequados de simetria informacional. Os algoritmos de redes sociais

favorecem a criação de vínculos “em bolha”, facilitando as interações entre os

usuários que compartilham de similares interesses, opiniões, localizações, etc. Tal

fenômeno é conhecido pela literatura especializada como filter bubble (filtro da

bolha).

SAIBA MAIS

Veja aqui, em apenas nove minutos,

uma palestra bastante relevante

sobre as bolhas nas redes sociais.

APLICAÇÃO DA INTELIGÊNCIA ARTIFICIAL AO DIREITO 15

AULA 4 – DESAFIOS CONEXOS

O problema nisso é que, enquanto no século passado havia maior

conhecimento acerca de quem eram os editores dos veículos de comunicação

– podendo, até certo ponto, se escolher os meios de informação e comparar

opiniões em meridianos opostos do espectro político –, na internet os algoritmos

assumiram este papel. O cidadão comum perdeu, em boa parte, a capacidade

de ter contato com notícias e opiniões diversas das suas próprias e do seu círculo

imediato de contatos.

No campo ideológico, as notícias falsas certamente têm papel

supranacional. Há uma guerra de desinformação na internet, com participantes

importantes no cenário geopolítico mundial. De acordo com Jowett e O’Donell

(2005), as campanhas de desinformação são uma criação soviética. O próprio

termo “desinformação” deriva da palavra “dezinformatsiya” – o nome que designava

o departamento de contrapropaganda da KGB. Nos últimos anos, a Rússia vem

intensificando o uso da desinformação como tática de influência geopolítica.

Há uma investigação nos EUA sobre uma possível tentativa do Kremlin

em intervir no cenário eleitoral americano. O Twitter tem se mostrado uma das

principais vias para a realização destas sofisticadas iniciativas. Análises indicam

que robôs estariam disseminando notícias de forma estratégica, explorando

fragilidades políticas e características pessoais de agentes políticos dos Estados

Unidos.

Exemplo disso se deu no caso Nicole Mincey, usuária da rede Twitter

sob o endereço “@ProTrump45”, e que teria feito elogios ao presidente norte-

americano e à sua forma de governar. Em um curto espaço de tempo, Trump

repostou os elogios recebidos de Mincey. O problema nisso é que se apurou que

tal usuária, em verdade, nem sequer existia, tendo a conta correspondente sido

posteriormente suspensa pelo Twitter. A partir disso, levantou-se a suspeita de que

o perfil teria sido criado por um robô russo para atrair a atenção e influenciar as

escolhas do presidente dos EUA. Em dado momento, Nicole tinha mais de 150 mil

seguidores, os quais não puderam ser identificados como pessoas reais ou outros

robôs, seguidos por ela também para passar a falsa impressão de que consistiam

em usuários populares na rede social.

APLICAÇÃO DA INTELIGÊNCIA ARTIFICIAL AO DIREITO 16

AULA 4 – DESAFIOS CONEXOS

Em resposta a problemas como esse, pesquisadores e professores de

universidades norte-americanas criaram uma aplicação que passou a monitorar

os movimentos de prováveis robôs algoritmos que controlam contas de Twitter a

partir da Rússia – o denominado projeto Hamilton 68.

Os robôs de algoritmos podem ir além. Bessi e Ferrara (2016) estimaram

em estudo que havia 400 mil contas do Twitter comandadas por robôs nas

eleições de 2016 nos EUA. Essas contas foram responsáveis por 3,8 milhões de

postagens no mês que antecedeu as eleições, algo em torno de 20% de todas as

postagens sobre o tema no período pesquisado. A intervenção, segundo esses

pesquisadores, foi capaz de distorcer os debates on-line sobre o tema.

Há outros exemplos claros da afetação de eleições majoritárias por robôs de

algoritmos. Em maio de 2017, na semana das eleições presidenciais francesas, um

pacote de dados contendo fotos e dados bancários do presidenciável Emmanuel

Macron foi vazado no influente fórum de hackers “/pol/’’, que fica hospedado no

site de anonimato 4chan.org.

O escândalo que se seguiu ao vazamento ficou conhecido como Macron

Leaks. A equipe de Macron reconheceu que dados haviam sido furtados, mas

alegou que o então candidato não era o dono de todos os documentos bancários

apresentados, muitos dentre os quais davam conta da existência de contas

bancárias supostamente não declaradas por Macron. Nos dias que se seguiram,

descobriu-se que o ataque na verdade fora orquestrado pelo 28 APT, também

conhecido como Fancy Bear, um grupo de hackers provavelmente russo.

Desde o momento em que os dados vazaram, robôs algoritmos que

estavam desativados desde o término das eleições estadunidenses passaram a

imediatamente distribuir o conteúdo. O movimento pode indicar que, além do

domínio geopolítico-estratégico de governos, pode existir um mercado negro

de robôs algoritmos que controlam contas de redes sociais para espalhar notícias.

APLICAÇÃO DA INTELIGÊNCIA ARTIFICIAL AO DIREITO 17

AULA 4 – DESAFIOS CONEXOS

A dificuldade real está em estabelecer a veracidade da informação

oferecida. Com a aplicação de técnicas de inteligência artificial, os robôs

algorítmicos são capazes de predizer e emular comportamentos humanos com

relativa facilidade. Podem até buscar na rede informações que preencham seus

perfis e imitar padrões de publicações de humanos (CAO, YANG e PALOW), sendo

capazes de se envolver em discussões populares para, com publicações baseadas

em palavras-chave, adquirir a confiança de usuários reais que passam a segui-

los. Alguns deles aprendem a mimetizar tão bem um usuário real que podem se

tornar um verdadeiro “clone” de um perfil verdadeiro (FERRARA et al, 2016).

Há um paradoxo nas redes: não é mais possível saber se um usuário é real

ou se ele é um robô utilizando-se do conjunto de informações de um usuário real

para mimetizá-lo. Esse comportamento dos detentores desse tipo de tecnologia,

meio principal de disseminação de notícias falsas, representa um sério desafio

para a intimidade dos usuários da rede, que veem seus dados subtraídos para a

construção de perfis falsos.

A par disso tudo, é certo que o aumento de postagens e compartilhamentos

– por usuários reais ou robôs – beneficia os detentores das redes sociais na medida

que torna possível o oferecimento aos anunciantes de um público maior e mais

ativo, que busca incessantemente novidades em sua rede.

Uma possível via de resolução do problema é o estabelecimento de

padrões de colaboração entre esses novos agentes privados difusores de notícias –

as redes sociais – e o Estado, contanto que não representem ameaça à intimidade.

A inteligência artificial, quando se trata do fenômeno das fake news, pode

ser utilizada tanto para disparos maciços de notícias falsas por robôs algorítmicos

que querem desinformar populações para influenciar em suas escolhas, como

para tentar inibir esse tipo de utilização da tecnologia. Os responsáveis pela

segurança da informação no Facebook, mais notável rede social, dizem que vêm

aumentando seus esforços de colaboração com as autoridades e que planejam

implementar técnicas de machine learning para coibir os abusos das fake news.

APLICAÇÃO DA INTELIGÊNCIA ARTIFICIAL AO DIREITO 18

AULA 4 – DESAFIOS CONEXOS

SAIBA MAIS

Gostaria de te convidar a assistir a três vídeos que versam sobre a temática das fake news.

No primeiro, você verá como as técnicas de IA são aplicadas para “imitar” perfeitamente o

ex-presidente norte-americano Barack Obama, reproduzindo sua face e seus movimentos

musculares:

No segundo vídeo, produzido pelo TSE, a abordagem enfoca o perigo das fake news para a

democracia:

Por fim, temos uma palestra. Nela, discorre-se sobre como as fake news afetam e moldam o

mundo da chamada “pós-verdade” e a importância dos sites de checagem de fatos:

APLICAÇÃO DA INTELIGÊNCIA ARTIFICIAL AO DIREITO 19

AULA 4 – DESAFIOS CONEXOS

SAIBA MAIS

Já que você chegou até aqui, imagino que a IA se tornou um assunto

interessante na sua vida e tem feito parte das suas últimas discussões com

colegas de trabalho, amigos e familiares. Você vai encontrar uma reportagem

especial na Folha de São Paulo sobre o tema: “Inteligência Artificial muda a vida

de todos, para melhor e para pior”. É grande, mas vale a pena ler e, quem sabe

indicar a leitura.

CONCLUSÃO

As novas tecnologias têm sido capazes de afetar o ser humano em um nível

jamais imaginado. Elas são capazes de reposicionar o modo como nos inserimos

no mundo – e isso é bastante coisa! Depois do que vimos nessa aula, percebemos

que acima de todas essas tecnologias e desses fenômenos está a inteligência

artificial. Ela é a ferramenta capaz de potencializar desde a necessidade que temos

de conservar a nossa privacidade, à indispensabilidade de protegermos nossos

dados e até a urgência de garantirmos a fidelidade das informações (e das fontes)

que buscamos.

A IA pode ser, como acabamos de ver, utilizada tanto para o bem quanto

para o mal. Seus efeitos são inegáveis e mal podemos imaginar nesse ponto da

história como ela ainda nos afetará. Uma coisa é certa: precisamos acumular o

máximo de conhecimento possível para termos certeza do alcance e da magnitude

da tecnologia com a qual estamos lidando – mas sem cometer os erros que,

aprendemos, não têm nada a ver com IA (já podemos dizer “não, a IA não é um

robô humanoide” ou “ não, ela ainda não está tão avançada ao ponto que tomará

o controle de si própria para aniquilar a humanidade... isso é o exterminador do

futuro, não existe!”). Temos ainda um bom alcance de como a IA tem sido aplicada

ao direito, inclusive aqui no Supremo. Ufa! Como aprendemos neste curso!

Espero que você tenha aproveitado esta oportunidade de aprendizagem

e que continue se aprofundando nos conceitos e nos temas que trouxemos aqui.

Foi um prazer acompanhá-lo(la)!

Nos vemos na próxima – se um robô algorítmico não me substituir...

(Brincadeira, você sabe que não estamos nesse ponto ainda!)

APLICAÇÃO DA INTELIGÊNCIA ARTIFICIAL AO DIREITO 20

AULA 4 – DESAFIOS CONEXOS

REFERÊNCIAS

ALCOTT, H.; GENTZKOW, M. Social media and fake news in the 2016. Journal of

Economic Perspectives, v. 31, n. 2, spring, 2017, p. 211-236. Disponível em: https://

web.stanford.edu/~gentzkow/research/fakenews.pdf. Acesso em: 4 dez. 2019.

ANDERSON, D. L.; SHAPIRO, L. Introduction to chain codes. The mind project:

consortium on cognitive science instruction. Disponível em: http://www.mind.

ilstu.edu/curriculum/chain_codes_intro/chain_codes_intro.php. Acesso em: 4

dez. 2019.

ARAÚJO, A. C. The Lisbon earthquake of 1755: public distress and political

propaganda. E-JPH, v. 4, n. 1, Brown University, summer, 2006. Disponível em:

https://www.brown.edu/Departments/Portuguese_Brazilian_Studies/ejph/html/

issue7/html/aaraujo_main.html. Acesso em: 4 dez. 2019.

BESSI, A.; FERRARA, E. Social bots distort the 2016 U.S. presidential election

discussion. First Monday, v. 21, n. 11. Disponível em: https://firstmonday.org/ojs/

index.php/fm/article/view/7090/5653. Acesso em: 4 dez. 2019.

CAO, Q.; YANG, X.; YU, J.; PALOW, C. Uncovering large groups of active malicious

accounts in online social networks. In Proceedings of the 2014 ACM SIGSAC

Conference on Computer and Communications Security. ACM, p. 477-488.

Disponível em: https://www.eecis.udel.edu/~ruizhang/CISC859/S17/Paper/p19.

pdf. Acesso em: 4 dez. 2019.

CONSELHO DA EUROPA. TREATY 108. Strasburgo, 1981. Disponível em: https://

www.coe.int/en/web/conventions/full-list/-/conventions/treaty/108. Acesso em:

4 dez. 2019.

DE HERT, P.; GUTWIRTH, S.; NOUWT, S.; POULLET, Y. Reinventing data

protection? Springer: Bruxelas, 2014, p. x (prefácio).

FERRARA, E. Desinformation and social bot operations in the run up to the 2017

french presidential election. University of Southern California. Disponível em:

https://arxiv.org/ftp/arxiv/papers/1707/1707.00086.pdf. Acesso em: 4 dez. 2019.

FERRARA, E.; VAROL, O.; DAVIS, C.; MENCZER, F.; FLAMMINI, A. The rise of social

bots. Communications of the ACM, v. 59, n. 7, p. 96-104. Disponível em: https://

cacm.acm.org/magazines/2016/7/204021-the-rise-of-social-bots/fulltext. Acesso

em: 5 dez. 2019.

APLICAÇÃO DA INTELIGÊNCIA ARTIFICIAL AO DIREITO 21

AULA 4 – DESAFIOS CONEXOS

GUTWIRTH, S.; LEENES, R.; De HERT, P. Reloading data protection:

multidisciplinary insights and contemporary challenges. Dordrecht: Springer,

2014, p. 61.

JOWETT, G.; O’DONELL, V. Propaganda and persuasion. Londres: Sage

Publications, 2005. p. 21-23.

Olmstead v. United States, 277 U.S. 438 (1928). Disponível em: https://supreme.

justia.com/cases/federal/us/277/438/case.html. Acesso em: 4 dez. 2019.

POULLET, Y.; ROUVROY, A. The right to informational self-determination and the

value of self-development: resseassing the importance of privacy to democracy.

In: DE HERT, P.; GUTWIRTH, S.; NOUWT, S.; POULLET, Y. Cit. p. 61.

APLICAÇÃO DA INTELIGÊNCIA ARTIFICIAL AO DIREITO 22

AULA 4 – DESAFIOS CONEXOS

APLICAÇÃO DA INTELIGÊNCIA ARTIFICIAL AO DIREITO 23

Você também pode gostar

- Inteligencia Artificial - Aula 4Documento23 páginasInteligencia Artificial - Aula 4Junior DóriaAinda não há avaliações

- O uso de dados pessoais pelo setor público e as administrações tributárias no contexto da LGPDNo EverandO uso de dados pessoais pelo setor público e as administrações tributárias no contexto da LGPDAinda não há avaliações

- O impacto do avanço tecnológico no relacionamento interpessoal, intrapessoal e na privacidade dos indivíduosNo EverandO impacto do avanço tecnológico no relacionamento interpessoal, intrapessoal e na privacidade dos indivíduosAinda não há avaliações

- Desmistificando a LGPD: entenda como a Lei Geral de Proteção de Dados Pessoais pode ser aplicada no dia a dia das empresas e das pessoasNo EverandDesmistificando a LGPD: entenda como a Lei Geral de Proteção de Dados Pessoais pode ser aplicada no dia a dia das empresas e das pessoasAinda não há avaliações

- Metaverso, Direito e Tecnologia: a legislação e o judiciário brasileiro estão preparados para salvaguardar os direitos fundamentais da proteção de dados pessoais e da privacidade?No EverandMetaverso, Direito e Tecnologia: a legislação e o judiciário brasileiro estão preparados para salvaguardar os direitos fundamentais da proteção de dados pessoais e da privacidade?Ainda não há avaliações

- 113-2706-1-PBDocumento14 páginas113-2706-1-PBBeatriz GontijoAinda não há avaliações

- Direitos à privacidade e esquecimento na era digitalDocumento34 páginasDireitos à privacidade e esquecimento na era digitalFernanda Das FloresAinda não há avaliações

- Privacidade - e - Internet With Cover Page v2Documento14 páginasPrivacidade - e - Internet With Cover Page v2Isabela CristinaAinda não há avaliações

- Os desafios da adequação à LGPD: uma análise sobre a aplicação da autodeterminação informativaNo EverandOs desafios da adequação à LGPD: uma análise sobre a aplicação da autodeterminação informativaAinda não há avaliações

- Privacidade, o novo direito a ter direitos: onde surgiu? O que é? Que direitos tutela? Como defendê-la?No EverandPrivacidade, o novo direito a ter direitos: onde surgiu? O que é? Que direitos tutela? Como defendê-la?Ainda não há avaliações

- LGPD e a proteção de dados pessoais na era digitalDocumento23 páginasLGPD e a proteção de dados pessoais na era digitalMaximiliam Rezende - GTICAinda não há avaliações

- Direito A Privacidade Na Internet: A Lei Geral de Proteção de Dados PessoaisDocumento14 páginasDireito A Privacidade Na Internet: A Lei Geral de Proteção de Dados PessoaisIsabella Rodrigues Alves CorrêaAinda não há avaliações

- Livro Rodotá - ResumoDocumento5 páginasLivro Rodotá - ResumoThayene MeloAinda não há avaliações

- A privacidade na era da Internet das CoisasDocumento61 páginasA privacidade na era da Internet das CoisasFilippe OliveiraAinda não há avaliações

- Big Data - Violação de Direito FuncamentalDocumento12 páginasBig Data - Violação de Direito FuncamentalWilson dracoAinda não há avaliações

- 3 e HW SUOP2 DNy VG30Documento10 páginas3 e HW SUOP2 DNy VG30Romeu Rafael NgarineAinda não há avaliações

- Direito Digital E Proteção De DadosNo EverandDireito Digital E Proteção De DadosAinda não há avaliações

- AtividadeDocumento3 páginasAtividadeoronaldoschopfAinda não há avaliações

- Privacidade e Proteção de Dados Pessoais Na Sociedade Digital PDFDocumento192 páginasPrivacidade e Proteção de Dados Pessoais Na Sociedade Digital PDFNelson Rodrigo Marcelino100% (3)

- Direito e TecnologiaDocumento36 páginasDireito e TecnologiavazalmeidarafaelAinda não há avaliações

- A Proteção De Dados E O Marco Civil Da InternetNo EverandA Proteção De Dados E O Marco Civil Da InternetAinda não há avaliações

- (SARTONI, Ellen Carina Mattias) Privacidade e Dados Pessoais. A Proteção Contratual Da Personalidade Do Consumidor Na InternetDocumento44 páginas(SARTONI, Ellen Carina Mattias) Privacidade e Dados Pessoais. A Proteção Contratual Da Personalidade Do Consumidor Na InternetMaik SalazarAinda não há avaliações

- Os Negócios Realizados Via Plataformas de Blockchain À Luz Da LGPDDocumento29 páginasOs Negócios Realizados Via Plataformas de Blockchain À Luz Da LGPDluclindenmaierAinda não há avaliações

- Principais desafios para a proteção e tratamento de dados pessoais no Brasil, a partir da experiência europeiaNo EverandPrincipais desafios para a proteção e tratamento de dados pessoais no Brasil, a partir da experiência europeiaAinda não há avaliações

- A proteção de dados pessoais e seus impactos no direito do trabalhoDocumento42 páginasA proteção de dados pessoais e seus impactos no direito do trabalhoMilena RitzelAinda não há avaliações

- MINI PROJETO João Victor de Oliveira RodriguesDocumento6 páginasMINI PROJETO João Victor de Oliveira RodriguesgustavoAinda não há avaliações

- Patrimônio e bens digitais: perfis de usuários nas redes sociaisNo EverandPatrimônio e bens digitais: perfis de usuários nas redes sociaisAinda não há avaliações

- A Proteção de Dados Pessoais Como Uma Efetivação Dos Direitos HumanosDocumento8 páginasA Proteção de Dados Pessoais Como Uma Efetivação Dos Direitos Humanostheus.benevadesAinda não há avaliações

- Ética e Direito No Mundo DigitalDocumento16 páginasÉtica e Direito No Mundo DigitalAndre Anderson Melo FerreiraAinda não há avaliações

- AtividadeDocumento3 páginasAtividadeoronaldoschopfAinda não há avaliações

- Comentários à Lei Geral de Proteção de Dados: Sob a perspectiva do direito médico e da saúdeNo EverandComentários à Lei Geral de Proteção de Dados: Sob a perspectiva do direito médico e da saúdeAinda não há avaliações

- O Reconhecimento Facial Na Segurança PúblicaDocumento16 páginasO Reconhecimento Facial Na Segurança PúblicaCarolina RibeiroAinda não há avaliações

- Trabalho de Protecao Juridica de Dados PessoaisDocumento10 páginasTrabalho de Protecao Juridica de Dados PessoaisTmcel LabAinda não há avaliações

- Monitoramento De Emails Na Relação De EmpregoNo EverandMonitoramento De Emails Na Relação De EmpregoAinda não há avaliações

- Privacidade e InternetDocumento13 páginasPrivacidade e InternetMarcelo Ayub MonteiroAinda não há avaliações

- Direito Digital e PrivacidadeDocumento41 páginasDireito Digital e PrivacidadeLucas SanchesAinda não há avaliações

- Tecnologia Da Informação JurídicaDocumento101 páginasTecnologia Da Informação JurídicaJeane Pâmela RubimAinda não há avaliações

- Dissertação - Protecção de Dados e IaDocumento116 páginasDissertação - Protecção de Dados e IaAlede CunhaAinda não há avaliações

- Origem e evolução da privacidadeDocumento22 páginasOrigem e evolução da privacidadeFelipe RaddiAinda não há avaliações

- Projecto NeusaDocumento7 páginasProjecto NeusaCamilo giváAinda não há avaliações

- A revolução digital e o direito à privacidadeNo EverandA revolução digital e o direito à privacidadeAinda não há avaliações

- Versao Parcial Dissertacao Ricardo SidiDocumento43 páginasVersao Parcial Dissertacao Ricardo SidiAndré ScappaAinda não há avaliações

- Neusa MiC TERCADocumento10 páginasNeusa MiC TERCACamilo giváAinda não há avaliações

- A Privacidade Da Sociedade Contemporânea - o Obstáculo Da Aplicabilidade Do Direito DigitalDocumento25 páginasA Privacidade Da Sociedade Contemporânea - o Obstáculo Da Aplicabilidade Do Direito DigitalFrancianny AraujoAinda não há avaliações

- Desafios jurídicos da privacidade na InternetDocumento4 páginasDesafios jurídicos da privacidade na InternetRMI PRESTADORAAinda não há avaliações

- RB 138508 Da Privacidade à Proteção Dos Dados PessoaisDocumento16 páginasRB 138508 Da Privacidade à Proteção Dos Dados PessoaisMarcos Dias MarinoAinda não há avaliações

- N TNo B56 FVMci 5 ZB Ax LPLWy MTQ VRYCg Qu BVBR 6 A B1Documento11 páginasN TNo B56 FVMci 5 ZB Ax LPLWy MTQ VRYCg Qu BVBR 6 A B1Jacob Luna LeiteAinda não há avaliações

- LGPD e seus impactos na gestão arquivísticaDocumento15 páginasLGPD e seus impactos na gestão arquivísticabarbaraAinda não há avaliações

- O Regime Jusfundamental da Proteção de Dados Pessoais no BrasilNo EverandO Regime Jusfundamental da Proteção de Dados Pessoais no BrasilAinda não há avaliações

- Direito e tecnologias da informaçãoDocumento51 páginasDireito e tecnologias da informaçãoDoubt NatorAinda não há avaliações

- Patricia Peck Proteção de Dados Pessoais Comentários À Lei 2020Documento115 páginasPatricia Peck Proteção de Dados Pessoais Comentários À Lei 2020Renan Português100% (1)

- Lei Geral de Proteção de Dados e Escambo de Dados Pessoais - Ronaldo Batista DóriaDocumento18 páginasLei Geral de Proteção de Dados e Escambo de Dados Pessoais - Ronaldo Batista DóriaRonaldo DóriaAinda não há avaliações

- ARTIGO RDC NEWTON DE LUCCA GUILHERME MAGALHÃES MARTINS RENATA QUEIROZ LGPD E CCPA - Pós Revisão Do Prof Guilherme - Apos Revisao Do Prof Newton - VERSAO FINAL PDFDocumento21 páginasARTIGO RDC NEWTON DE LUCCA GUILHERME MAGALHÃES MARTINS RENATA QUEIROZ LGPD E CCPA - Pós Revisão Do Prof Guilherme - Apos Revisao Do Prof Newton - VERSAO FINAL PDFJulia Mariana Cunha PeriniAinda não há avaliações

- TCC - Marcelo A Vidal R.A 82120518 (LGPD) PDFDocumento27 páginasTCC - Marcelo A Vidal R.A 82120518 (LGPD) PDFmelqueroberto423Ainda não há avaliações

- Proteção de Dados como DireitoDocumento18 páginasProteção de Dados como DireitoLorena AmaralAinda não há avaliações

- Segurança da Informação vs Crimes DigitaisDocumento24 páginasSegurança da Informação vs Crimes DigitaisA_G159100% (1)

- A Relação Entre Compliance e Tecnologia Da Informação e A Aplicação Da Lei Geral de Proteção de Dados Pessoais (LGPD)Documento18 páginasA Relação Entre Compliance e Tecnologia Da Informação e A Aplicação Da Lei Geral de Proteção de Dados Pessoais (LGPD)Maria Fernanda MaymoneAinda não há avaliações

- Sociedade Vigiada: Ladislau Dowbord (Organizador)No EverandSociedade Vigiada: Ladislau Dowbord (Organizador)Ainda não há avaliações

- LGPD x GDPRDocumento38 páginasLGPD x GDPRTheSonOfNothing100% (2)

- Usei o Novo Testamento para Provar Que Deus Não Existe.Documento6 páginasUsei o Novo Testamento para Provar Que Deus Não Existe.Carlos Adriano De AnchietaAinda não há avaliações

- Escândalo na Igreja de PinheirosDocumento7 páginasEscândalo na Igreja de PinheirosCarlos Adriano De AnchietaAinda não há avaliações

- Aula 1 - Inteligência Artificial (Educa)Documento20 páginasAula 1 - Inteligência Artificial (Educa)Carlos Adriano De AnchietaAinda não há avaliações

- Satã em Zacarias representa os adversários de IsraelDocumento5 páginasSatã em Zacarias representa os adversários de IsraelCarlos Adriano De AnchietaAinda não há avaliações

- TatuagemDocumento3 páginasTatuagemCarlos Adriano De AnchietaAinda não há avaliações

- A Idolatria Era PermitidaDocumento6 páginasA Idolatria Era PermitidaCarlos Adriano De AnchietaAinda não há avaliações

- Apologia de JustinoDocumento4 páginasApologia de JustinoCarlos Adriano De AnchietaAinda não há avaliações

- Fone de OuvidoDocumento1 páginaFone de OuvidoCarlos Adriano De AnchietaAinda não há avaliações

- Guia de Recolhimento da Marinha para CursoDocumento1 páginaGuia de Recolhimento da Marinha para CursoCarlos Adriano De AnchietaAinda não há avaliações

- Manda MentosDocumento3 páginasManda MentosCarlos Adriano De AnchietaAinda não há avaliações

- A verdadeira natureza de Deus na BíbliaDocumento9 páginasA verdadeira natureza de Deus na BíbliaCarlos Adriano De AnchietaAinda não há avaliações

- Oração para ProteçãoDocumento1 páginaOração para ProteçãoCarlos Adriano De AnchietaAinda não há avaliações

- Prezado (A)Documento1 páginaPrezado (A)Carlos Adriano De AnchietaAinda não há avaliações

- Tudo Sobre Os Esportes em InglesDocumento19 páginasTudo Sobre Os Esportes em InglesDaniele AlineAinda não há avaliações

- Atividades de Risco Elevado CAEDocumento7 páginasAtividades de Risco Elevado CAESerralheiroAinda não há avaliações

- TJMT cria cargos em Núcleo de Recuperação JudicialDocumento268 páginasTJMT cria cargos em Núcleo de Recuperação JudicialJildonei LazzarettiAinda não há avaliações

- Seminario IDocumento9 páginasSeminario IDa Silva CarlaAinda não há avaliações

- Cargos e Salarios P11Documento47 páginasCargos e Salarios P11Pedro Ivo Augusto MouraAinda não há avaliações

- Logica Digital EletropneumaticaDocumento47 páginasLogica Digital EletropneumaticapatriciapedrosoAinda não há avaliações

- Inversor GoodWe GW15KLV-MT Tri 220VDocumento1 páginaInversor GoodWe GW15KLV-MT Tri 220VAdriano Das ChagasAinda não há avaliações

- Curso Preparatorio Cga Resumo 2022Documento48 páginasCurso Preparatorio Cga Resumo 2022Miguel Fontanive0% (1)

- Contrato EstipulanteDocumento9 páginasContrato EstipulanteHenrique MoreiraAinda não há avaliações

- Cibercrime e Computacao ForenseDocumento96 páginasCibercrime e Computacao ForenseTati LaraAinda não há avaliações

- Laudo de Avaliação Deutsche BankDocumento81 páginasLaudo de Avaliação Deutsche BankSuelen Silva NascimentoAinda não há avaliações

- LIVE+10 - Conteu Dos+Do+Mil+Ao+Milha O+2Documento2 páginasLIVE+10 - Conteu Dos+Do+Mil+Ao+Milha O+2ThiagoPaganiAinda não há avaliações

- HottSeat - Clinica de Dor Do ZeroDocumento21 páginasHottSeat - Clinica de Dor Do ZeroDavid Nicolás Esmeral OjedaAinda não há avaliações

- Reflexão Da Ufcd - Gastos de ProduçaoDocumento3 páginasReflexão Da Ufcd - Gastos de Produçaomelo_manuela_meloAinda não há avaliações

- Forum 2Documento16 páginasForum 2Antonio RodriguesAinda não há avaliações

- Apostila de Questões - MatemáticaDocumento119 páginasApostila de Questões - MatemáticaJúlia ScherrerAinda não há avaliações

- CheckList EmpilhadeiraDocumento1 páginaCheckList EmpilhadeiraClaudio FreitasAinda não há avaliações

- Apresentação IVA AngolaDocumento10 páginasApresentação IVA AngolaSELECT ACTIVE100% (1)

- MUROS DE CONTENÇÃO PERIFÉRICADocumento63 páginasMUROS DE CONTENÇÃO PERIFÉRICAEuclides RodriguesAinda não há avaliações

- E-Book - Como Calcular Estruturas Metálicas - 04.2021Documento58 páginasE-Book - Como Calcular Estruturas Metálicas - 04.2021Luis Carlos Martins AmaroAinda não há avaliações

- Marchetaria PDF FinalDocumento3 páginasMarchetaria PDF FinalPaulo Sergio Marin de Oliveira100% (1)

- Teste 1 - Avaliação Sumativa - Economia A - 11.º CDocumento5 páginasTeste 1 - Avaliação Sumativa - Economia A - 11.º CMaria Cremilde Henrique SilvaAinda não há avaliações

- Matemática e Matemática Financeira - Marcelo LeiteDocumento24 páginasMatemática e Matemática Financeira - Marcelo LeiteRony WelryAinda não há avaliações

- Manual de Instalação Do Driver GC420tDocumento11 páginasManual de Instalação Do Driver GC420tgioo93Ainda não há avaliações

- Curso de Perfuração Direcional HalliburtonDocumento64 páginasCurso de Perfuração Direcional HalliburtonJuan Jose Montes GalarzaAinda não há avaliações

- Afrodescendentoleo (Politicamente Correto)Documento4 páginasAfrodescendentoleo (Politicamente Correto)Nilson JoséAinda não há avaliações

- Sec Homog21 3Documento8 páginasSec Homog21 3Puto ZavalAinda não há avaliações

- Formando propagandistasDocumento24 páginasFormando propagandistasBruna Santos MarubayashiAinda não há avaliações

- JDocumento5 páginasJLEONARDO RAMBO TAGLIETTIAinda não há avaliações

- Ato Administrativo 2 - Fernanda Paula OliveiraDocumento7 páginasAto Administrativo 2 - Fernanda Paula OliveiraHernane CostaAinda não há avaliações

- RM NUCLEUS - Descrição Das Permissões Do Usuário Por Tipo de MovimentoDocumento2 páginasRM NUCLEUS - Descrição Das Permissões Do Usuário Por Tipo de MovimentoAlan FagundesAinda não há avaliações